A armadilha das controladoras tri-mode: por que o RAID de hardware destrói a latência do NVMe

Colocar SSDs NVMe atrás de controladoras RAID tri-mode é um erro de engenharia. Entenda como o gargalo do hardware destrói a latência do seu storage.

Você acaba de aprovar a compra de um servidor novo. O departamento de vendas do seu fornecedor favorito sorriu de orelha a orelha ao empurrar duas dúzias de drives NVMe Gen4 de altíssima performance. Para "facilitar o gerenciamento", eles incluíram uma placa controladora RAID tri-mode de última geração. Você espeta tudo no rack, sobe o banco de dados e, misteriosamente, a performance parece a mesma de um array de SSDs SATA de cinco anos atrás.

Bem-vindo ao pedágio mais caro e inútil da infraestrutura moderna. Colocar uma controladora de hardware na frente de discos NVMe é o equivalente arquitetônico de comprar uma Ferrari e dirigi-la exclusivamente dentro de um estacionamento de shopping.

Resumo em 30 segundos

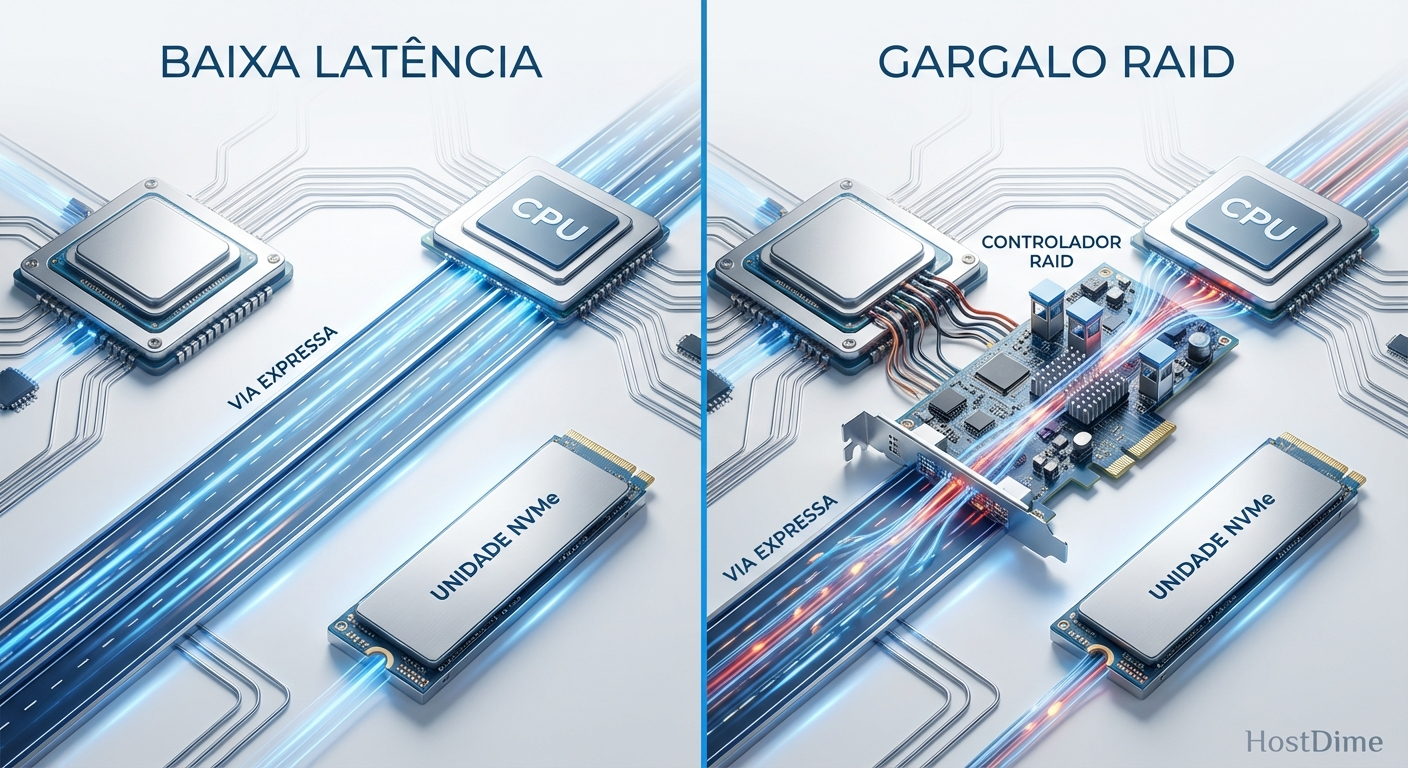

- O protocolo NVMe foi desenhado especificamente para eliminar intermediários e falar direto com a CPU via barramento PCIe.

- Controladoras tri-mode forçam a tradução de comandos NVMe rápidos para a velha e pesada pilha SCSI, destruindo a latência.

- A única arquitetura aceitável para NVMe é a conexão direta (Direct Attached) combinada com RAID por software robusto como ZFS ou mdadm.

O servidor de banco de dados engasga mesmo com discos de 7000 MB/s

Existe uma obsessão doentia na indústria por largura de banda. Os folhetos de marketing gritam números absurdos como 7000 MB/s de leitura sequencial. Mas se você administra bancos de dados relacionais pesados, virtualização densa ou sistemas de transação financeira, você sabe que a largura de banda é uma métrica de vaidade. O que mantém seu emprego seguro é a latência e a capacidade de entregar IOPS (Operações de Entrada e Saída por Segundo) em blocos pequenos, geralmente de 4K.

Quando o seu banco de dados faz um commit, ele não está gravando um arquivo ISO de 50 GB. Ele está gravando pequenos fragmentos de dados e esperando a confirmação de que o dado está seguro no disco antes de liberar a transação. O NVMe (Non-Volatile Memory Express) brilha exatamente aqui. Ele possui filas de comandos massivas (64 mil filas com 64 mil comandos cada), projetadas para paralelismo extremo.

Porém, quando você insere uma placa RAID de hardware no meio do caminho, o servidor engasga. A CPU envia o comando, que bate no chip da controladora, entra em uma fila de processamento engarrafada, é traduzido, e só então desce para o disco. Aqueles microssegundos de latência nativa do NVMe acabam de se transformar em milissegundos. Para o banco de dados, é uma eternidade.

O pedágio do barramento PCIe e a ressurreição inútil da pilha SCSI

Para entender o tamanho do crime arquitetônico, precisamos olhar para o que é uma controladora tri-mode. O conceito nasceu de uma necessidade legítima dos fabricantes de servidores: criar um único backplane (a placa de fundo onde os discos se conectam) que aceitasse discos SAS, SATA ou NVMe. A ideia era simplificar o cabeamento e a lista de peças.

O problema é como isso é executado no silício. O protocolo NVMe foi criado pelo consórcio NVM Express para substituir o protocolo AHCI e a pilha SCSI, que foram desenhados na era dos discos magnéticos giratórios. O NVMe fala a linguagem nativa do barramento PCIe (Peripheral Component Interconnect Express).

Figura: Diagrama visualizando o gargalo de latência: conexão direta PCIe versus o pedágio imposto pela controladora RAID de hardware.

Figura: Diagrama visualizando o gargalo de latência: conexão direta PCIe versus o pedágio imposto pela controladora RAID de hardware.

Quando a controladora tri-mode assume o controle, ela frequentemente atua como um tradutor. Ela pega os comandos NVMe ultra eficientes, os encapsula ou traduz de volta para comandos SCSI para que o processador interno da placa RAID (geralmente um chip ARM modesto) consiga calcular a paridade do RAID. É como pegar um e-mail, imprimi-lo, enviar por fax, e depois escanear do outro lado. Você está ressuscitando uma pilha de armazenamento legada apenas para justificar a existência de uma placa de expansão cara.

⚠️ Perigo: Muitas controladoras tri-mode limitam a largura de banda física. Um disco NVMe Gen4 x4 exige quatro pistas PCIe dedicadas. Uma controladora com um conector x8 conectada a um backplane com 8 discos NVMe criará um gargalo massivo de oversubscription (excesso de subscrição), estrangulando a performance total do array.

A ilusão do cache de gravação e as baterias BBU na era moderna

Se você trabalha com infraestrutura há mais de uma década, foi treinado para venerar o cache da controladora RAID. Antigamente, os discos rígidos (HDDs) eram tão lentos que a controladora precisava de alguns gigabytes de memória RAM embarcada para absorver as gravações rápidas do sistema operacional. Para evitar perda de dados em caso de queda de energia, adicionava-se uma BBU (Battery Backup Unit) ou um supercapacitor.

Hoje, aplicar essa lógica ao NVMe é cômico. A memória flash NAND moderna e os controladores internos dos próprios discos NVMe corporativos (que já possuem capacitores internos para proteção contra perda de energia, conhecidos como PLP - Power Loss Protection) são frequentemente mais rápidos e eficientes do que o cache DDR4 da placa RAID.

O cache da controladora não apenas se tornou redundante, como virou um estorvo. O processador da placa perde ciclos de clock gerenciando o esvaziamento desse cache (cache flush) para discos que poderiam ter gravado o dado diretamente na metade do tempo. Você está pagando por baterias de lítio que vão inchar em três anos para proteger um cache que só está atrasando sua infraestrutura.

Topologia direta ao processador e a supremacia do RAID por software

A única topologia que faz sentido para armazenamento flash de alta performance é a conexão direta (Direct Attached). As pistas PCIe devem sair do processador (ou de um switch PCIe de baixíssima latência) e ir direto para o backplane passivo dos discos. Zero chips de tradução no meio.

Mas e a redundância? É aqui que o RAID por software moderno entra para humilhar o hardware legado. Sistemas de arquivos como o ZFS ou gerenciadores de volume como o mdadm do Linux utilizam a CPU principal do servidor para calcular a paridade.

Os defensores do hardware antigo dirão que isso "rouba processamento da CPU". Isso era verdade em 2005. Hoje, um processador AMD EPYC ou Intel Xeon moderno possui dezenas de núcleos e instruções vetoriais (como AVX) que calculam paridade RAID 5/6 em velocidades absurdas, consumindo uma fração minúscula do tempo de CPU.

Abaixo, um resumo de por que a abordagem por software venceu a guerra no ecossistema NVMe:

| Característica | Controladora Tri-mode (Hardware RAID) | Direct Attached + ZFS / mdadm (Software RAID) |

|---|---|---|

| Latência Adicional | Alta (Tradução NVMe para SCSI, gargalo no chip) | Quase nula (Comunicação direta CPU-Disco) |

| Custo de Implementação | Alto (Placa cara, cabos proprietários, baterias) | Baixo (Usa pistas PCIe nativas da placa-mãe) |

| Flexibilidade de Hardware | Preso ao fabricante da placa (Vendor Lock-in) | Portabilidade total (Basta mover os discos para outro servidor Linux/BSD) |

| Proteção contra Bit Rot | Inexistente na maioria das placas | Nativa no ZFS (Checksums em todos os blocos) |

Medindo a latência de cauda com Fio e provando o desperdício de silício

Não acredite na minha palavra. Se você tem um servidor com uma placa tri-mode no laboratório, faça o teste. Use a ferramenta fio (Flexible I/O Tester) no Linux para medir não apenas a latência média, mas a latência de cauda (tail latency), especificamente o percentil 99.9th. A latência de cauda é o que realmente causa os travamentos inexplicáveis na sua aplicação.

💡 Dica Pro: Ao rodar o

fio, configure um teste de leitura randômica de 4K com profundidade de fila (iodepth) baixa, simulando uma carga de banco de dados síncrona. Compare o resultado do disco passando pela placa RAID versus o mesmo disco espetado diretamente em um slot PCIe da placa-mãe. A diferença no percentil 99.9th costuma ser assustadora.

Você verá que a controladora introduz picos de latência erráticos. O chip da placa RAID simplesmente não consegue lidar com a quantidade de interrupções geradas por múltiplos drives NVMe operando no limite. O silício da controladora vira o gargalo do sistema inteiro.

O veredito pragmático para sua infraestrutura

A persistência das controladoras RAID de hardware no mundo do armazenamento NVMe é um triunfo do marketing sobre a engenharia. É a inércia de fabricantes de servidores que não querem mudar seus processos de vendas e de administradores de sistemas que têm medo de confiar no gerenciamento de volumes pelo sistema operacional.

Se você está desenhando uma infraestrutura nova, exija backplanes NVMe com conexão direta via PCIe. Utilize ZFS, mdadm, ou tecnologias de armazenamento definido por software (SDS) como vSAN ou Ceph, que foram desenhadas do zero para assumir o controle direto da mídia flash. Pare de pagar pedágio para chips lentos e deixe seus discos correrem na velocidade para a qual foram projetados. Seu banco de dados, e sua sanidade durante o plantão de madrugada, agradecem.

Referências & Leitura Complementar

NVM Express Base Specification: Documentação oficial do protocolo detalhando a arquitetura de filas diretas ao PCIe (nvmexpress.org).

SNIA Solid State Storage Performance Test Specification (PTS): Metodologia padrão da indústria para medição de latência e IOPS em mídia flash, essencial para entender o impacto de intermediários no barramento.

RFC 4122 / ZFS On-Disk Format: Para aprofundamento em como sistemas de arquivos modernos gerenciam integridade de dados sem depender de hardware dedicado.

O que é uma controladora tri-mode?

É um adaptador de barramento (HBA) ou placa RAID projetada para suportar discos SAS, SATA e NVMe no mesmo backplane. O problema é que ela frequentemente sacrifica a latência nativa e a largura de banda do NVMe em prol dessa conveniência de cabeamento e compatibilidade legada.Por que o RAID de hardware prejudica o NVMe?

O protocolo NVMe foi criado especificamente para comunicação direta com a CPU via barramento PCIe, eliminando intermediários. Inserir um chip RAID no meio adiciona saltos de processamento, tradução de protocolos (frequentemente voltando para SCSI) e gargalos de largura de banda, anulando a vantagem de microssegundos que você pagou caro para ter.Qual é a alternativa ao RAID de hardware para NVMe?

A abordagem correta e moderna é conectar os discos NVMe diretamente às pistas PCIe da placa-mãe (arquitetura Direct Attached). Para gerenciar a redundância sem criar gargalos de hardware, utiliza-se RAID por software robusto, como ZFS ou mdadm, aproveitando o poder massivo de processamento das CPUs atuais.

Roberto Uchoa

Sysadmin Veterano (Anti-Hype)

"Sobrevivente da bolha pontocom e do hype do Kubernetes. Troco qualquer arquitetura de microsserviços 'inovadora' por um script bash que funciona sem falhas há 15 anos. Uptime não é opcional."