A equação financeira da redução de dados: capacidade efetiva vs. custo de processamento

Análise FinOps sobre o trade-off entre economia de espaço (CAPEX) e overhead de CPU em storage primário. Descubra o verdadeiro TCO da desduplicação e compressão.

A economia do armazenamento de dados corporativo vive um paradoxo fundamental. Enquanto o custo por gigabyte de mídia flash (NAND) segue uma curva de queda histórica, o volume de dados não estruturados cresce em uma progressão geométrica que desafia qualquer orçamento de TI estático. Nesse cenário, os fabricantes de storage (All-Flash Arrays e HCI) vendem a "redução de dados" — desduplicação e compressão — como a bala de prata para o ROI.

No entanto, para o profissional de FinOps, aceitar a taxa de redução prometida pelo fabricante sem uma auditoria técnica é um erro de cálculo primário. A redução de dados não é mágica; é uma troca de recursos. Você está negociando ciclos de CPU e latência (performance) por espaço em disco (capacidade). Entender a "unit economics" dessa transação é o que separa uma infraestrutura eficiente de um gargalo dispendioso.

Resumo em 30 segundos

- A Ilusão da Capacidade Efetiva: Garantias de redução de 5:1 são médias de marketing. Seus dados reais (bancos criptografados, imagens) podem render 1:1, destruindo o TCO planejado.

- O Imposto da CPU: Desduplicação e compressão exigem processamento intenso. Em sistemas mal dimensionados, isso converte economia de CAPEX de disco em latência de IOPS inaceitável.

- Otimização Seletiva: A estratégia vencedora não é "ligar tudo", mas aplicar políticas granulares de redução baseadas na entropia do dado e na sensibilidade da carga de trabalho.

A armadilha da "Capacidade Efetiva" no TCO

O conceito de capacidade efetiva é a base de venda da maioria dos sistemas All-Flash modernos (Pure Storage, NetApp AFF, Dell PowerStore). A premissa é simples: você compra 100TB de flash bruto (Raw), mas o vendedor garante que você armazenará 500TB de dados lógicos. O custo por TB efetivo parece irrisório.

O problema financeiro reside na variabilidade. Diferente da capacidade bruta, que é um ativo fixo no balanço (CAPEX), a capacidade efetiva é uma probabilidade. Se a sua carga de trabalho principal for composta por bancos de dados Oracle já comprimidos ou arquivos de vídeo (alta entropia), a taxa de redução despenca.

Financeiramente, isso cria um risco de CAPEX não planejado. Se a taxa real for 2:1 em vez de 5:1, você precisará comprar mais que o dobro do hardware físico previsto para armazenar o mesmo volume de dados. O TCO (Total Cost of Ownership) projetado para 5 anos é invalidado no mês 6.

Figura: A discrepância entre a promessa de marketing da capacidade efetiva e a realidade física do armazenamento.

Figura: A discrepância entre a promessa de marketing da capacidade efetiva e a realidade física do armazenamento.

O custo oculto: CPU, Latência e IOPS

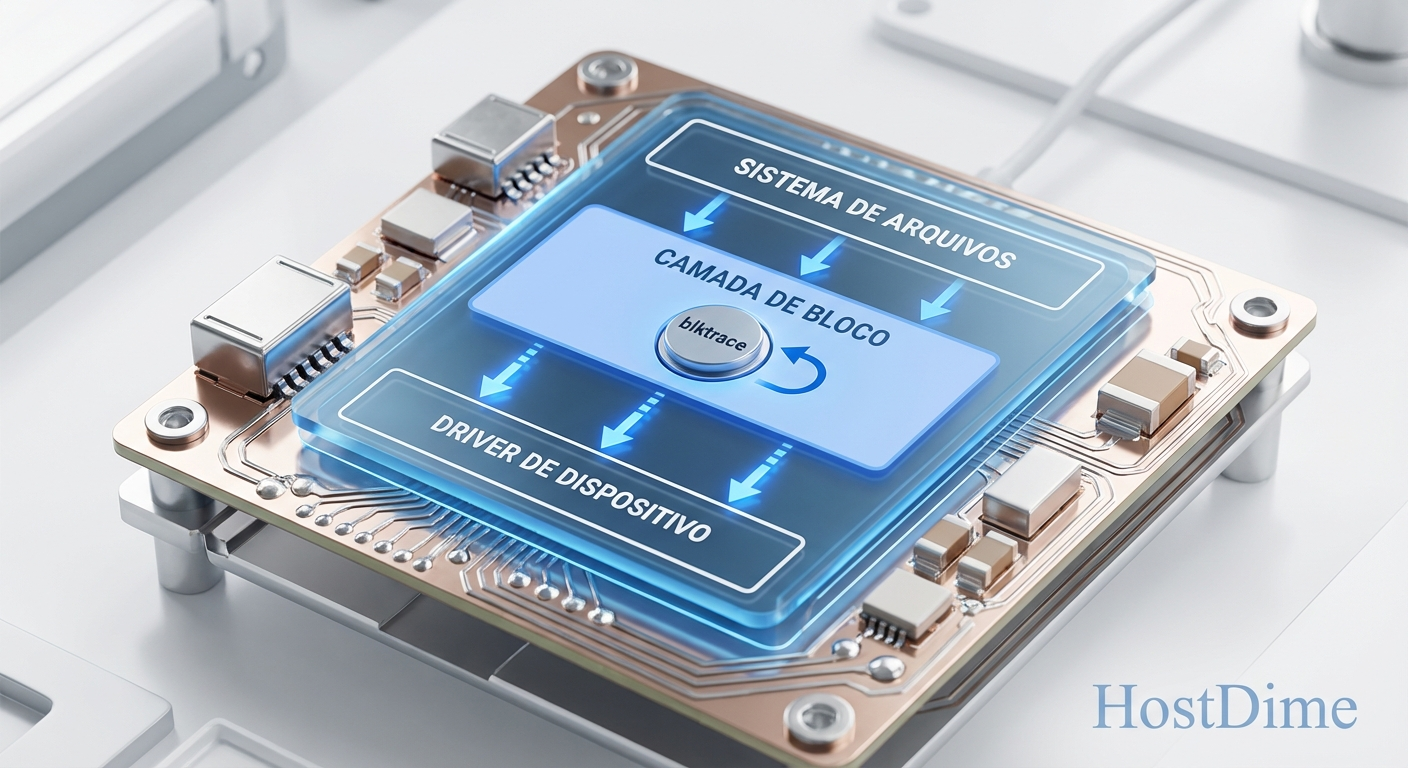

Na contabilidade de FinOps, nada é gratuito. A redução de dados exige que o controlador de storage (seja um appliance dedicado ou um nó de vSAN/Nutanix) execute algoritmos complexos em tempo real.

Desduplicação (Dedup): O sistema precisa calcular um hash (assinatura digital, geralmente SHA-1 ou SHA-256) para cada bloco de dados que entra, compará-lo com uma tabela de hashes existentes e decidir se grava o dado ou apenas um ponteiro.

Compressão: Algoritmos como LZ4 ou Zstd tentam reduzir a sequência de bits.

Isso é computação intensiva. Em arquiteturas legadas ou subdimensionadas, ativar a redução de dados inline (durante a gravação) pode aumentar a latência de gravação em 20% a 50%.

⚠️ Perigo: Em ambientes de Hyper-Converged Infrastructure (HCI), como VMware vSAN ou Nutanix, a CPU que faz a desduplicação é a mesma que roda suas VMs de aplicação. Uma política agressiva de economia de espaço pode roubar ciclos de processamento do seu ERP ou CRM, degradando a performance do negócio para economizar alguns reais em SSDs.

Modelagem financeira: Quando a redução vale a pena?

Para tomar a decisão correta, é necessário modelar o custo do "overhead" de processamento versus o custo da mídia NVMe/SSD economizada.

A equação deve considerar:

Custo da Mídia (Flash): Quanto custa o TB de NVMe Enterprise? (Tendência de queda).

Custo de Computação: Quanto custa o core de CPU (ou DPU/SmartNIC) necessário para processar a redução?

Custo de Oportunidade (Latência): Qual o impacto financeiro se a latência de disco subir de 0.5ms para 2ms?

Se o custo da mídia é alto (ex: Optane ou NVMe de ultra-performance), gastar CPU para reduzir dados é um excelente negócio. Se a mídia é barata (ex: QLC NAND de alta densidade), o custo de processamento e a complexidade de gestão podem superar a economia de espaço.

Comparativo: Estratégia Bruta vs. Estratégia de Redução

| Variável | Estratégia Raw Capacity (Sem Redução) | Estratégia Capacidade Efetiva (Redução Ativa) |

|---|---|---|

| Previsibilidade de Custo | Alta (O que você compra é o que você tem) | Média/Baixa (Depende da natureza do dado) |

| Impacto na Latência | Nulo (IOPS direto no silício) | Médio/Alto (Overhead de CPU/Hash) |

| Uso de CPU/Controladora | Baixo | Intenso (Pode exigir hardware dedicado/DPUs) |

| Cenário Ideal | Bancos de dados transacionais, Mídia criptografada, HPC | VDI (Virtual Desktop), Bancos de Homologação, Backups |

| Risco FinOps | Subutilização de espaço (Overprovisioning) | Estouro de orçamento por baixa taxa de redução |

O papel das novas tecnologias: DPUs e Offload

A indústria de hardware respondeu a esse dilema financeiro com a introdução de DPUs (Data Processing Units) e placas aceleradoras (como Intel QAT). A ideia é retirar a carga de compressão/desduplicação da CPU principal (x86) e movê-la para um silício dedicado.

Do ponto de vista de FinOps, isso altera o CAPEX. Você paga mais caro pelo hardware inicial (servidores com DPUs), mas recupera esse investimento ao:

Liberar licenças de software (muitas vezes cobradas por core de CPU) para a aplicação real.

Manter a performance de latência próxima da nativa, viabilizando a redução de dados até em workloads de missão crítica.

Figura: O fluxo de dados sendo processado por hardware dedicado (DPU), liberando a CPU principal e otimizando o custo por transação.

Figura: O fluxo de dados sendo processado por hardware dedicado (DPU), liberando a CPU principal e otimizando o custo por transação.

Otimização como alavanca de reinvestimento

A meta final não é apenas "cortar custos", mas maximizar o valor extraído de cada IOPS. Se a sua análise de dados mostra que 80% do seu armazenamento é "dado frio" (acessado raramente), a compressão agressiva (ou algoritmos mais pesados como GZIP) faz sentido financeiro, pois a latência de acesso ocasional é tolerável.

Por outro lado, para os 20% de "dados quentes", a abordagem FinOps correta pode ser desativar a redução de dados. Sim, você gastará mais em disco, mas evitará o churn de clientes causado por lentidão no sistema.

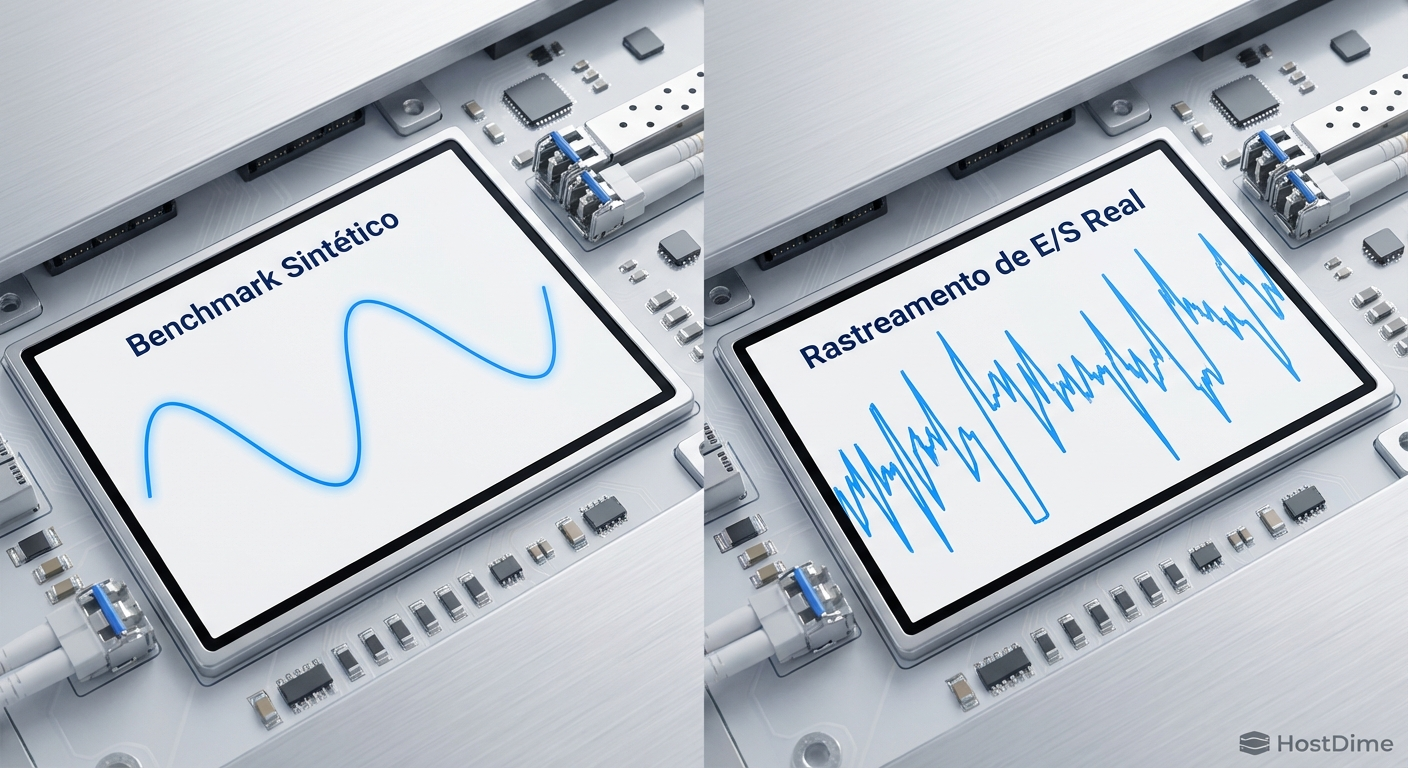

💡 Dica Pro: Utilize ferramentas de análise de infraestrutura (como RVTools, Live Optics ou telemetria nativa do storage array) para auditar a "compressibilidade" dos seus dados antes de assinar a renovação do contrato de storage. Peça uma POC (Prova de Conceito) com seus dados reais, não com os dados sintéticos do fabricante.

O Veredito FinOps

A redução de dados é uma ferramenta financeira poderosa, mas não é um padrão universal. O erro mais comum é tratar a capacidade efetiva como um fato contábil garantido. Ela é uma variável especulativa.

Para o gestor financeiro de TI, a recomendação é clara: exija transparência sobre o overhead de performance. Em um mundo onde o armazenamento QLC de alta densidade está tornando o gigabyte cada vez mais barato, o custo da computação (CPU) para comprimir esse dado pode, ironicamente, tornar-se o item mais caro da fatura. Modele seu TCO baseando-se no pior cenário de redução, e qualquer ganho acima disso será lucro operacional, não uma medida desesperada para evitar a compra de novos discos.

FAQ: Perguntas Frequentes sobre Redução de Dados

Qual a diferença entre capacidade bruta (raw) e capacidade efetiva em storage?

Capacidade bruta é o espaço físico total dos discos (SSDs/NVMe) instalados no chassi. Capacidade efetiva é uma estimativa comercial de quanto dado lógico pode ser armazenado após aplicar técnicas de redução como desduplicação e compressão. Essa métrica varia drasticamente conforme o tipo de dado (texto comprime bem; vídeo criptografado, não).A desduplicação afeta a performance de bancos de dados transacionais?

Sim. A desduplicação inline (feita no momento da gravação) exige ciclos de CPU para calcular hashes e verificar tabelas de metadados antes de confirmar a escrita. Em workloads de alta frequência e baixa latência (OLTP), isso introduz um overhead perceptível, tornando o custo computacional e a perda de performance mais caros que a economia de espaço em disco.Vale a pena ativar compressão em dados já criptografados ou comprimidos?

Financeiramente, não. Dados com alta entropia (como vídeos, imagens JPEG ou backups já criptografados pela aplicação) não sofrem redução significativa. Tentar comprimi-los resulta em desperdício de recursos de processamento (OPEX/Energia) e aumento de latência, sem gerar ganho real de capacidade de armazenamento (CAPEX).

Arthur Costas

Especialista em FinOps

"Transformo infraestrutura em números. Meu foco é reduzir TCO, equilibrar CAPEX vs OPEX e garantir que cada centavo investido no datacenter traga ROI real."