A ilusão do contexto infinito: como a arquitetura STX da NVIDIA joga o cache KV para os SSDs NVMe

A NVIDIA promete revolucionar a IA agêntica expandindo o cache KV para SSDs NVMe. Mas o barramento PCIe e a vida útil dos discos aguentam o tranco? Desmontamos o marketing.

A febre da inteligência artificial generativa trouxe uma promessa sedutora de contexto infinito. Modelos que conseguem ler livros inteiros e lembrar de cada vírgula em uma única interação. O marketing das grandes fabricantes adora vender essa ideia como um milagre puro de processamento. A realidade técnica é bem menos glamourosa e envolve um truque pesado de infraestrutura de armazenamento.

Resumo em 30 segundos

- O cache KV (Key-Value), essencial para a memória da IA, estourou o limite físico das caríssimas memórias HBM das GPUs.

- A arquitetura STX da NVIDIA resolve isso fazendo o offload direto desse cache para SSDs NVMe de alta capacidade.

- Essa manobra destrói a vida útil dos discos comuns, exigindo drives de classe enterprise com altíssimo DWPD.

O gargalo da memória HBM e o peso do cache KV

Para entender o truque por trás do contexto infinito, precisamos olhar para o cache KV (Key-Value). Ele funciona como a memória de curto prazo de um modelo de linguagem (LLM). Cada palavra gerada precisa do contexto anterior armazenado para fazer sentido. O problema estrutural é que esse histórico cresce de forma exponencial a cada novo prompt.

As GPUs modernas voltadas para IA utilizam memória HBM (High Bandwidth Memory). Ela é absurdamente rápida e fica colada no processador gráfico, mas tem capacidade física limitada e custa uma fortuna. Uma GPU topo de linha bate no teto de algumas centenas de gigabytes de memória de vídeo. Para atingir milhões de tokens de contexto, a conta em gigabytes simplesmente não fecha no silício da placa. A memória enche muito antes do modelo terminar de "pensar".

Dissecando o datapath da arquitetura STX

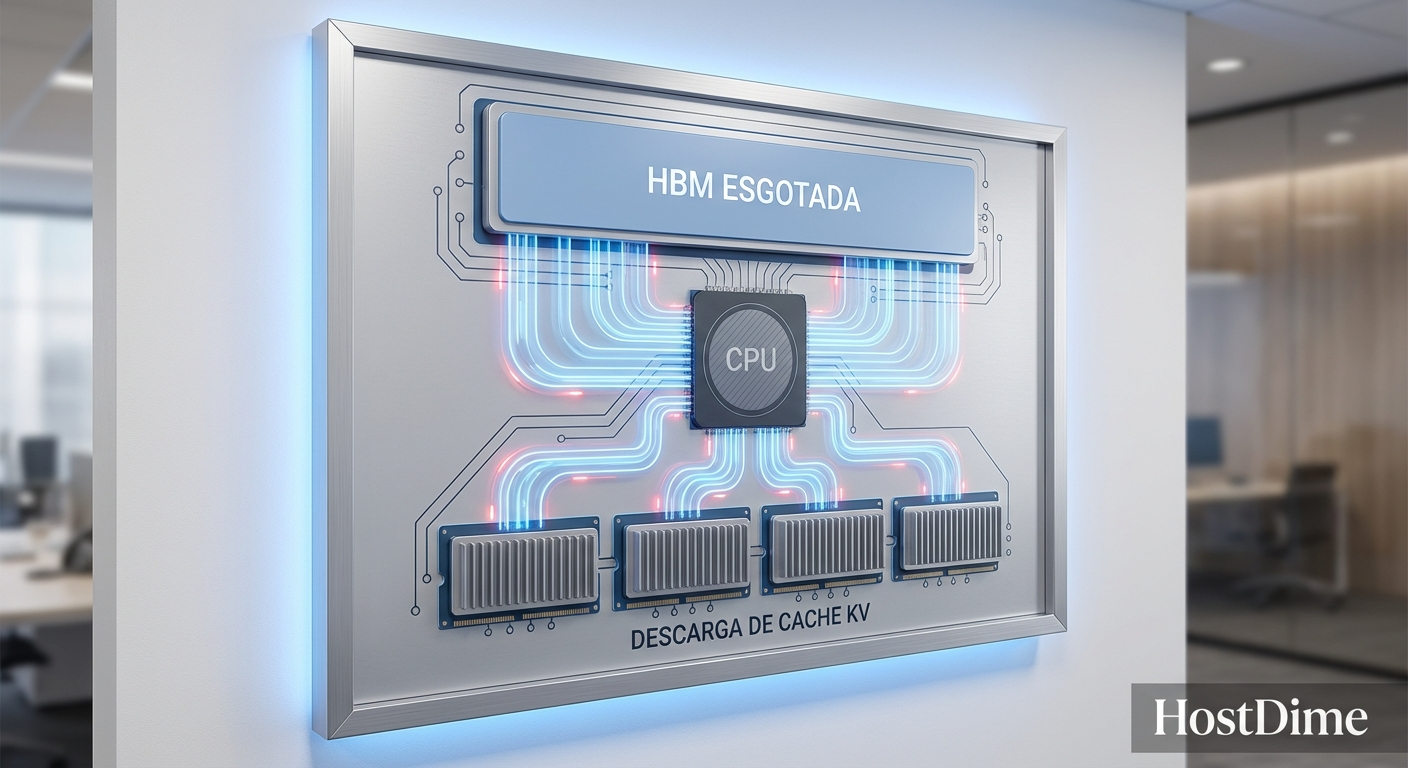

É aqui que entra a arquitetura de placa de sistema de servidor da NVIDIA, conhecida como STX. O material promocional foca nos teraflops de processamento, mas o verdadeiro pulo do gato está no roteamento de dados (datapath). Como a memória de vídeo não dá conta do volume, a engenharia precisou descer o cache KV para o armazenamento físico do servidor.

A arquitetura STX cria vias expressas no barramento PCIe (Peripheral Component Interconnect Express). Em vez de a GPU pedir para a CPU buscar dados no disco, o sistema usa tecnologias de acesso direto à memória. O chip gráfico joga os blocos gigantescos de cache KV diretamente para as trilhas dos SSDs NVMe instalados no chassi.

Figura: Diagrama conceitual do datapath direto entre GPU e SSDs NVMe na arquitetura STX

Figura: Diagrama conceitual do datapath direto entre GPU e SSDs NVMe na arquitetura STX

Essa manobra de engenharia transforma o armazenamento de estado sólido em uma extensão direta da memória da placa de vídeo. Para situar o impacto dessa mudança, precisamos comparar as duas tecnologias frente a frente.

| Característica | Memória HBM3e (GPU) | SSD NVMe Enterprise (PCIe Gen5) |

|---|---|---|

| Função no LLM | Processamento ativo e imediato | Offload de cache KV (Contexto longo) |

| Capacidade Típica | 144GB a 192GB por chip | 15TB a 30TB por drive |

| Latência | Nanosegundos | Microsegundos (Gargalo do PCIe) |

| Custo por GB | Altíssimo | Baixo |

O que o marketing esconde sobre latência e vida útil

O slide de apresentação no palco diz que o contexto agora é ilimitado. O que os executivos não gritam aos quatro ventos é a penalidade física dessa manobra. O barramento PCIe Gen5 é incrivelmente rápido para os padrões de storage tradicional, mas é uma eternidade comparado à memória interna da GPU.

Quando o modelo precisa resgatar um contexto antigo que foi salvo no SSD, ocorre um pico inevitável de latência. A IA "engasga" por microsegundos esperando o dado subir do disco para o processador. Mas o segredo mais sujo dessa arquitetura não é a velocidade, e sim a degradação acelerada do hardware.

⚠️ Perigo: O tráfego de cache KV não é uma gravação sequencial limpa. São leituras e gravações aleatórias, constantes e massivas. Isso tritura as células de memória NAND Flash dos SSDs em tempo recorde.

O impacto nos datacenters e a corrida pelo DWPD

Colocar um SSD NVMe comum em um servidor rodando IA agêntica com offload de cache KV é assinar uma sentença de morte para o disco. Em questão de semanas, ou até dias dependendo da carga de trabalho, o disco esgota seus ciclos de gravação e entra em modo de proteção de apenas leitura.

Isso forçou a indústria de storage a uma corrida armamentista por resistência. A métrica DWPD (Drive Writes Per Day, ou Gravações Completas do Drive por Dia) voltou a ser o fator mais crítico na compra de armazenamento para inteligência artificial. Datacenters estão abandonando drives de uso geral e migrando para formatos densos e termicamente eficientes como E1.S e E3.S, que fazem parte dos padrões do consórcio EDSFF (Enterprise & Data Center Standard Form Factor).

Esses novos drives enterprise precisam suportar 3, 5 ou até 10 regravações completas de sua capacidade todos os dias durante anos. O custo financeiro que foi economizado ao não comprar mais memória HBM acaba sendo transferido, em grande parte, para a renovação constante da infraestrutura de storage de alta resistência.

O futuro da inteligência artificial não depende apenas de chips gráficos com litografias menores. A verdadeira batalha pelo contexto infinito será travada nas trincheiras do armazenamento de dados. Prepare-se para ver fabricantes de storage lançando linhas de SSDs rotulados como "AI-Ready", cobrando um prêmio absurdo apenas por oferecerem controladores otimizados para o padrão de desgaste agressivo do cache KV. A ilusão do contexto infinito existe no software, mas a fatura do desgaste do silício NAND sempre chega para o administrador do datacenter.

O que é o cache KV na infraestrutura de inteligência artificial?

É uma memória temporária (Key-Value) usada por modelos de linguagem (LLMs) para armazenar o contexto de uma interação. Ele evita que a GPU precise recalcular dados antigos a cada novo prompt gerado.Por que transferir o cache KV da memória de vídeo para SSDs NVMe?

A memória de vídeo (HBM/VRAM) é extremamente cara e fisicamente limitada. Fazer o offload para SSDs NVMe permite expandir a janela de contexto da IA para milhões de tokens por uma fração do custo de hardware.O uso de SSDs para cache de IA diminui a vida útil do disco?

Sim, drasticamente. O tráfego constante de leitura e gravação do cache KV gera um desgaste massivo nas células NAND. Isso exige o uso exclusivo de SSDs de classe enterprise com alto DWPD (Drive Writes Per Day), inviabilizando discos de consumo.

Marcus Duarte

Tradutor de Press Release

"Ignoro buzzwords e promessas de marketing para focar no que realmente importa: especificações técnicas, benchmarks reais e as letras miúdas que os fabricantes tentam esconder."