Controladoras Tri-mode e o freio de mão no NVMe: análise de gargalos em RAID

Descubra por que placas RAID Tri-mode podem reduzir a performance de SSDs NVMe Gen4 e Gen5. Análise técnica de latência, throughput e alternativas via software.

A evolução do armazenamento empresarial nos últimos cinco anos criou um paradoxo interessante no design de servidores. Enquanto as mídias de armazenamento deram um salto quântico de performance com a transição do protocolo SAS/SATA para o NVMe, a infraestrutura legada de gerenciamento de RAID lutou para acompanhar esse ritmo. Nesse cenário, surgiram as controladoras "Tri-mode", prometendo o santo graal da flexibilidade: uma única placa capaz de gerenciar HDDs SAS, SSDs SATA e os ultrarrápidos SSDs NVMe.

No papel, a proposta é elegante e simplifica a lista de materiais (BOM) dos integradores de sistemas. Na prática, porém, ao conectar drives NVMe de alto desempenho a uma controladora RAID tradicional, você pode estar introduzindo um gargalo severo em sua infraestrutura. Vamos analisar tecnicamente por que o hardware dedicado de RAID, outrora rei do datacenter, tornou-se um "freio de mão" para a tecnologia NVMe moderna.

Resumo em 30 segundos

- Gargalo de Interface: Controladoras Tri-mode geralmente operam em x8 PCIe, limitando a largura de banda total a cerca de 14-16 GB/s, o que é facilmente saturado por apenas dois SSDs NVMe Gen4.

- Latência Adicional: A arquitetura ROC (RAID on Chip) insere um intermediário no caminho de dados, anulando a principal vantagem do NVMe: a comunicação direta com a CPU.

- Software é o Novo Hardware: Com CPUs modernas possuindo dezenas de núcleos, o custo de processamento de RAID via software (VROC, mdraid, ZFS) é negligenciável comparado ao ganho de performance e economia de hardware.

A promessa da versatilidade contra a realidade da largura de banda

As controladoras Tri-mode (Broadcom, Microchip) foram projetadas para resolver um problema de transição. Datacenters raramente são homogêneos; eles possuem uma mistura de armazenamento frio (HDDs), morno (SATA SSDs) e quente (NVMe). O padrão U.3, por exemplo, permite que o mesmo slot de backplane aceite qualquer um desses drives, desde que a controladora suporte.

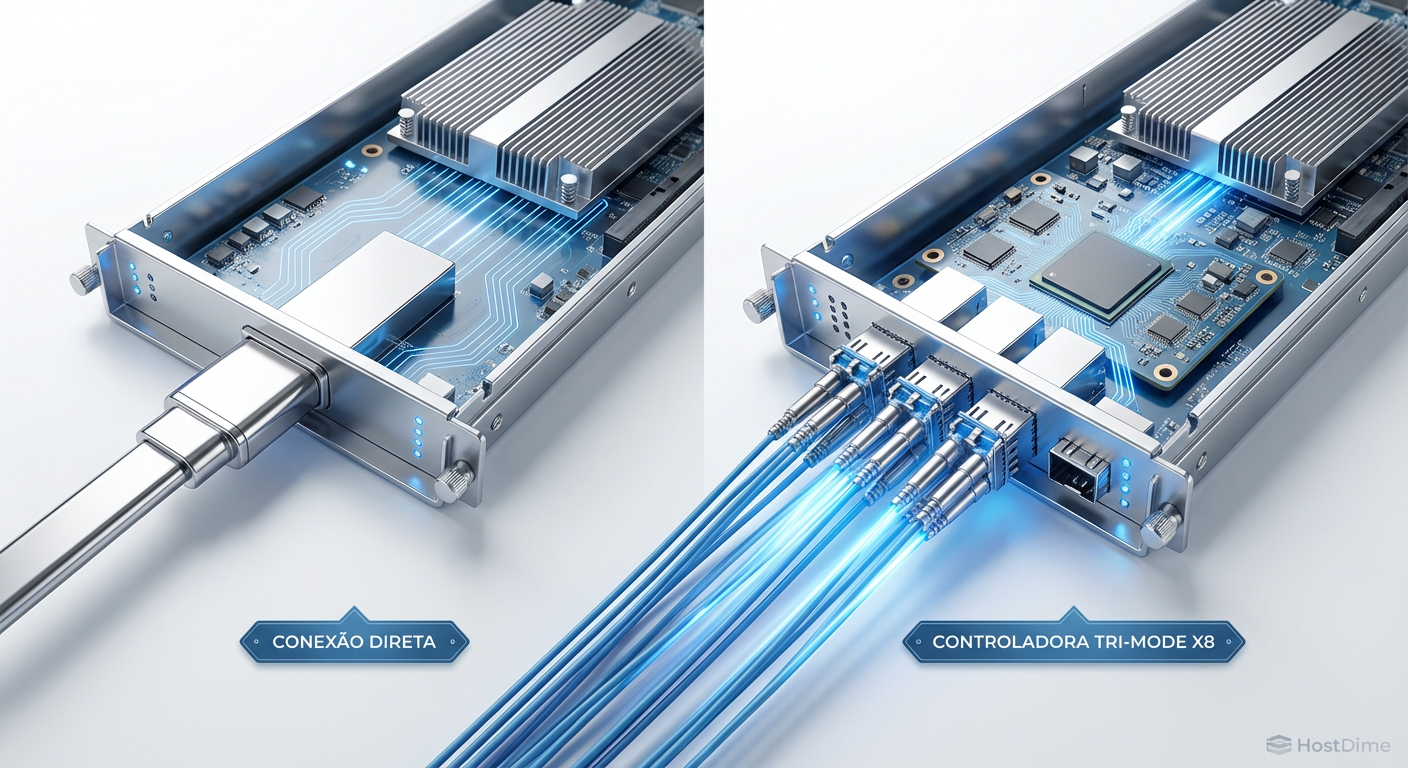

O problema reside na matemática básica da interface PCIe. A maioria das placas RAID Tri-mode de mercado, mesmo as de geração atual (Gen4), utiliza uma interface host PCIe x8.

Vamos aos números: um slot PCIe 4.0 x8 oferece uma largura de banda teórica máxima de aproximadamente 16 GB/s (bidirecional, mas focamos na leitura/escrita sustentada). Um único SSD NVMe Enterprise Gen4 de alta performance (como um Kioxia CM6 ou um Micron 7450) pode entregar, sozinho, cerca de 7 GB/s de leitura sequencial.

Figura: Comparativo visual de largura de banda: Direct Attach vs. Controladora Tri-mode x8.

Figura: Comparativo visual de largura de banda: Direct Attach vs. Controladora Tri-mode x8.

Isso significa que com apenas dois drives NVMe, você já saturou a capacidade de comunicação da controladora com a CPU. Se você popular um servidor com 8 ou 16 drives NVMe conectados a essa única placa, o desperdício de performance é catastrófico. Você pagou por performance de Ferrari (NVMe), mas está dirigindo em uma estrada de terra (o barramento x8 da controladora).

Entendendo a arquitetura ROC e o problema da latência

A largura de banda é apenas metade da história. Para cargas de trabalho transacionais, como bancos de dados SQL ou NoSQL, a latência e os IOPS (operações de entrada e saída por segundo) são reis. O protocolo NVMe foi desenhado especificamente para reduzir a latência, eliminando a pilha de comandos SCSI legada e permitindo paralelismo massivo (64 mil filas de comando).

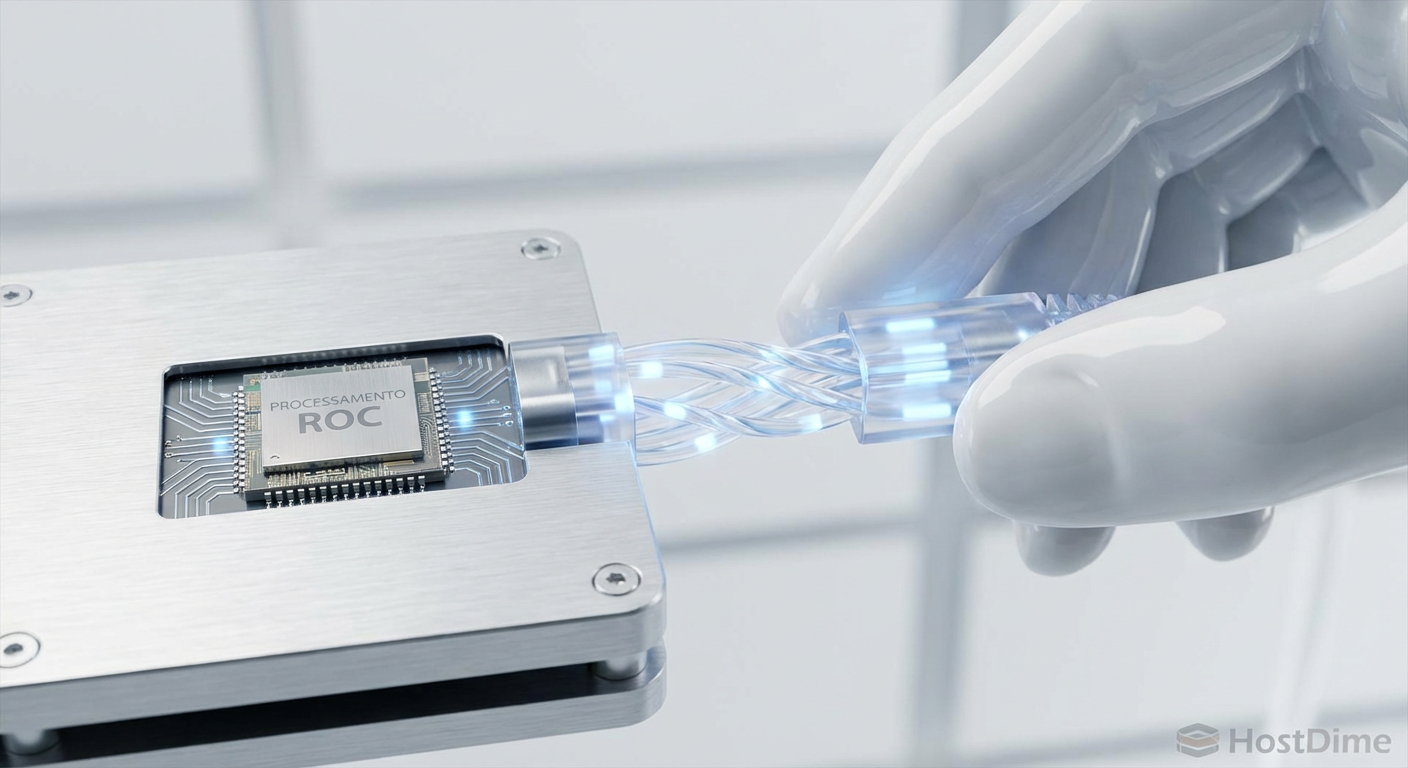

Quando inserimos uma controladora RAID de hardware no meio, reintroduzimos a latência. O fluxo de dados muda de:

Direct Attach: CPU -> Barramento PCIe -> Drive NVMe.

Hardware RAID: CPU -> Barramento PCIe -> Chip ROC (Processamento, Cache, XOR) -> Interface PCIe da Placa -> Drive NVMe.

O processador da placa (ROC - RAID on Chip) precisa interceptar cada comando, calcular paridade (em RAID 5/6), gerenciar o cache e despachar o dado. Em discos mecânicos, onde a latência é medida em milissegundos, esse overhead de microssegundos era irrelevante. Em NVMe, onde a latência é medida em dezenas de microssegundos, o overhead da controladora pode dobrar ou triplicar o tempo de resposta.

⚠️ Perigo: Em testes de latência de cauda (p99), controladoras RAID tendem a apresentar picos de latência imprevisíveis sob carga pesada, o que pode causar timeouts em aplicações sensíveis.

Figura: O caminho tortuoso dos dados: a latência introduzida pelo processamento do ROC.

Figura: O caminho tortuoso dos dados: a latência introduzida pelo processamento do ROC.

Benchmarks sintéticos e o teto de vidro

Ao analisarmos benchmarks de laboratório, o comportamento de "teto de vidro" fica evidente. Em um teste sequencial de leitura (128K), ao adicionar drives em uma configuração Direct Attach (conectados diretamente às lanes PCIe da CPU), a performance escala quase linearmente.

| Configuração | Direct Attach (Gen4) | Tri-mode RAID Card (x8 Gen4) | Perda de Performance |

|---|---|---|---|

| 1x NVMe SSD | ~7.000 MB/s | ~6.800 MB/s | ~3% |

| 2x NVMe SSD | ~14.000 MB/s | ~13.500 MB/s | ~4% |

| 4x NVMe SSD | ~28.000 MB/s | ~14.500 MB/s | ~48% |

| 8x NVMe SSD | ~56.000 MB/s | ~14.500 MB/s | ~74% |

A tabela acima ilustra o colapso. A partir do terceiro drive, a controladora se torna um gargalo intransponível. Para obter a performance total de 8 drives NVMe via hardware, você precisaria de múltiplas controladoras ou placas exóticas com interfaces x16 (que ainda assim limitariam o total), aumentando drasticamente o custo e a complexidade térmica do servidor.

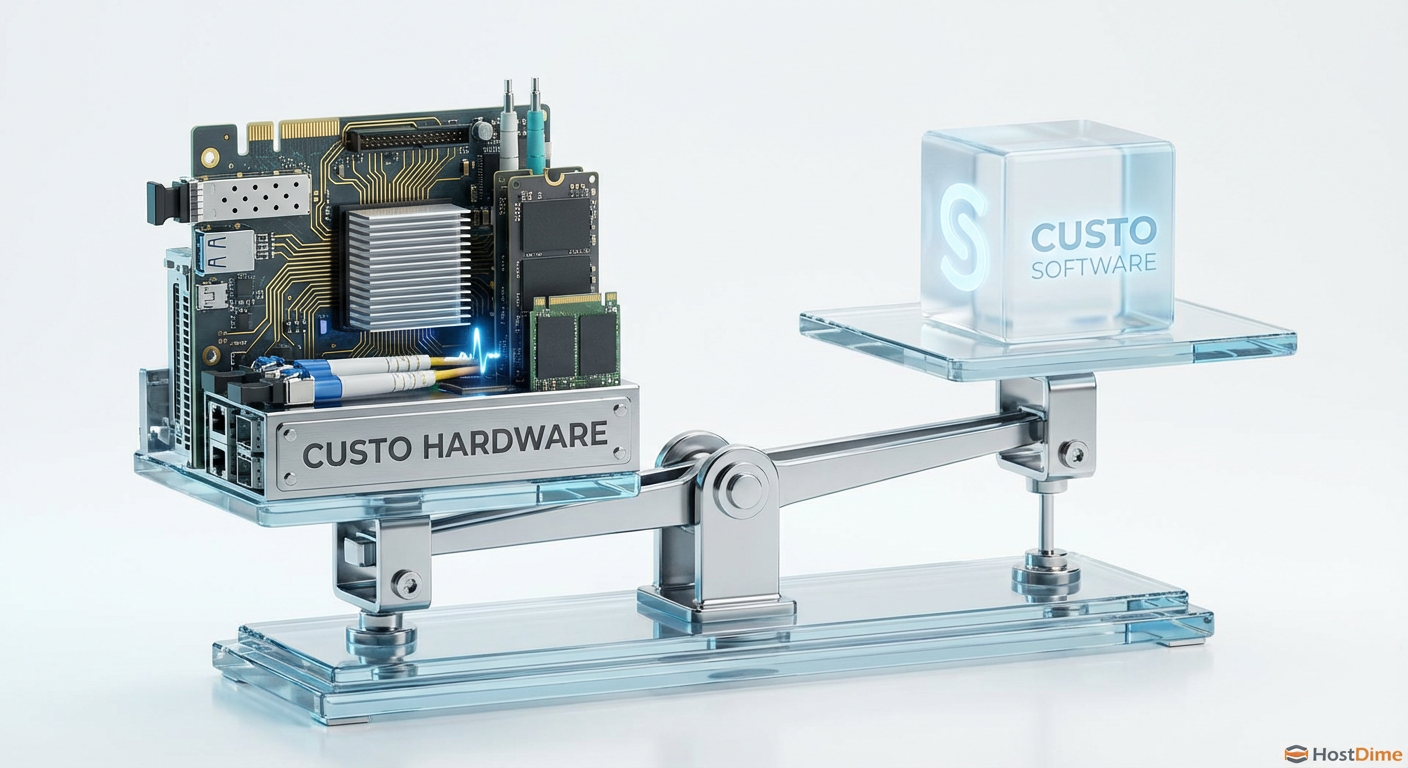

Custo de aquisição versus penalidade de CPU

O argumento histórico para o uso de placas RAID dedicadas era o "offload" de CPU. Há 15 anos, calcular paridade XOR para um RAID 5 consumia recursos preciosos de processadores dual-core. Hoje, em um mundo de processadores EPYC e Xeon com 32, 64 ou até 128 núcleos, esse argumento perdeu a validade.

O custo de CPU para gerenciar um RAID via software (seja Intel VROC, mdraid no Linux ou ZFS) é quase imperceptível em cargas modernas. Testes indicam que o impacto raramente excede 2-5% de uso de CPU, mesmo sob reconstrução de array.

Financeiramente, a comparação é brutal. Uma controladora Tri-mode decente com 4GB ou 8GB de cache e proteção por supercapacitor (BBU) custa facilmente entre R$ 3.000 e R$ 6.000. Esse valor poderia ser investido em:

Drives NVMe de maior capacidade ou maior durabilidade (DWPD).

Mais memória RAM para cache de sistema de arquivos (que acelera leituras muito mais que o cache da controladora).

Upgrade de CPU.

Figura: A balança desequilibrada: o alto custo financeiro do hardware versus o baixo custo computacional do software.

Figura: A balança desequilibrada: o alto custo financeiro do hardware versus o baixo custo computacional do software.

Cenários onde o hardware dedicado ainda faz sentido

Seria irresponsável decretar a morte absoluta das controladoras RAID. Elas ainda possuem nichos específicos onde resolvem problemas que o software puro ainda luta para mitigar, especialmente fora do ecossistema Linux Enterprise.

1. Boot Redundante e Independência de SO

Se você precisa de um volume de boot em RAID 1 que seja totalmente transparente para o sistema operacional (ex: VMware ESXi, que tem suporte limitado a RAID de software), a controladora de hardware é a solução mais robusta. Ela apresenta um único volume lógico para o instalador, simplificando o deploy.

2. Suporte a Sistemas Legados

Sistemas operacionais antigos (Windows Server 2012/2016 ou distros Linux antigas) podem não ter drivers NVMe nativos otimizados ou suporte robusto a tecnologias como Intel VMD (Volume Management Device). Nesses casos, a controladora abstrai a complexidade do NVMe e apresenta volumes SCSI padrão.

3. Cabeamento e Backplanes Híbridos

Em servidores de alta densidade, gerenciar cabos para 24 drives NVMe Direct Attach pode ser um pesadelo de fluxo de ar e organização. Controladoras Tri-mode permitem o uso de cabos slimline de alta densidade e backplanes expansores, limpando o interior do chassi, embora ao custo da performance já discutida.

Figura: Organização interna: a vantagem física do cabeamento simplificado via controladora.

Figura: Organização interna: a vantagem física do cabeamento simplificado via controladora.

O veredito para a infraestrutura moderna

A era de ouro das controladoras RAID como padrão de facto para performance acabou. Para implementações modernas focadas em NVMe, a controladora Tri-mode atua mais como um limitador de velocidade do que como um acelerador.

Se o seu objetivo é extrair cada IOPS e MB/s pelos quais você pagou em seus SSDs NVMe, a topologia Direct Attach combinada com RAID via software (ou replicação a nível de aplicação, como em clusters Ceph, vSAN ou SQL AlwaysOn) é o caminho tecnicamente superior. Reserve as placas RAID para gerenciar seus discos rotacionais (HDDs) ou para volumes de boot específicos, mas mantenha-as longe do caminho de dados das suas cargas de trabalho de alta performance.

Perguntas Frequentes (FAQ)

O que é exatamente uma controladora Tri-mode?

É uma placa adaptadora de armazenamento (RAID ou HBA) projetada para comunicar-se com três protocolos diferentes: SAS, SATA e NVMe. Ela permite que servidores usem backplanes universais (como U.3), onde o mesmo slot físico pode receber qualquer tipo de disco, oferecendo flexibilidade de configuração sem troca de hardware interno.Por que o RAID de hardware diminui a velocidade do NVMe?

O NVMe foi criado para conectar o armazenamento diretamente ao processador via PCIe. Ao usar uma placa RAID, você insere um "homem no meio". A controladora limita a largura de banda total à sua própria interface (geralmente x8, ou ~16GB/s), que é muito menor que a soma da velocidade dos drives. Além disso, o processamento do chip da placa adiciona latência a cada comando.O Intel VROC ou AMD RAID são melhores que placas dedicadas?

Para performance em NVMe, sim. Tecnologias como Intel VROC (Virtual RAID on CPU) permitem que os drives mantenham a conexão direta com as lanes PCIe da CPU (*Direct Attach*), evitando gargalos de hardware. Embora usem ciclos do processador para cálculos de RAID, em CPUs modernas esse impacto é insignificante frente ao ganho massivo de largura de banda e redução de latência.Ainda existe algum motivo para usar placas RAID com NVMe?

Sim, mas são casos de nicho. Elas são úteis para garantir redundância de boot (RAID 1) em sistemas que não suportam RAID de software nativamente (como versões antigas do VMware ESXi), para suportar sistemas operacionais legados sem drivers NVMe modernos, ou para simplificar o cabeamento interno em servidores com backplanes híbridos complexos.

Lucas Ferreira

Engenheiro de Observabilidade

"Transformo o caos de logs, métricas e traces em clareza operacional. Minha missão é eliminar pontos cegos e garantir que nada permaneça invisível na infraestrutura."