I/O em escala agêntica: O colapso do storage corporativo na era da IA

Descubra por que arquiteturas tradicionais de storage falham quando agentes de IA substituem humanos e como tecnologias como CXL e NVMe-oF moldarão o futuro da infraestrutura.

Estamos testemunhando o fim de uma era na arquitetura de datacenters. Durante as últimas décadas, projetamos nossos sistemas de armazenamento corporativo para atender a um mestre muito específico e previsível. Esse mestre era o ser humano. Nossos arrays de discos, redes SAN (Storage Area Network) e hypervisors foram esculpidos para lidar com a latência cognitiva de usuários que clicam, leem e pausam. Hoje, essa premissa está morta.

A ascensão da Inteligência Artificial generativa e dos modelos de linguagem não mudou apenas o processamento. Ela criou uma nova espécie de consumidor de dados. Os agentes autônomos não dormem, não pausam para o café e não leem uma página por vez. Eles operam em enxames, gerando uma tempestade de requisições de leitura e gravação que está fraturando a espinha dorsal do storage corporativo tradicional.

Resumo em 30 segundos

- Agentes de IA geram padrões de leitura e gravação ininterruptos e massivamente paralelos.

- Arquiteturas tradicionais baseadas em barramentos PCIe e CPUs host se tornarão gargalos físicos.

- Tecnologias como CXL e armazenamento computacional transformarão discos em extensões diretas da memória RAM.

A transição silenciosa para os enxames autônomos

A evolução tecnológica raramente avisa quando cruza um ponto de não retorno. No ecossistema de infraestrutura de TI, essa travessia ocorreu quando deixamos de otimizar o armazenamento para aplicações monolíticas e passamos a alimentar redes neurais. O I/O (Input/Output) deixou de ser uma via de mão dupla controlada para se tornar um campo de batalha de concorrência extrema.

Quando múltiplos agentes de IA colaboram em uma tarefa complexa, eles acessam bancos de dados vetoriais, leem terabytes de contexto histórico e gravam logs de decisão simultaneamente. Esse comportamento cria o que chamo de I/O em escala agêntica. É um padrão de acesso aos dados que desafia todas as heurísticas de cache que desenvolvemos nos últimos vinte anos.

Os algoritmos de predição de leitura dos storages enterprise atuais assumem que os dados serão acessados de forma sequencial ou com alguma localidade lógica. Os enxames agênticos, no entanto, buscam correlações em pontos aleatórios de petabytes de dados não estruturados. O resultado é uma taxa de acerto de cache próxima a zero.

O abismo entre o I/O humano e a tempestade das máquinas

Para entender a gravidade desse colapso, precisamos olhar para a física da movimentação de dados. Um usuário humano interagindo com um sistema ERP gera picos de I/O seguidos por longos vales de inatividade. O storage respira. Os buffers se esvaziam. As rotinas de garbage collection dos SSDs (Solid State Drives) operam em segundo plano.

Na escala agêntica, não há vales. A curva de demanda é uma linha reta no limite máximo da capacidade do hardware. Quando milhares de instâncias de IA consultam um cluster de armazenamento simultaneamente, a latência de cauda dispara. O tempo de resposta, que deveria ser de microssegundos, degrada para milissegundos, paralisando o raciocínio da máquina.

Figura: Comparação visual entre o tráfego de dados humano e a tempestade de I/O gerada por agentes de IA

Figura: Comparação visual entre o tráfego de dados humano e a tempestade de I/O gerada por agentes de IA

A infraestrutura de storage atual tenta resolver isso com força bruta. Adicionamos mais gavetas de discos, multiplicamos os caminhos de fibra óptica e compramos controladoras mais caras. Mas essa abordagem linear é inútil contra um problema de crescimento exponencial. O gargalo não está mais na mídia magnética ou no silício da memória flash. O gargalo está na arquitetura de comunicação.

Por que controladoras all-flash saturam sob concorrência agêntica

A adoção do protocolo NVMe (Non-Volatile Memory Express) foi um salto evolutivo brilhante. Ele permitiu que os SSDs conversassem diretamente com o barramento do servidor, eliminando as antigas restrições dos protocolos criados para discos rígidos mecânicos. No entanto, o NVMe ainda obedece a uma hierarquia onde a CPU do servidor atua como o maestro de todas as operações.

⚠️ Perigo: Adicionar mais discos NVMe de altíssima performance em um servidor tradicional não resolve o problema da IA. Você apenas move o gargalo da mídia de armazenamento para a fila de interrupções da CPU do host.

Quando um enxame de agentes dispara milhões de requisições IOPS (Input/Output Operations Per Second), a CPU do servidor de storage gasta a maior parte de seus ciclos de clock apenas gerenciando interrupções de hardware. Ela para de processar a lógica do hypervisor ou do sistema de arquivos e passa a atuar como um mero sinaleiro de trânsito sobrecarregado.

É nesse ponto que as controladoras all-flash tradicionais entram em colapso. Elas foram desenhadas para agregar discos e apresentar volumes lógicos para a rede. Sob a pressão agêntica, a sobrecarga de gerenciar metadados, deduplicação e paridade em tempo real consome toda a banda interna da controladora.

O limite físico do barramento PCIe e a ilusão do cache

O coração de qualquer servidor de storage moderno é o barramento PCIe (Peripheral Component Interconnect Express). Ele é a rodovia por onde todos os dados trafegam entre os discos, a memória RAM e a CPU. Apesar de suas gerações cada vez mais rápidas, o PCIe possui limites físicos estritos de pistas e largura de banda.

Na era da IA, tentar mover petabytes de dados do SSD para a memória RAM através do PCIe para que a GPU possa processá-los é como tentar esvaziar um oceano com um canudo. A latência inerente a essa cópia de dados destrói a eficiência dos aceleradores matemáticos. A indústria tentou mascarar isso com camadas massivas de cache em memória RAM, mas o volume de dados dos modelos de linguagem tornou essa estratégia financeiramente inviável.

| Característica | Storage corporativo tradicional | Storage para IA agêntica |

|---|---|---|

| Padrão de acesso | Previsível, picos e vales, alta localidade | Caótico, ininterrupto, massivamente paralelo |

| Gargalo principal | Velocidade da mídia (HDD/SSD SATA) | Barramento PCIe e interrupções de CPU |

| Topologia ideal | SAN/NAS centralizado via rede Ethernet/FC | Armazenamento computacional e memória unificada |

| Mídia primária | SSDs SAS/SATA e HDDs de alta capacidade | NVMe de altíssima densidade (EDSFF) e CXL |

Precisamos de uma mudança de paradigma. Não podemos mais trazer os dados até o processamento. Precisamos fundir o armazenamento e a memória em um único tecido contínuo.

CXL e memórias unificadas no futuro próximo

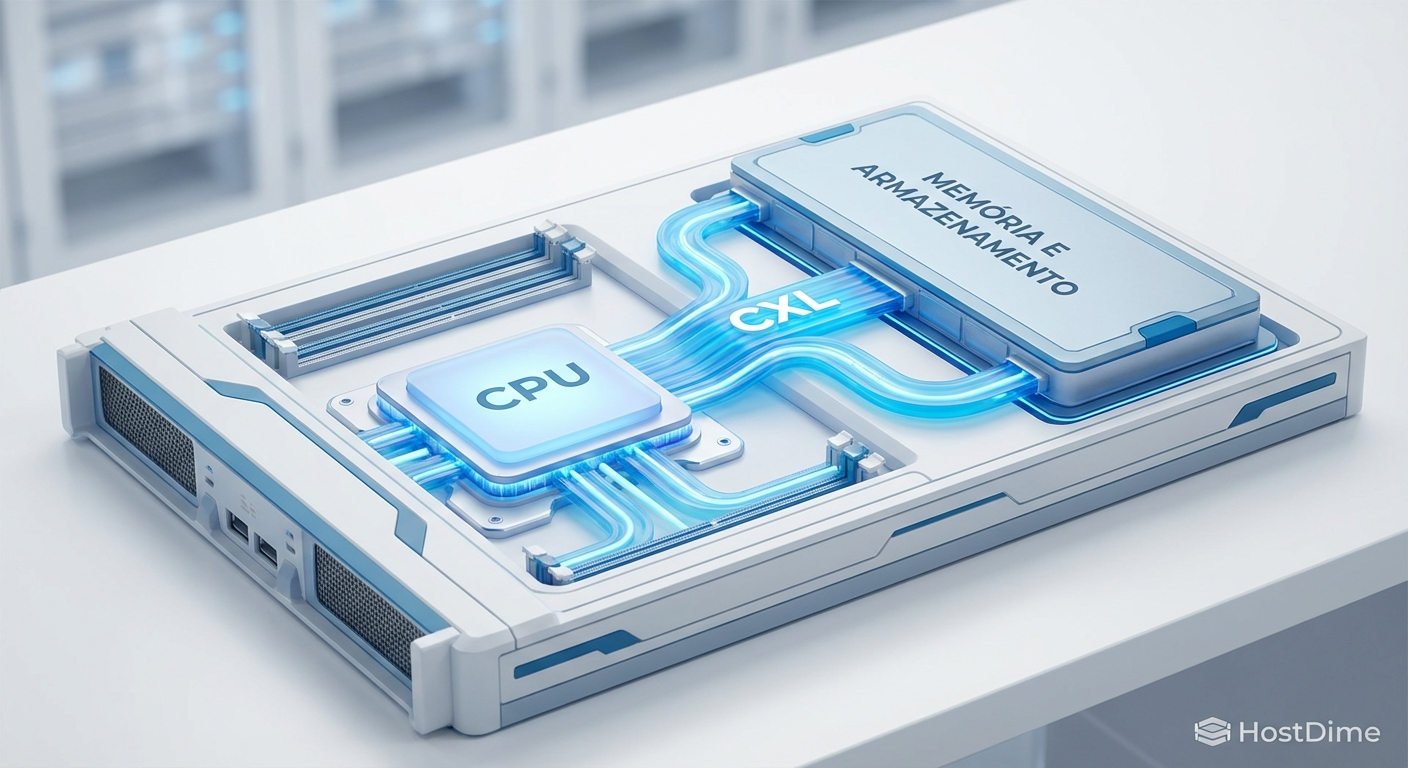

A resposta para o colapso do I/O atende pela sigla CXL (Compute Express Link). Este novo padrão aberto da indústria é, na minha visão, a tecnologia mais transformadora para datacenters desta década. O CXL permite que CPUs, GPUs e dispositivos de armazenamento compartilhem o mesmo espaço de memória com coerência de cache.

Na prática, isso significa que um disco de armazenamento equipado com CXL não é mais visto pelo sistema operacional como um dispositivo de bloco tradicional. Ele se torna uma extensão direta da memória RAM. Quando um agente de IA precisa acessar um vetor de dados, ele não envia um comando de leitura pelo sistema de arquivos. Ele simplesmente acessa um endereço de memória.

Figura: Diagrama conceitual da arquitetura CXL unificando memória RAM e armazenamento NVMe

Figura: Diagrama conceitual da arquitetura CXL unificando memória RAM e armazenamento NVMe

Essa eliminação do overhead de software reduz a latência a níveis quase imperceptíveis. Aliado a novos formatos físicos de alta densidade como o EDSFF (Enterprise and Datacenter Standard Form Factor), especificamente o padrão E1.S, veremos servidores capazes de abrigar petabytes de armazenamento que operam na velocidade da memória principal. O storage deixa de ser um silo isolado e passa a ser um órgão vital e integrado do cérebro computacional.

Armazenamento computacional e o horizonte quântico

Olhando para um horizonte de cinco a dez anos, a inteligência da infraestrutura migrará para a borda do silício. O armazenamento computacional (Computational Storage) colocará núcleos de processamento ARM diretamente dentro das controladoras dos SSDs. Em vez de mover terabytes de dados brutos para a CPU pesquisar um padrão, a CPU enviará o algoritmo de busca para o disco. O disco fará a varredura internamente e devolverá apenas o resultado de poucos kilobytes.

Mais adiante, a biologia e a física quântica reescreverão as regras do arquivamento de longo prazo. O DNA Storage, capaz de armazenar exabytes de dados de treinamento de IA em poucos gramas de material sintético, resolverá o problema do consumo de energia dos datacenters frios. Simultaneamente, a computação quântica exigirá novos métodos de criptografia e recuperação de dados em tempo real, forçando uma reescrita completa dos hypervisors de storage que conhecemos hoje.

O imperativo da reestruturação

A tempestade de dados gerada pelos enxames autônomos não é uma previsão distante. Ela já está saturando os backbones das maiores infraestruturas do planeta. Continuar investindo em arquiteturas de storage baseadas em paradigmas da era humana é um erro estratégico fatal.

A sobrevivência na próxima década exige uma reestruturação radical. Os arquitetos de infraestrutura devem abandonar a visão do storage como um repositório passivo. O armazenamento do futuro próximo é ativo, computacional e intrinsecamente ligado à memória principal. Aqueles que não adaptarem seus datacenters para a escala agêntica verão seus sistemas colapsarem sob o peso da própria inteligência que tentam sustentar.

O que é I/O em escala agêntica?

É o padrão de leitura e gravação gerado por múltiplos agentes de Inteligência Artificial operando simultaneamente. Caracteriza-se por requisições massivas, altamente paralelas, aleatórias e ininterruptas, diferentemente do tráfego gerado por humanos, que possui pausas naturais de processamento cognitivo.Por que arrays all-flash NVMe comuns não resolvem o gargalo da IA?

Embora os discos NVMe sejam extremamente rápidos, as arquiteturas tradicionais ainda dependem da CPU do host para gerenciar as interrupções e filas de I/O. Em escala agêntica, a sobrecarga de processamento faz com que a CPU e o barramento PCIe se tornem o gargalo antes mesmo da mídia flash atingir seu limite.Como o protocolo CXL muda o futuro do storage corporativo?

O Compute Express Link (CXL) permite o compartilhamento de memória entre CPUs, aceleradores e dispositivos de armazenamento com latência quase nula. Ele transforma o storage em uma extensão direta da memória RAM, eliminando as antigas barreiras de transferência de blocos e viabilizando o processamento em tempo real exigido pela IA.

Julian Vance

Futurista de Tecnologia

"Exploro as fronteiras da infraestrutura, do armazenamento em DNA à computação quântica. Ajudo líderes a decodificar o horizonte tecnológico e construir o datacenter de 2035 hoje."