NVMe FDP: O sucessor do ZNS para mitigar a amplificação de escrita em SSDs

Descubra como o NVMe Flexible Data Placement (FDP) resolve o problema de Write Amplification em SSDs enterprise sem quebrar a semântica de bloco tradicional.

A durabilidade infinita do armazenamento flash é uma ilusão arquitetônica. Em ambientes de data center e infraestruturas de nuvem multitenant, a forma como o software escreve os dados dita diretamente a vida útil do hardware. Quando lidamos com petabytes de informações sendo gravadas e apagadas constantemente, a física da memória NAND cobra seu preço.

O problema central reside na arquitetura tradicional dos SSDs (Solid State Drives). Para o sistema operacional, o disco é apenas um array linear de blocos lógicos. No entanto, internamente, o SSD precisa realizar um malabarismo complexo para mapear esses blocos lógicos em páginas e blocos físicos de memória flash. Esse desalinhamento entre a intenção do software e a realidade do hardware gera ineficiências massivas.

Resumo em 30 segundos

- A amplificação de escrita (WAF) destrói a vida útil dos SSDs e gera picos imprevisíveis de latência devido à coleta de lixo em background.

- O ZNS (Zoned Namespaces) tentou resolver isso, mas falhou na adoção em massa por exigir a reescrita completa da pilha de software do host.

- O NVMe FDP (Flexible Data Placement) surge como o meio-termo ideal, permitindo que o host dê dicas de alocação ao SSD sem quebrar a compatibilidade com sistemas de arquivos tradicionais.

O custo oculto da coleta de lixo e a degradação prematura

Para entender a raiz do problema, precisamos olhar para a mecânica da memória flash NAND. Diferente dos discos magnéticos (HDDs), um SSD não pode simplesmente sobrescrever um dado existente. A gravação ocorre em nível de página (geralmente 4KB a 16KB), mas o apagamento só pode ser feito em nível de bloco (que contém centenas de páginas).

Quando um dado é modificado pelo sistema operacional, o SSD marca a página antiga como inválida e escreve o novo dado em uma página limpa. Com o tempo, os blocos ficam fragmentados, cheios de páginas válidas e inválidas misturadas. É aqui que entra o processo de Garbage Collection (Coleta de Lixo).

O controlador do SSD precisa ler as páginas válidas de um bloco fragmentado, reescrevê-las em um novo bloco limpo e, finalmente, apagar o bloco original. Esse movimento extra de dados em background é conhecido como Write Amplification Factor (WAF).

Figura: Diagrama ilustrando o processo de Garbage Collection e a origem da amplificação de escrita em SSDs.

Figura: Diagrama ilustrando o processo de Garbage Collection e a origem da amplificação de escrita em SSDs.

⚠️ Perigo: Em bancos de dados altamente transacionais, um WAF elevado não apenas consome os ciclos de gravação (Endurance) do SSD prematuramente. Ele também satura a largura de banda interna do controlador, causando o temido "incidente da latência de cauda", onde requisições que normalmente levam microssegundos passam a demorar milissegundos.

Em um ambiente enterprise, a amplificação de escrita destrói o TCO (Total Cost of Ownership). Se você compra um SSD NVMe projetado para suportar 1 DWPD (Drive Write Per Day) por cinco anos, mas sua aplicação gera um WAF de 3.0, a vida útil real do disco cai drasticamente. Você precisará substituir o hardware muito antes do previsto no orçamento.

A promessa do ZNS e o pesadelo de reescrever a pilha de armazenamento

A indústria de armazenamento reconheceu esse gargalo arquitetônico e introduziu o ZNS (Zoned Namespaces). A premissa do ZNS era radical e teoricamente brilhante. Em vez de esconder a complexidade da memória flash atrás de uma FTL (Flash Translation Layer) opaca, o ZNS expôs a natureza sequencial da mídia diretamente para o host.

No modelo ZNS, o SSD é dividido em zonas. O sistema operacional ou a aplicação é obrigado a escrever os dados sequencialmente dentro de cada zona. Quando uma zona fica cheia, ela deve ser explicitamente resetada (apagada) pelo host antes de ser reutilizada.

Isso elimina quase completamente a necessidade de Garbage Collection no nível do SSD. O WAF cai para próximo de 1.0, e a latência se torna incrivelmente previsível. O problema foi resolvido, certo? Depende.

💡 Dica Pro: A adoção de novas tecnologias de storage raramente falha por limitações de hardware, mas sim pelo custo de engenharia de software necessário para suportá-las.

O ZNS exige que o host assuma a responsabilidade pelo gerenciamento de dados. Sistemas de arquivos tradicionais (como Ext4 ou XFS) e bancos de dados relacionais não foram projetados para escrever estritamente de forma sequencial em zonas rígidas. Para usar ZNS, as empresas precisavam reescrever suas aplicações, adotar novos sistemas de arquivos (como F2FS) ou modificar profundamente motores de armazenamento como o RocksDB. O custo de engenharia inviabilizou a adoção em larga escala fora dos hyperscalers.

Flexible Data Placement como a ponte entre performance e compatibilidade

Diante da baixa adoção do ZNS no mercado corporativo geral, o consórcio NVMe introduziu uma nova especificação no NVMe 2.0 (TP4146) chamada Flexible Data Placement (FDP). O FDP é a resposta pragmática para o problema da amplificação de escrita.

A genialidade do FDP está em seu design de compromisso. Ele mantém a semântica tradicional de blocos lógicos. O sistema operacional ainda enxerga o SSD como um disco normal, e a FTL continua existindo dentro do controlador do SSD para gerenciar o mapeamento físico. Nenhuma reescrita massiva de software é obrigatória.

No entanto, o FDP permite que o host envie "dicas" ao SSD. Quando a aplicação escreve um dado, ela pode anexar um Placement Identifier (PID). Esse identificador diz ao SSD: "Estes dados pertencem ao mesmo contexto e provavelmente serão apagados ou modificados juntos".

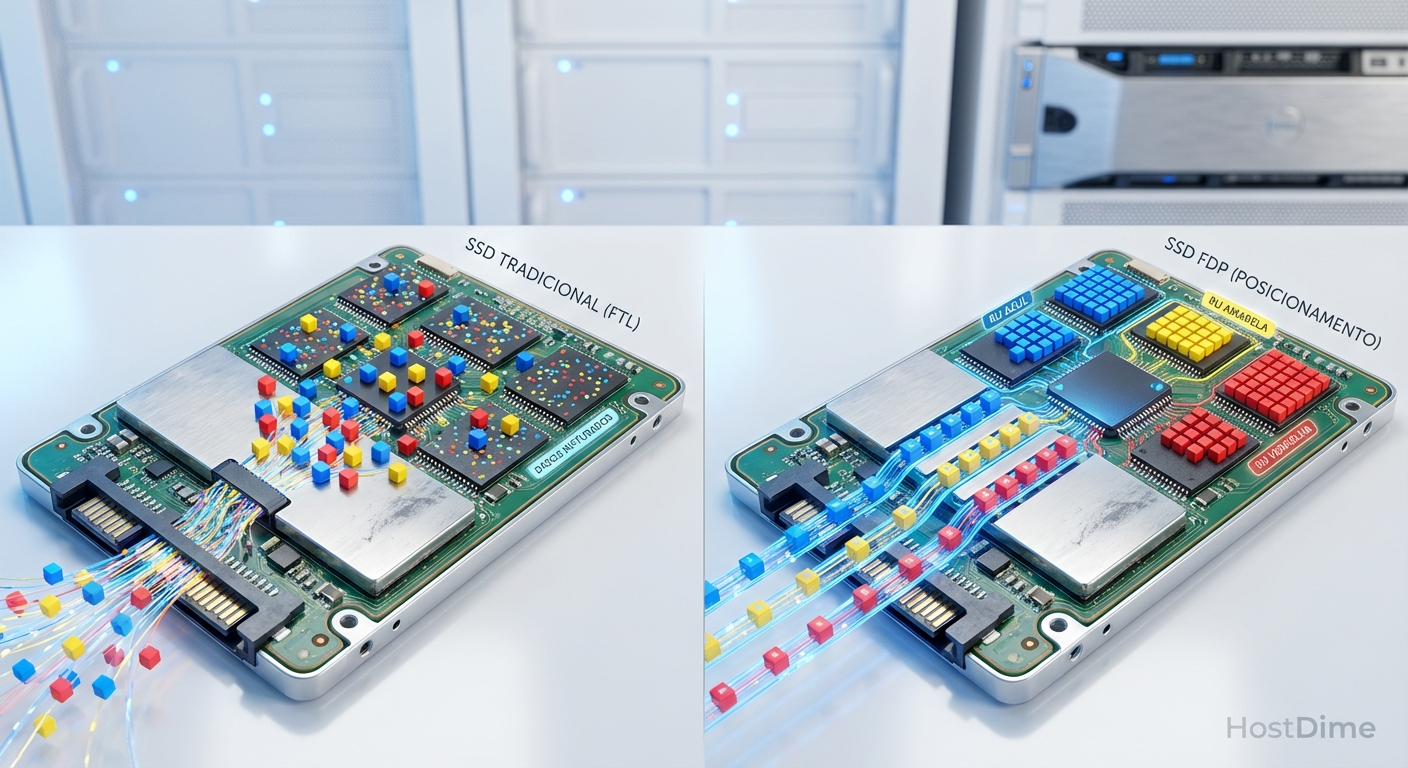

Figura: Comparativo arquitetônico entre a alocação tradicional e o agrupamento inteligente via Placement Identifiers do FDP.

Figura: Comparativo arquitetônico entre a alocação tradicional e o agrupamento inteligente via Placement Identifiers do FDP.

O controlador do SSD usa esses PIDs para agrupar dados semelhantes em Reclaim Units (RU) físicas. Se um banco de dados escreve logs de transação (que têm vida curta) com o PID 1, e dados de tabelas frias (vida longa) com o PID 2, o SSD os colocará em blocos físicos separados.

Quando os logs de transação expirarem, o SSD poderá apagar o bloco inteiro de uma só vez, sem precisar mover os dados frios que estariam misturados no modelo tradicional. O Garbage Collection é drasticamente reduzido, mitigando o WAF sem quebrar a compatibilidade com o ecossistema de software existente.

Comparativo de arquiteturas de alocação

Para visualizar os trade-offs entre as abordagens, precisamos analisar o impacto em diferentes camadas da infraestrutura.

| Característica | SSD Tradicional (Block) | ZNS (Zoned Namespaces) | FDP (Flexible Data Placement) |

|---|---|---|---|

| Complexidade no Host | Nenhuma (Plug & Play) | Altíssima (Reescrita de software) | Baixa a Média (Ajustes via APIs) |

| Redução de WAF | Nenhuma (WAF alto) | Máxima (WAF próximo a 1.0) | Alta (WAF significativamente reduzido) |

| Gerenciamento da FTL | 100% no SSD | Transferido para o Host | Compartilhado (Host dá dicas, SSD executa) |

| Previsibilidade de Latência | Baixa (Picos de GC) | Excelente | Muito Boa |

| Over-provisioning Necessário | Alto (10% a 28%) | Mínimo (0% a 5%) | Baixo |

Medindo o impacto do FDP na longevidade do flash e na latência de cauda

A implementação do FDP traz benefícios mensuráveis imediatos para a arquitetura de data centers. O primeiro impacto direto é a redução do Over-provisioning. Em SSDs enterprise tradicionais, os fabricantes reservam até 28% da capacidade bruta do disco apenas para dar espaço de manobra para o Garbage Collection. Com o FDP organizando os dados de forma inteligente, essa necessidade cai drasticamente, liberando mais terabytes utilizáveis para o cliente final.

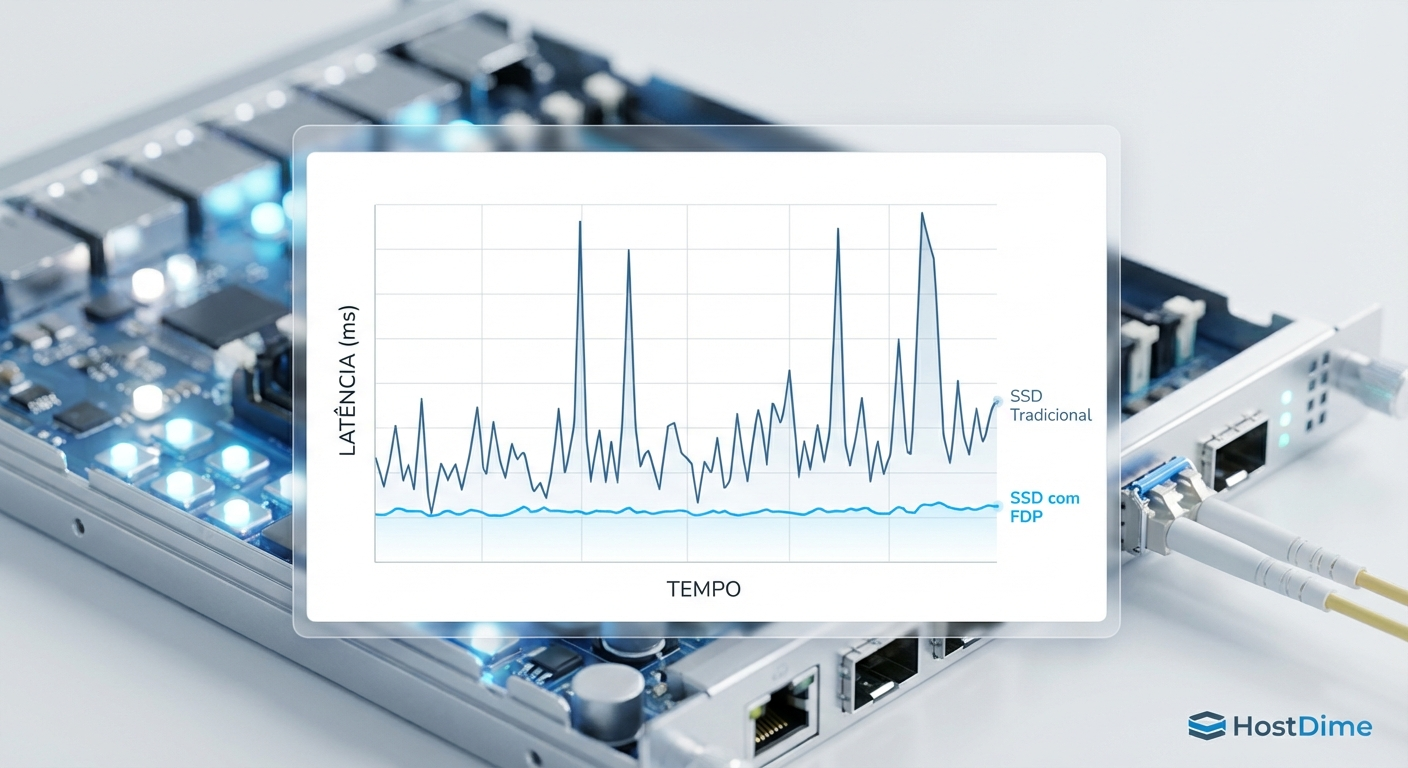

O segundo impacto é a estabilização da latência de cauda (Tail Latency). Em arquiteturas de microsserviços, a latência do sistema inteiro é frequentemente ditada pelo componente mais lento. Se uma requisição de leitura cai em um SSD que está no meio de um ciclo agressivo de Garbage Collection, a resposta pode demorar dezenas de milissegundos.

Figura: Gráfico de latência de cauda demonstrando a estabilidade do FDP sob cargas de trabalho intensas em comparação com SSDs tradicionais.

Figura: Gráfico de latência de cauda demonstrando a estabilidade do FDP sob cargas de trabalho intensas em comparação com SSDs tradicionais.

Ao segregar os dados por tempo de vida útil (Data Placement), o FDP garante que os blocos físicos sejam invalidados de forma homogênea. Isso significa que o controlador do SSD passa muito menos tempo movendo dados válidos de um lado para o outro, mantendo os canais de leitura livres para atender às requisições do host com latência submilisegundo consistente.

Do ponto de vista de TCO, a matemática é implacável. Reduzir o WAF de 2.5 para 1.2 pode efetivamente dobrar a vida útil de um cluster de armazenamento all-flash. Em implantações de larga escala utilizando novos formatos como E1.S (Enterprise and Datacenter Standard Form Factor, otimizado para densidade e refrigeração), essa extensão de vida útil representa milhões de dólares economizados em ciclos de atualização de hardware.

O veredito arquitetônico para o futuro do armazenamento

A transição para o NVMe FDP não é uma questão de "se", mas de "quando". A indústria aprendeu uma lição valiosa com o ZNS: a eficiência do hardware não pode vir às custas da sanidade da engenharia de software. O FDP respeita o legado dos sistemas operacionais enquanto oferece as ferramentas necessárias para otimizar a mídia flash.

Se você está desenhando a próxima geração da sua infraestrutura de armazenamento, a recomendação é clara. Avalie o suporte a FDP nos próximos ciclos de aquisição de SSDs NVMe. Embora a adoção no lado do software (como patches no kernel Linux e otimizações em bancos de dados como o PostgreSQL e RocksDB) ainda esteja em fase de maturação, ter o hardware preparado garantirá que sua infraestrutura possa ativar esses benefícios via atualizações de firmware e sistema operacional nos próximos anos.

A era de tratar SSDs como caixas pretas mágicas de armazenamento infinito acabou. A colaboração inteligente entre o host e o dispositivo é o único caminho sustentável para escalar a performance e controlar os custos no data center moderno.

Referências & Leitura Complementar

NVM Express Base Specification 2.0 (Inclui a definição técnica do TP4146 - Flexible Data Placement).

SNIA (Storage Networking Industry Association): Apresentações sobre FDP Architecture and Use Cases.

JEDEC Solid State Technology Association: Diretrizes sobre medição de Endurance e Write Amplification em SSDs Enterprise.

O que é NVMe FDP e como ele difere do ZNS?

O FDP (Flexible Data Placement) é um recurso que permite ao sistema operacional enviar dicas ao SSD sobre como agrupar dados com ciclos de vida semelhantes, reduzindo drasticamente a amplificação de escrita. A grande diferença para o ZNS (Zoned Namespaces) é que o FDP mantém a semântica de bloco tradicional. Ou seja, você não precisa reescrever completamente o software do host ou trocar seu sistema de arquivos para utilizá-lo, tornando a adoção muito mais simples.Por que a amplificação de escrita (WAF) é um problema crítico em SSDs?

A física da memória flash NAND dita que não podemos sobrescrever dados diretamente; o controlador precisa apagar blocos físicos inteiros antes de gravar novos dados. Quando os dados ficam fragmentados, o SSD precisa mover informações válidas de um lado para o outro para liberar espaço (processo de Garbage Collection). Essa movimentação extra consome os ciclos de gravação (Endurance) do disco, reduzindo sua vida útil e causando picos severos e imprevisíveis na latência de resposta.Preciso trocar minha infraestrutura para utilizar o NVMe FDP?

Depende do seu ciclo de atualização. O FDP é uma especificação introduzida a partir do NVMe 2.0 (TP4146). Para tirar proveito, você precisará de SSDs de nova geração que tragam suporte nativo ao recurso em seu firmware. Além do hardware, é necessário um kernel Linux recente e aplicações (como bancos de dados ou hypervisors) que tenham sido otimizadas para enviar os identificadores de alocação (Placement Identifiers) através da pilha de armazenamento.

Otávio Henriques

Arquiteto de Soluções Enterprise

"Com duas décadas desenhando infraestruturas críticas, olho além do hype. Foco em TCO, resiliência e trade-offs, pois na arquitetura corporativa a resposta correta quase sempre é 'depende'."