O custo do microburst: Como picos de latência no storage resultam em quebras de SLA e multas

Descubra como microbursts em redes de storage causam latência de cauda, violam contratos de SLA rigorosos e geram penalidades financeiras para provedores de TI.

No universo corporativo de TI, a ilusão da média é o caminho mais rápido para a quebra de contratos. Quando analisamos relatórios de desempenho de infraestrutura de armazenamento, um tempo de resposta médio de 2 milissegundos parece um cenário ideal de conformidade. No entanto, a gestão de nível de serviço não opera na média. Operamos nos extremos. Um pico repentino de tráfego que eleva a latência para 200 milissegundos por uma fração de segundo é o suficiente para causar falhas em transações de banco de dados, corromper a experiência do usuário e acionar cláusulas punitivas rigorosas.

Resumo em 30 segundos

- Microbursts são picos de I/O em escala de microssegundos que esgotam buffers de rede e storage, causando descarte de pacotes.

- Ferramentas tradicionais de monitoramento mascaram esses eventos em médias de longo prazo, deixando a TI cega para a causa raiz das quebras de SLA.

- A mitigação exige switches com deep buffers, telemetria de alta granularidade e políticas estritas de Qualidade de Serviço (QoS) nas controladoras.

O impacto financeiro dos milissegundos invisíveis nos contratos de nível de serviço

Para um Gerente de Nível de Serviço, 99,9% de disponibilidade não é 99,999%. Essa diferença decimal representa horas de inatividade permitida e, consequentemente, milhares de reais em multas contratuais. O mesmo rigor se aplica aos Service Level Objectives (SLOs) de desempenho de storage. O fenômeno conhecido como microburst é o inimigo invisível dessas métricas.

Um microburst ocorre quando uma quantidade massiva de requisições de entrada e saída (I/O) atinge a infraestrutura de storage em um intervalo de tempo minúsculo. Estamos falando de microssegundos. Durante esse evento, a taxa de transferência exigida supera drasticamente a capacidade instantânea das portas de rede ou das controladoras de armazenamento.

⚠️ Perigo: Se o seu contrato estipula penalidades para latências superiores a 20 milissegundos no percentil 99, um único microburst não detectado pode invalidar o faturamento de um mês inteiro de um cliente corporativo.

O grande problema reside na visibilidade. A maioria das plataformas de monitoramento coleta dados via SNMP em intervalos de um a cinco minutos. Um evento destrutivo que dura 10 milissegundos simplesmente desaparece no gráfico de médias. O cliente relata a lentidão, a aplicação registra o timeout, mas o painel da infraestrutura exibe um falso status verde.

Como a saturação de buffers em redes de storage gera multas contratuais

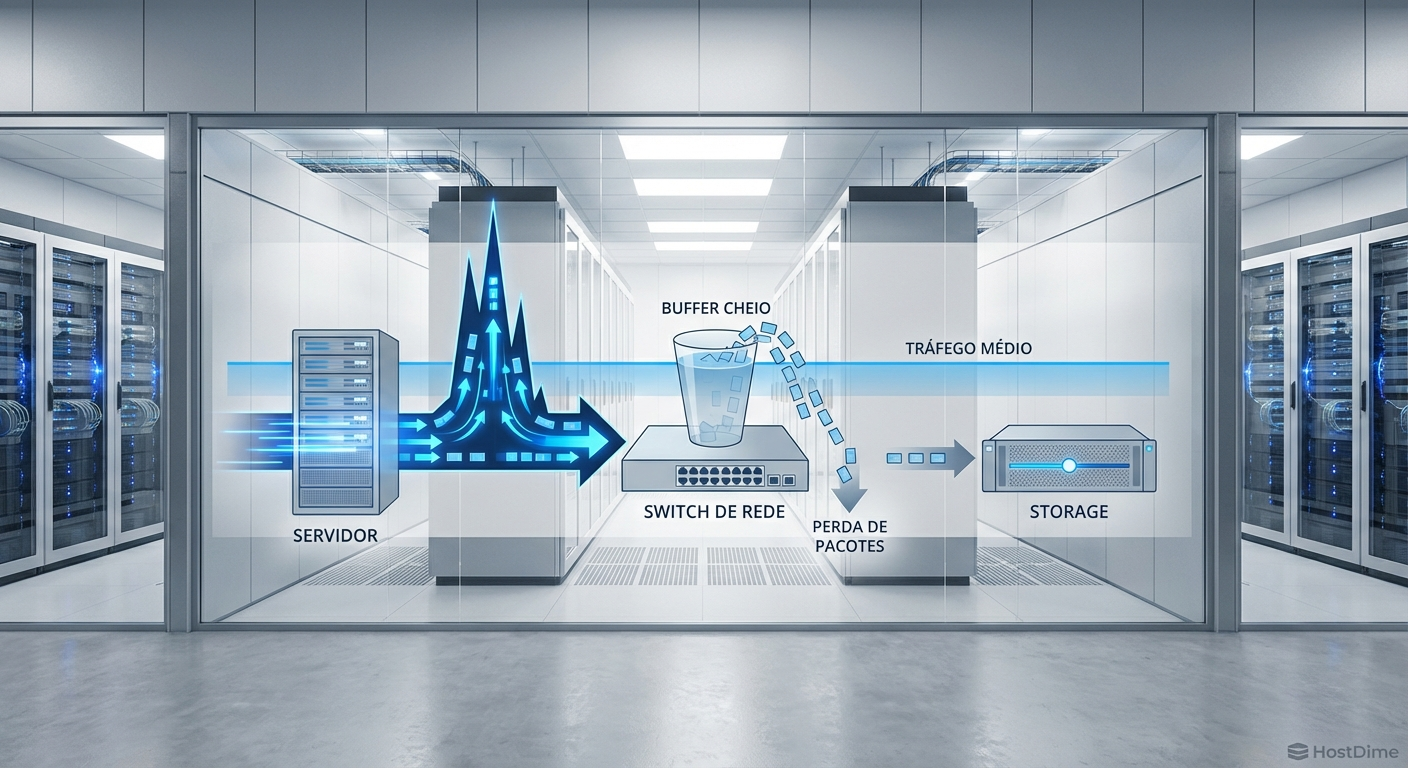

A arquitetura de comunicação entre servidores e arrays de storage, seja via iSCSI ou protocolos modernos como NVMe-oF (NVMe over Fabrics), depende de buffers. Buffers são pequenas reservas de memória nos switches e nas placas de rede (NICs) projetadas para absorver variações temporárias de tráfego.

Quando um microburst atinge a rede de storage, esses buffers enchem quase instantaneamente. Se o pico durar mais do que a capacidade de retenção do buffer, o equipamento de rede é forçado a descartar pacotes de dados. No mundo do armazenamento em bloco, o descarte de pacotes é um evento catastrófico para o desempenho.

Figura: Representação visual de um microburst saturando o buffer de um switch de rede, resultando em descarte de pacotes de storage.

Figura: Representação visual de um microburst saturando o buffer de um switch de rede, resultando em descarte de pacotes de storage.

O protocolo TCP, amplamente utilizado em redes iSCSI, reage ao descarte de pacotes reduzindo drasticamente a janela de transmissão e iniciando retransmissões. Esse processo de recuperação adiciona uma latência massiva à operação de I/O original. O que deveria ser uma leitura de 1 milissegundo em um disco SSD NVMe transforma-se em uma espera de 50 a 100 milissegundos.

Para protocolos baseados em RDMA (Remote Direct Memory Access), como o RoCE (RDMA over Converged Ethernet) usado no NVMe-oF, a situação exige redes sem perdas (lossless). Um microburst que causa descarte de pacotes em uma rede RoCE mal configurada pode paralisar temporariamente o tráfego de storage, acionando alertas críticos de indisponibilidade nas aplicações de missão crítica.

A matemática da latência de cauda e o risco financeiro

Na gestão de serviços de TI (ITSM), avaliamos o risco financeiro através da latência de cauda. A latência de cauda refere-se aos tempos de resposta mais lentos experimentados por uma pequena porcentagem das requisições, geralmente medidas no percentil 99 (p99) ou 99,9 (p99.9).

Se um array de storage processa 100.000 operações de I/O por segundo (IOPS), um p99 de 50 milissegundos significa que 1.000 operações a cada segundo estão sofrendo atrasos severos. Para um banco de dados transacional de um cliente do setor financeiro, essas 1.000 operações lentas representam transações de cartão de crédito negadas ou falhas em sistemas de trading.

Para justificar investimentos em infraestrutura, o Gerente de Nível de Serviço deve cruzar os dados de penalidades contratuais com as limitações tecnológicas atuais. A tabela abaixo ilustra a diferença de postura entre uma operação reativa e uma operação focada em garantias de SLA.

| Característica | Monitoramento tradicional (SNMP) | Telemetria de alta granularidade |

|---|---|---|

| Intervalo de coleta | 1 a 5 minutos | Microssegundos a segundos |

| Visibilidade de microburst | Nula (mascarada pela média) | Alta (captura picos exatos) |

| Risco de quebra de SLA | Crítico (cegueira operacional) | Controlado (dados precisos) |

| Resolução de disputas | Fraca (falta de evidências) | Forte (logs detalhados de I/O) |

| Custo de implementação | Baixo (ferramentas padrão) | Alto (requer hardware/software específico) |

Estratégias de mitigação de risco e políticas de qualidade de serviço

A conformidade com SLAs rigorosos exige uma arquitetura de storage defensiva. A primeira linha de defesa é a adoção de switches de rede classificados para data centers com arquitetura de "deep buffers". Esses equipamentos possuem memória significativamente maior por porta, permitindo absorver microbursts mais longos sem descartar os pacotes de I/O.

💡 Dica Pro: Ao desenhar a rede para clusters de storage all-flash, exija dos fornecedores métricas de capacidade de buffer por porta, e não apenas a largura de banda total do backplane do switch.

A segunda estratégia vital é a implementação rigorosa de Qualidade de Serviço (QoS) diretamente nas controladoras de storage. O QoS permite que a equipe de infraestrutura defina limites máximos de IOPS e largura de banda para volumes menos críticos. Isso impede que uma rotina de backup mal agendada ou uma máquina virtual ruidosa (noisy neighbor) gere um microburst que afete os volumes de missão crítica.

Além disso, a transição para tecnologias de armazenamento fim a fim baseadas em NVMe exige a implementação de mecanismos de controle de fluxo na rede, como o Priority-based Flow Control (PFC) e o Explicit Congestion Notification (ECN). Esses protocolos pausam temporariamente o tráfego na origem antes que os buffers do switch transbordem, trocando o descarte de pacotes por um aumento controlado e previsível da latência.

A previsibilidade de I/O como diferencial na retenção de clientes

No mercado corporativo, o desempenho máximo absoluto raramente é o fator decisivo para a renovação de um contrato. Clientes enterprise valorizam a previsibilidade. Um sistema de storage que entrega 5 milissegundos de latência de forma constante e inabalável é infinitamente superior a um sistema que entrega 1 milissegundo na maior parte do tempo, mas sofre picos de 100 milissegundos durante microbursts.

A previsibilidade facilita o planejamento de capacidade e garante que as aplicações dos clientes operem dentro de parâmetros conhecidos. Quando a infraestrutura de storage é projetada para mitigar microbursts, o provedor de serviços ganha a confiança necessária para assinar SLAs mais agressivos, transformando a confiabilidade técnica em uma vantagem comercial direta.

A telemetria avançada desempenha um papel fundamental aqui. Ferramentas que analisam o tráfego de storage em tempo real permitem que a equipe de operações identifique padrões de microbursts antes que eles afetem os SLOs. Essa postura proativa muda a dinâmica do gerenciamento de serviços, passando da justificação de falhas para a demonstração contínua de valor.

O veredito sobre a gestão de capacidade e risco

Ignorar a existência de microbursts na infraestrutura de storage é assumir um risco financeiro desnecessário. A latência de cauda não é um mero detalhe técnico para engenheiros debaterem. Ela é o gatilho direto para o acionamento de cláusulas de penalidade, perda de credibilidade e, em última instância, o cancelamento de contratos lucrativos.

A recomendação para diretorias de TI e gestores de infraestrutura é clara. É imperativo auditar as capacidades de buffer da rede de armazenamento atual e revisar as ferramentas de monitoramento. Se a sua telemetria não consegue enxergar eventos na escala de milissegundos, você está operando às cegas. O investimento em switches adequados, políticas de QoS e observabilidade granular deve ser encarado não como um custo de TI, mas como um prêmio de seguro essencial para a proteção da receita da empresa.

O que é um microburst no contexto de infraestrutura de storage?

É um pico repentino e extremamente rápido de tráfego de dados (I/O) que dura apenas frações de segundo. Apesar de breve, é intenso o suficiente para esgotar os buffers dos switches e controladoras de storage, causando descarte de pacotes e picos severos de latência que afetam o desempenho das aplicações.Por que o monitoramento tradicional não detecta microbursts que causam quebra de SLA?

Ferramentas de monitoramento padrão geralmente calculam médias de tráfego em intervalos longos, de minutos ou segundos. Como os microbursts ocorrem na escala de milissegundos ou microssegundos, eles ficam ocultos nessas médias. No entanto, seus efeitos destrutivos (latência de cauda) são registrados pelas aplicações dos clientes, gerando incidentes e disputas contratuais.Como justificar o investimento em mitigação de microbursts para a diretoria financeira?

A justificativa deve ser estritamente baseada na gestão de riscos e conformidade. Compara-se o Custo Total de Propriedade (TCO) de tecnologias adequadas, como switches com deep buffers e softwares de telemetria avançada, contra o valor histórico e projetado das multas por quebra de SLA, somado ao custo irrecuperável da perda (churn) de clientes corporativos críticos.

Arthur Sales

Gerente de Nível de Serviço

"Vivo na linha tênue entre a conformidade e a violação contratual. Para mim, 99,9% não é disponibilidade; é prejuízo. Exijo garantias absolutas e aplicação rigorosa de penalidades."