O gargalo de 50 anos: por que o POSIX está matando suas GPUs e como o object storage resolve isso

Descubra por que sistemas de arquivos POSIX causam inanição de GPUs no treinamento de IA e como arquiteturas de object storage de alta performance eliminam esse gargalo sem explodir seus custos de egress.

Você acaba de aprovar um orçamento de sete dígitos para alugar um cluster de GPUs NVIDIA H100 na nuvem. A expectativa é treinar seu novo modelo fundacional em tempo recorde. Porém, ao abrir os painéis de monitoramento, você se depara com um cenário aterrorizante. Suas placas de vídeo de altíssimo custo estão operando com apenas 20% de utilização.

O restante do tempo? Elas estão paradas, esperando os dados chegarem. Esse fenômeno, conhecido como inanição de GPU (GPU starvation), é o ralo por onde o seu orçamento de infraestrutura está escoando. E o culpado não é a rede, nem a memória RAM. O culpado é um padrão de sistema de arquivos criado na década de 1970.

Resumo em 30 segundos

- GPUs ociosas custam fortunas e o culpado geralmente é o gargalo de I/O no armazenamento legado.

- O padrão POSIX afoga o barramento com verificações de metadados e locks desnecessários para cargas de IA.

- Object storage de alta performance com NVMe elimina a hierarquia de arquivos e entrega dados diretamente via API S3.

A fatura astronômica enquanto suas H100 ficam ociosas

Quando falamos de treinamento de inteligência artificial ou deep learning, estamos lidando com a ingestão de milhões (às vezes bilhões) de pequenos arquivos não estruturados. São imagens, trechos de áudio ou blocos de texto que precisam ser carregados na memória da GPU o mais rápido possível.

O problema é que a arquitetura de armazenamento tradicional não foi desenhada para esse padrão de I/O. Se o seu storage não consegue saturar o barramento PCIe para alimentar os tensores, a GPU entra em estado de espera. Na nuvem, você paga por hora de computação alocada, independentemente de a GPU estar processando matrizes ou apenas esperando um disco girar.

Essa ociosidade gera uma fatura astronômica sem entregar o resultado esperado. É o equivalente a alugar um carro de Fórmula 1 e ser forçado a dirigi-lo em uma estrada de terra esburacada. O motor tem potência infinita, mas a infraestrutura não permite acelerar.

A anatomia do atraso: o overhead de metadados do POSIX

Para entender o gargalo, precisamos olhar para o POSIX (Portable Operating System Interface). Esse padrão foi brilhante para a era dos minicomputadores. Ele define como os sistemas operacionais interagem com os arquivos, exigindo uma estrutura hierárquica de diretórios, permissões rigorosas de usuários e bloqueios de arquivos (locks) para evitar gravações simultâneas conflitantes.

O problema é que o POSIX é extremamente "falador". Para ler um único arquivo de imagem de 2KB, o sistema precisa percorrer a árvore de diretórios, verificar permissões em cada nível, checar a data de modificação e garantir que nenhum outro processo está alterando aquele dado.

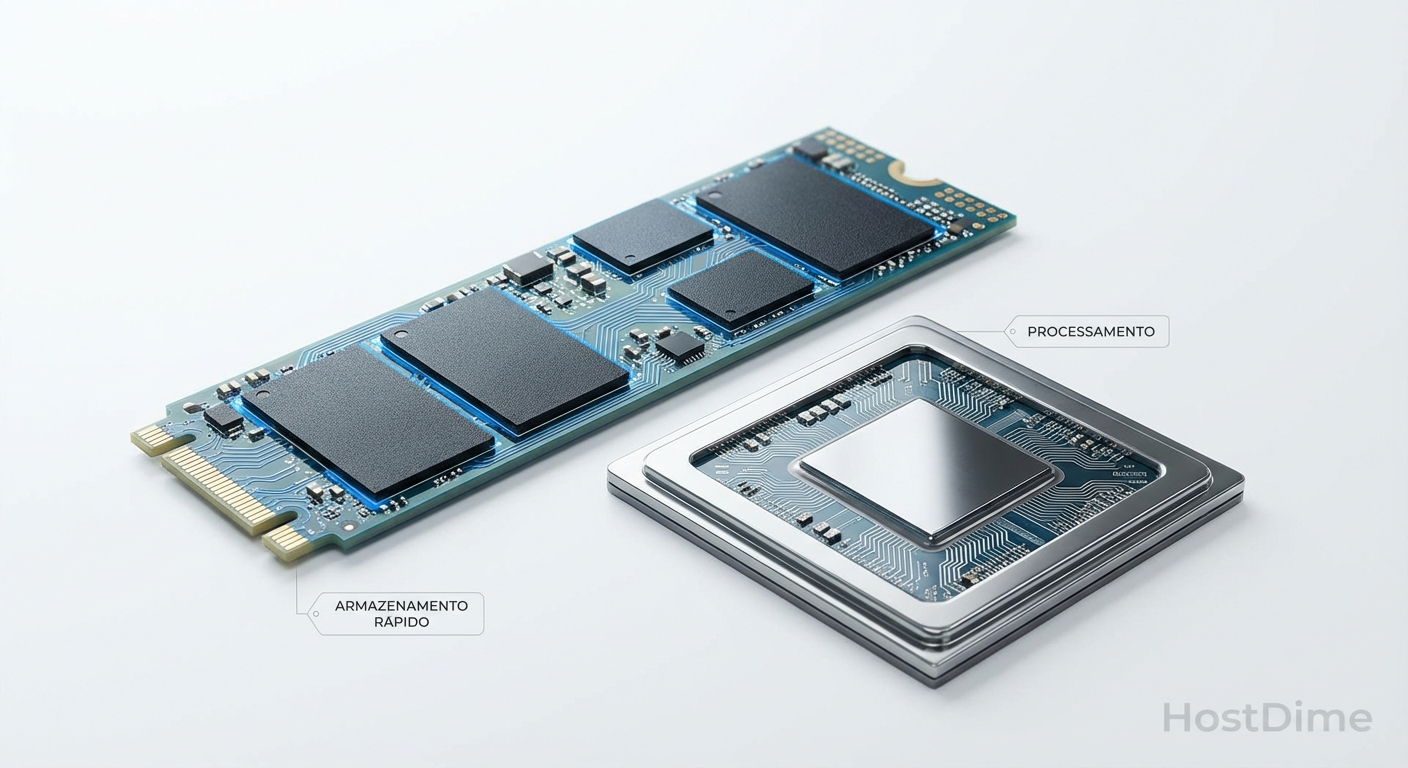

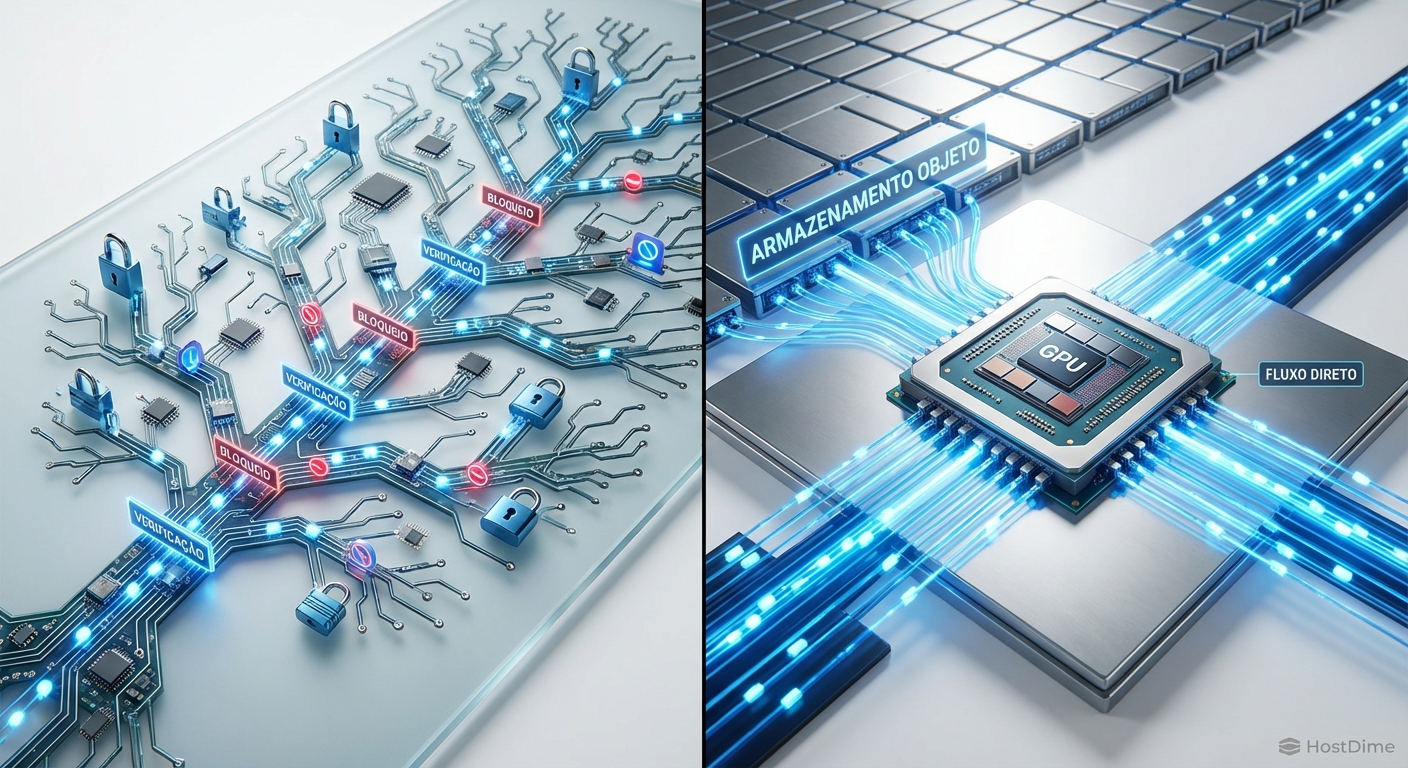

Figura: Comparação visual entre a hierarquia complexa do POSIX e o namespace plano do Object Storage.

Figura: Comparação visual entre a hierarquia complexa do POSIX e o namespace plano do Object Storage.

Quando você multiplica esse overhead de metadados por milhões de arquivos sendo requisitados por segundo, o controlador de armazenamento entra em colapso. O barramento fica saturado não com os dados úteis que a GPU precisa, mas com o tráfego de controle do próprio sistema de arquivos.

⚠️ Perigo: Tentar escalar um file system POSIX para bilhões de arquivos pequenos é a receita perfeita para travar seu cluster de storage e explodir sua fatura de nuvem com IOPS inúteis.

A armadilha do NFS em flash

A reação instintiva de muitos engenheiros de infraestrutura é jogar hardware no problema. Eles substituem os discos rígidos (HDDs) por arrays All-Flash baseados em NVMe (Non-Volatile Memory Express) e os expõem via NFS (Network File System).

Embora o NVMe ofereça latências na casa dos microssegundos e um paralelismo massivo, colocar o protocolo NFS na frente dele anula grande parte dessa vantagem. O NFS ainda precisa respeitar a semântica POSIX. Você acaba criando um funil de software na frente de um hardware incrivelmente rápido.

É por isso que empilhar NVMe em sistemas de arquivos legados não escala linearmente. O gargalo muda da mídia física para a camada de software do kernel do sistema operacional. Para resolver a inanição de GPU, precisamos de uma mudança de paradigma na forma como os dados são endereçados e consumidos.

Comparativo de arquiteturas de armazenamento para IA

| Característica | POSIX / NFS Tradicional | Object Storage (All-NVMe) |

|---|---|---|

| Estrutura de Dados | Hierárquica (Árvores e Diretórios) | Plana (Buckets e Objetos) |

| Overhead de Metadados | Altíssimo (Permissões, Locks, Caminhos) | Mínimo (Chave-Valor direto) |

| Escalabilidade | Limitada pelo controlador e inodes | Virtualmente infinita |

| Acesso Nativo | Montagem no Sistema Operacional (Kernel) | Chamadas de API RESTful (S3) |

| Foco Principal | Compartilhamento humano e aplicações legadas | Aplicações cloud-native e I/O massivo |

Bypass direto para a memória: alimentando tensores com S3 API

A solução definitiva para esse gargalo de 50 anos é abandonar a semântica de arquivos e abraçar o object storage de alta performance. Diferente dos antigos tiers de arquivamento (cold storage), o object storage moderno roda sobre clusters All-NVMe e redes de 400 GbE.

Nessa arquitetura, os dados não vivem em pastas. Eles são objetos imutáveis em um namespace plano, acessados via uma chave única através da API S3. Isso elimina completamente a necessidade de percorrer árvores de diretórios ou gerenciar locks complexos. A aplicação de IA solicita o objeto e o storage o entrega imediatamente.

💡 Dica Pro: Utilize bibliotecas otimizadas de machine learning que leem nativamente de endpoints S3. Isso ignora completamente a camada do sistema de arquivos do sistema operacional local.

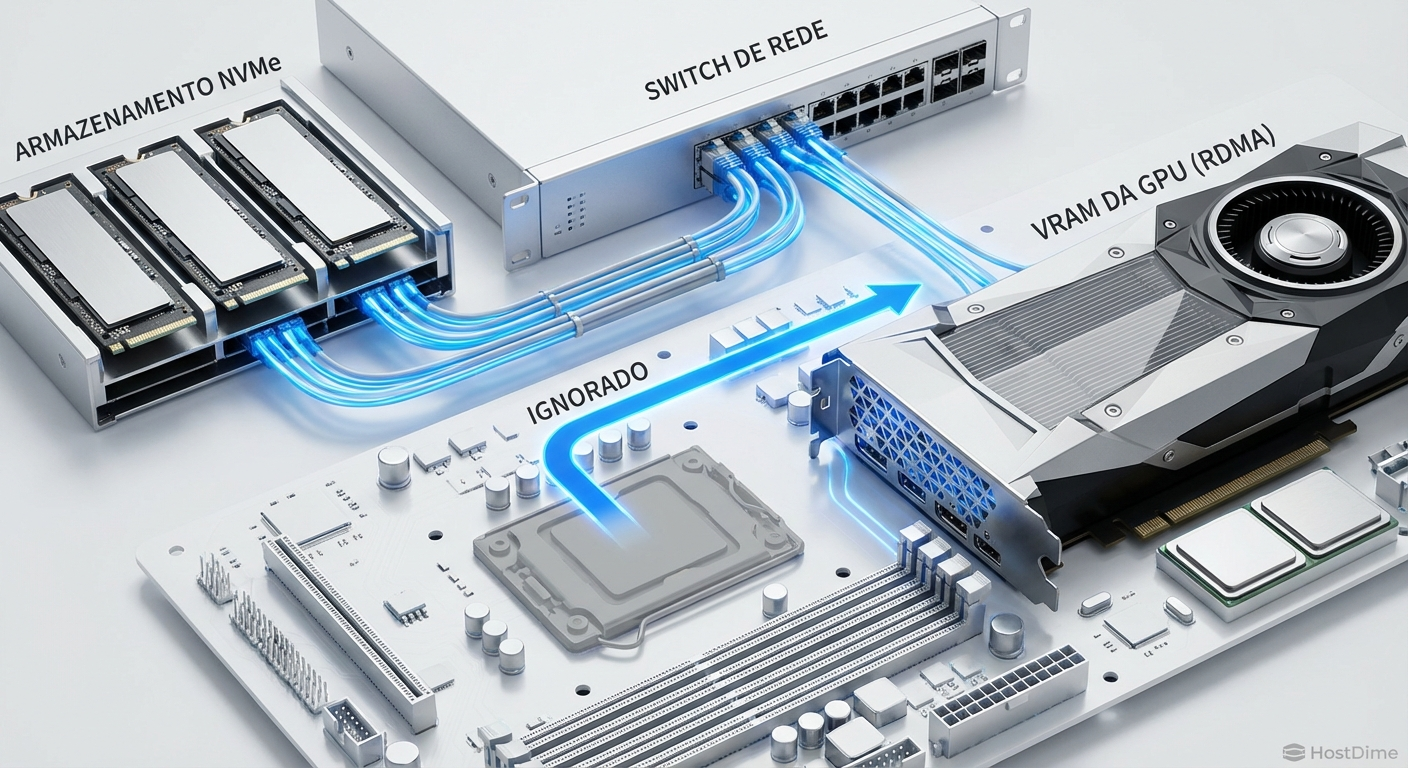

Além disso, tecnologias modernas de armazenamento de objetos integram-se com frameworks como o NVIDIA GPUDirect Storage. Isso permite que os dados viajem do cluster de storage NVMe diretamente para a memória da GPU via rede (RDMA), ignorando completamente a CPU do servidor hospedeiro e o buffer do sistema operacional.

Figura: Fluxo de dados via GPUDirect Storage, ignorando a CPU e entregando dados do NVMe direto para a GPU.

Figura: Fluxo de dados via GPUDirect Storage, ignorando a CPU e entregando dados do NVMe direto para a GPU.

Métricas de sobrevivência e o pesadelo do egress

Adotar object storage nativo para IA não resolve apenas o problema de throughput. Resolve também um dos maiores pesadelos da arquitetura em nuvem moderna: os custos de transferência de dados (egress).

Em arquiteturas legadas, é comum copiar os datasets do object storage (onde é barato armazenar) para um file system POSIX temporário (scratch space) próximo às GPUs para o treinamento. Essa movimentação constante de petabytes de dados gera taxas de egress punitivas e duplica os custos de armazenamento.

Ao utilizar um object storage de alta performance que fala a API S3 nativamente e entrega a velocidade necessária para as GPUs, você elimina a necessidade desse tier intermediário. Os dados são lidos diretamente da fonte da verdade. O resultado é um aumento drástico no throughput de treinamento e uma redução imediata na complexidade e nos custos da sua fatura de nuvem.

O fim da era dos diretórios

A insistência em manter sistemas de arquivos POSIX para cargas de trabalho de inteligência artificial é um apego emocional a uma tecnologia obsoleta. A matemática da nuvem é implacável. Se a sua infraestrutura de storage não consegue acompanhar a velocidade de ingestão das suas GPUs, você está literalmente queimando dinheiro em ciclos de clock ociosos.

A transição para object storage de alta performance não é apenas uma otimização técnica. É uma necessidade financeira para qualquer operação de IA em escala. O futuro do armazenamento de dados não tem pastas, não tem diretórios e definitivamente não tem paciência para gargalos de metadados.

Referências & Leitura Complementar

IEEE Std 1003.1-2017: The Open Group Base Specifications Issue 7 (A documentação oficial do padrão POSIX e suas limitações inerentes).

RFC 1094: NFS Network File System Protocol Specification (Para entender o design original focado em redes locais dos anos 80).

NVIDIA GPUDirect Storage Design Guide: Documentação técnica sobre como contornar o bounce buffer da CPU para I/O direto em memória de vídeo.

Amazon S3 REST API Introduction: A base do protocolo de object storage que se tornou o padrão de fato da indústria para escalabilidade plana.

O que é inanição de GPU (GPU starvation) no contexto de storage?

É o cenário onde placas de vídeo de altíssimo custo ficam ociosas durante o treinamento de IA porque o sistema de armazenamento não consegue entregar os dados (datasets) rápido o suficiente para mantê-las ocupadas, desperdiçando tempo e dinheiro.Por que o padrão POSIX é considerado um gargalo para inteligência artificial?

O POSIX exige verificações rigorosas de permissões, bloqueios de arquivos (locks) e hierarquias de diretórios complexas. Esse overhead de metadados destrói a performance quando milhões de pequenos arquivos não estruturados são lidos simultaneamente pelas GPUs.Object storage não é muito lento para treinamento de IA?

O object storage tradicional focado em arquivamento (cold tier) sim. Porém, as novas arquiteturas de object storage de alta performance, rodando sobre clusters all-NVMe e redes de 400 GbE, entregam latência de microssegundos e throughput massivo, superando sistemas de arquivos tradicionais.

Rafael Barros

Arquiteto de Cloud Storage

"Desenho arquiteturas de object storage escaláveis e guiadas por API. Meu foco é performance máxima sem deixar o orçamento sangrar com taxas de egress ocultas."