O paradoxo da densidade: garantindo SLAs na era dos SSDs de 60TB

A consolidação em SSDs de ultra capacidade cria um gargalo silencioso de IOPS por Terabyte. Saiba como ajustar contratos e arquitetura para evitar multas por violação de SLA.

A consolidação de infraestrutura é o sonho de qualquer CFO e o pesadelo potencial de qualquer Gerente de Nível de Serviço (SLM). Quando os fabricantes de armazenamento anunciam SSDs de 30TB, 60TB ou os iminentes 120TB, a narrativa é sempre sobre redução de TCO, energia e espaço em rack. No entanto, para quem responde legalmente pela disponibilidade e performance, a matemática é diferente. A densidade extrema cria um gargalo físico e lógico que pode transformar um SLA de "Gold Tier" em uma sucessão de multas contratuais.

Resumo em 30 segundos

- Diluição de IOPS: A capacidade do drive aumentou 10x, mas a largura de banda da interface (PCIe) e a capacidade de processamento do controlador não acompanharam na mesma proporção.

- Risco de Rebuild: A falha de um único drive de 60TB cria um "raio de explosão" massivo, exigindo tempos de reconstrução que mantêm o array em estado degradado por períodos perigosos.

- Adequação de SLA: Contratos de serviço baseados em latência estrita (<1ms) são juridicamente arriscados em arquiteturas de ultra densidade sem mecanismos de QoS (Quality of Service) agressivos.

A pressão inflacionária sobre o footprint e a realidade do hardware

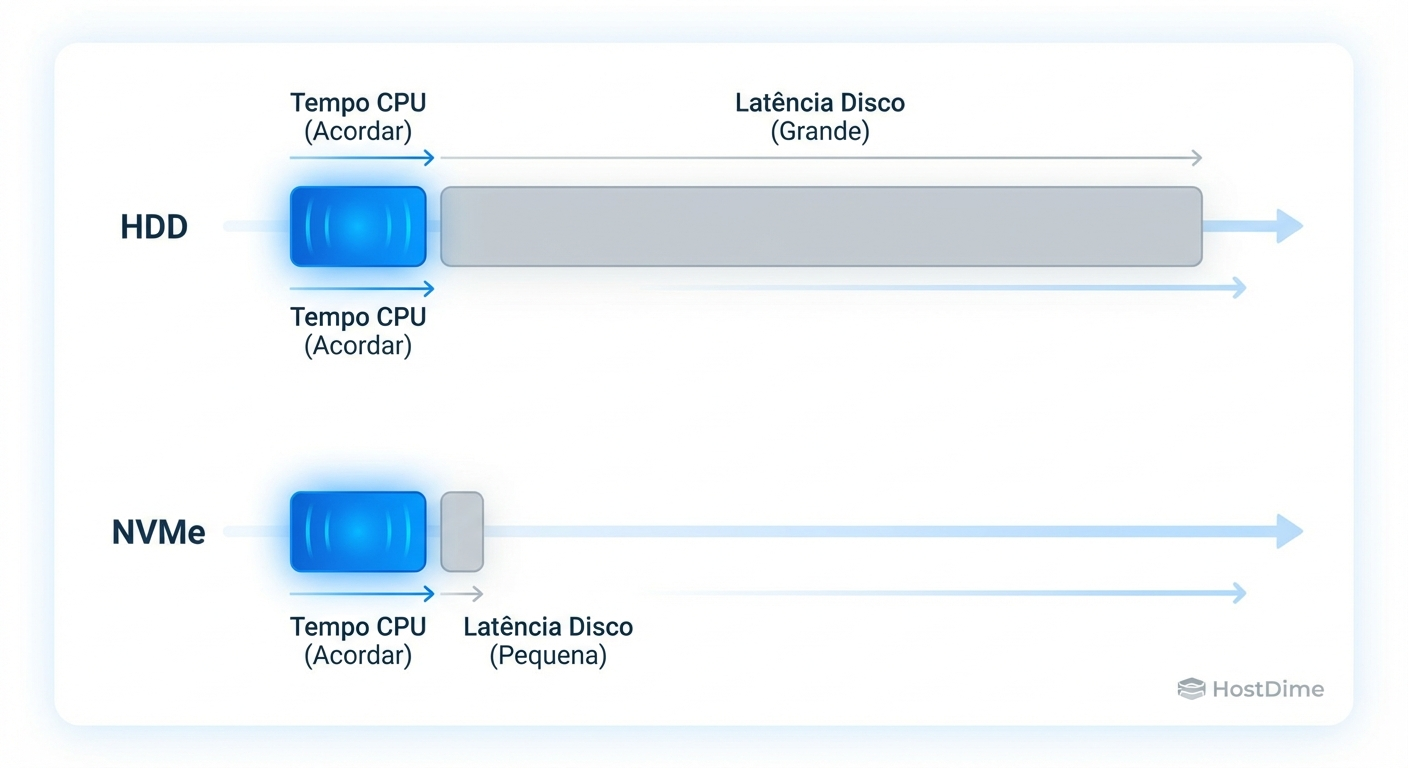

A premissa de substituir dois racks de HDDs SAS por 4U de armazenamento All-Flash NVMe é sedutora. Reduz-se o custo de refrigeração e o aluguel de espaço no datacenter. Contudo, ao concentrar Petabytes em poucas unidades físicas, aumentamos drasticamente o "domínio de falha".

No passado, perder um disco de 600GB em um pool de 100 discos era um evento trivial. Perder um SSD de 60TB em um pool de 10 discos é um evento catastrófico para a performance. O hardware evoluiu para acomodar dados, mas a física do barramento PCIe e a latência da mídia NAND (especialmente QLC) impõem limites que os contratos de serviço muitas vezes ignoram.

O paradoxo da densidade: a crise de IOPS por Terabyte

O problema central não é a velocidade do drive, mas a densidade de performance. Um SSD NVMe Gen4 ou Gen5 possui um limite teórico de throughput. Se você tem um drive de 3.84TB entregando 500k IOPS, você tem uma excelente relação de IOPS/GB.

Ao escalar para 60TB no mesmo form factor e com o mesmo controlador, a performance total do drive não aumenta linearmente com a capacidade. O resultado é que a quantidade de IOPS disponíveis por Terabyte despenca. Se você preencher esse drive de 60TB com centenas de máquinas virtuais de alta transação, o drive se tornará o gargalo, não por falta de velocidade nominal, mas por congestionamento de requisições.

Figura: Comparativo visual do gargalo de interface: enquanto a capacidade de armazenamento cresce exponencialmente, a via de dados (lanes PCIe) permanece constante, criando congestionamento em drives de ultra densidade.

Figura: Comparativo visual do gargalo de interface: enquanto a capacidade de armazenamento cresce exponencialmente, a via de dados (lanes PCIe) permanece constante, criando congestionamento em drives de ultra densidade.

💡 Dica Pro: Ao desenhar o catálogo de serviços, pare de vender "Performance" e "Capacidade" como itens dissociados. Em drives de ultra densidade, a venda de capacidade deve vir atrelada a um cap (limite) de IOPS por volume lógico para evitar que um "vizinho barulhento" drene os recursos do controlador do SSD.

O custo oculto das penalidades: QLC e latência de cauda

A maioria dos drives de ultra capacidade (30TB+) utiliza tecnologia QLC (Quad-Level Cell) para viabilizar o custo. O QLC armazena 4 bits por célula, o que é ótimo para densidade, mas introduz penalidades de latência de escrita significativas comparado ao TLC (Triple-Level Cell).

Para um Gerente de Nível de Serviço, o perigo reside na "latência de cauda" (o percentil 99.99). A média de latência pode estar boa (0.5ms), mas se 0.1% das requisições demorarem 50ms devido a processos de Garbage Collection internos do SSD ou esgotamento do cache SLC, isso é suficiente para derrubar aplicações sensíveis e violar cláusulas de estabilidade.

Tabela comparativa: TLC Enterprise vs. QLC de Alta Densidade

Abaixo, apresento uma análise de risco para definição de SLAs baseada no tipo de mídia subjacente.

| Característica | SSD Enterprise TLC (Padrão) | SSD Enterprise QLC (Ultra Densidade) | Impacto no SLA |

|---|---|---|---|

| Capacidade Típica | 1.92TB a 15.36TB | 15.36TB a 61.44TB+ | QLC favorece arquivamento; TLC favorece transação. |

| Durabilidade (DWPD) | 1 a 3 DWPD | 0.1 a 0.5 DWPD | Risco de desgaste prematuro em QLC se usado para DBs intensivos. |

| Latência de Escrita | Baixa e Consistente | Variável (depende do Cache SLC) | QLC apresenta risco alto de violação de latência em picos de carga. |

| Perfil de Carga Ideal | Mista (Leitura/Escrita) | Leitura Intensiva (80/20 ou 90/10) | Errar o perfil no QLC resulta em multas por lentidão. |

| Custo por GB | Médio/Alto | Baixo | Economia de Capex no QLC pode ser anulada por multas de Opex. |

Mitigação técnica: namespaces e tiering

Para garantir a entrega do serviço contratado sem abandonar a economia dos drives grandes, a arquitetura deve ser defensiva. O uso de NVMe Namespaces permite isolar logicamente partes do drive, garantindo que filas de comando de um tenant não bloqueiem outro.

Além disso, a implementação de camadas (tiering) é obrigatória. O drive de 60TB não deve ser o destino de logs de banco de dados de alta frequência. Ele deve atuar como um repositório "Warm", enquanto drives menores e mais rápidos (como Optane ou NVMe de baixa latência) absorvem o choque das escritas aleatórias.

⚠️ Perigo: Nunca aceite um SLA de "Tempo de Recuperação" (RTO) agressivo em arrays compostos exclusivamente por drives de 60TB sem redundância extrema (ex: Erasure Coding avançado). A reconstrução de 60TB de dados, mesmo a 2GB/s, leva horas. Se um segundo drive falhar nesse período, a perda de dados é certa e a responsabilidade jurídica será sua.

Blindagem jurídica na definição de catálogos

Como ITIL Expert, minha recomendação não é evitar a tecnologia, mas adequar o contrato à realidade física. O catálogo de serviços deve ser explícito:

Tier Platinum (Missão Crítica): Hospedado em TLC ou SCM (Storage Class Memory). SLA de latência garantido. Custo premium.

Tier Capacity (Dados Gerais): Hospedado em QLC de alta densidade. SLA focado em disponibilidade e throughput, mas com tolerância maior para latência de escrita.

Se o cliente exige performance de Tier Platinum pagando preço de Tier Capacity (usando a densidade para baixar o preço), ele deve assinar um termo de ciência sobre os riscos de noisy neighbors (vizinhos barulhentos) e degradação durante janelas de manutenção.

Recomendação final

A era dos SSDs de 60TB e 120TB é inevitável e necessária para a sustentabilidade dos datacenters. No entanto, tratar esses dispositivos como meros "HDDs mais rápidos" é um erro de gestão que custará caro. Revise seus contratos de nível de serviço agora. Certifique-se de que as garantias de performance (IOPS/Latência) estejam atreladas a perfis de carga específicos e não à capacidade bruta alocada. A densidade resolve o problema de espaço, mas a engenharia de contratos é o que garante a sua empregabilidade e a saúde financeira do departamento de TI.

Perguntas Frequentes (FAQ)

O que é a crise de IOPS por Terabyte?

É um fenômeno matemático e físico onde a capacidade de armazenamento do SSD cresce desproporcionalmente em relação à capacidade do seu controlador e interface. Um drive de 60TB pode não ter 10x mais performance que um de 6TB. Isso resulta em menos IOPS disponíveis para cada GB armazenado, criando um risco real de violação de SLAs de performance se o drive for preenchido com cargas de trabalho ativas.Como SSDs de ultra densidade afetam o tempo de reconstrução (rebuild)?

O impacto é direto no Risco de Disponibilidade. Drives massivos exigem janelas de reconstrução muito mais longas em caso de falha. Durante esse período de horas ou dias, o array de armazenamento opera em modo degradado, consumindo recursos de CPU para calcular paridade. Isso aumenta a latência para todos os usuários e eleva o risco de uma segunda falha catastrófica, o que pode gerar multas contratuais severas.SSDs QLC são adequados para cargas de trabalho de missão crítica?

Juridicamente e tecnicamente, a resposta é: com ressalvas extremas. O QLC possui menor durabilidade e performance de escrita aleatória inferior ao TLC. Para SLAs de missão crítica que envolvem alta taxa de escrita (bancos de dados transacionais), o uso de QLC é temerário a menos que haja uma camada robusta de cache ou tiering híbrido à frente. Sem isso, você estará exposto a penalidades por latência alta.

Arthur Sales

Gerente de Nível de Serviço

"Vivo na linha tênue entre a conformidade e a violação contratual. Para mim, 99,9% não é disponibilidade; é prejuízo. Exijo garantias absolutas e aplicação rigorosa de penalidades."