O paradoxo da eficiência: como os C-states destroem a latência em NVMe

Descubra como os modos de economia de energia da CPU (C-states) introduzem latência de interrupção crítica em ambientes de storage de alta performance e como mitigar esse gargalo silencioso.

O silêncio em um data center é uma mentira. Enquanto as ventoinhas giram em um zumbido constante, seus processadores estão jogando um jogo perigoso de "estátua" com seus dados. Você investiu milhares de dólares em arrays NVMe de última geração, otimizou suas queries SQL e ajustou o cache do sistema de arquivos. Ainda assim, a latência de cauda (tail latency) no 99º percentil continua apresentando picos inexplicáveis.

A culpa não é do disco. A culpa é da sua obsessão por eficiência energética.

No mundo da engenharia do caos, aprendemos que sistemas complexos falham de maneiras complexas. Mas aqui, a falha é estúpida e previsível: seu servidor está dormindo no trabalho. Os C-states (estados de economia de energia da CPU) são o vetor de ataque silencioso que transforma latências de microssegundos em esperas de milissegundos, sabotando a performance bruta que o protocolo NVMe foi desenhado para entregar.

Resumo em 30 segundos

- O Inimigo Invisível: CPUs modernas entram em estados de sono profundo (C-states) agressivamente para economizar energia, desligando clocks e voltagem.

- O Custo do Despertar: Sair de um estado profundo (C6) para processar uma interrupção de I/O leva tempo. Esse atraso é maior que o tempo de acesso do próprio NVMe.

- A Solução Brutal: Para obter latência determinística em storage de alta performance, você deve impedir que a CPU durma, forçando o consumo de energia em troca de responsividade imediata.

O vetor de ataque silencioso nas configurações padrão da BIOS

A maioria dos administradores de sistemas confia nas configurações de fábrica. Isso é um erro fatal em ambientes de storage de alta densidade. Os fabricantes de servidores (Dell, HPE, Supermicro) enviam equipamentos configurados para brilhar em benchmarks de eficiência energética, como o SPECpower, e não para sustentar a latência ultrabaixa exigida por bancos de dados transacionais ou clusters de Ceph/MinIO.

Quando você deixa o perfil da BIOS em "Balanced" ou "Performance per Watt", você está autorizando o processador a cortar a própria garganta sempre que houver uma pausa de milissegundos no tráfego.

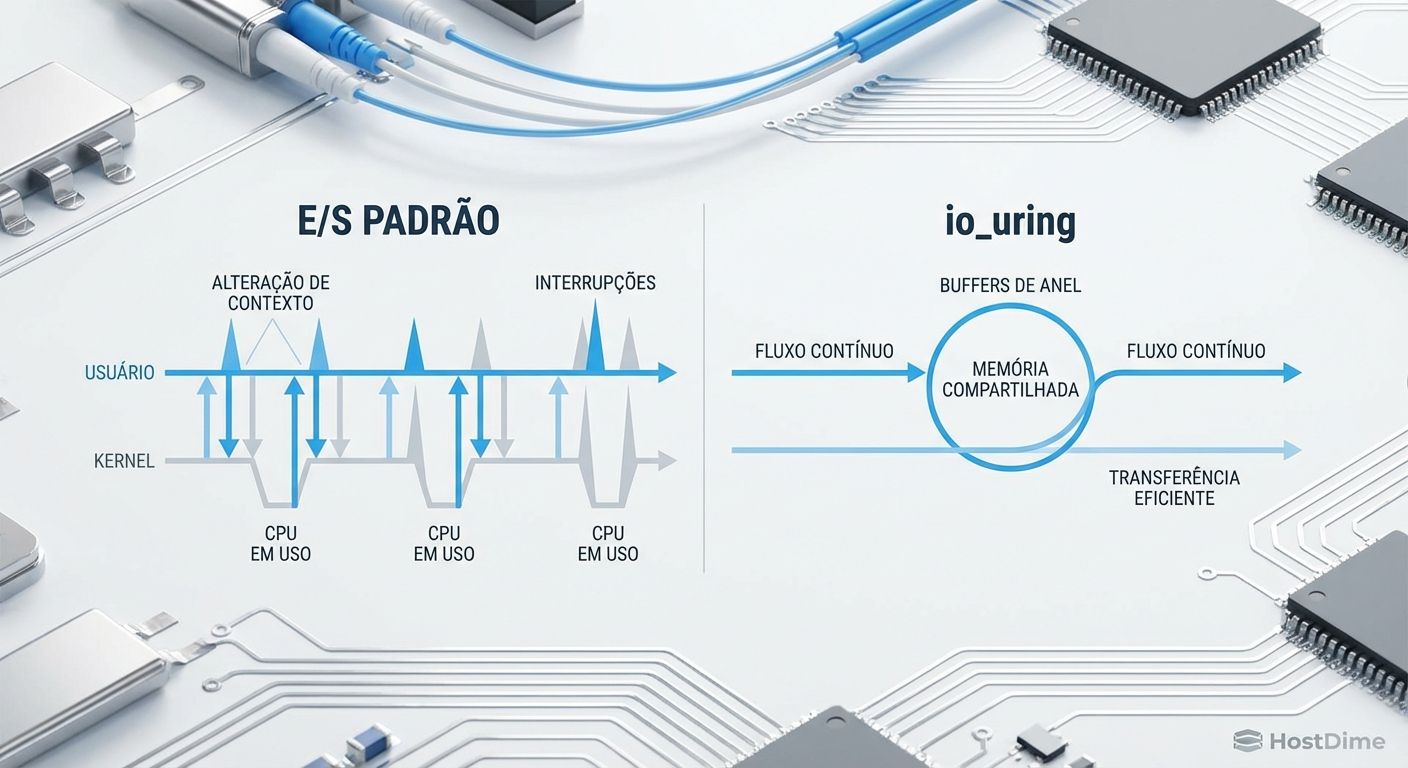

O protocolo NVMe reduziu a latência de acesso ao meio físico para a casa dos 20 a 100 microssegundos. Antigamente, com HDDs mecânicos, esperar 10 ou 20 microssegundos para a CPU "acordar" era irrelevante diante dos 5 a 10 milissegundos que o braço mecânico levava para buscar o dado. O ruído da CPU era engolido pela lentidão do disco.

Hoje, a situação se inverteu. O disco é mais rápido que o tempo de reação de uma CPU sonolenta.

Figura: Comparativo visual: Como a latência de despertar da CPU (Wake-up Latency) se tornou o gargalo principal na era NVMe em comparação aos HDDs mecânicos.

Figura: Comparativo visual: Como a latência de despertar da CPU (Wake-up Latency) se tornou o gargalo principal na era NVMe em comparação aos HDDs mecânicos.

A física da transição de estados e o impacto direto no NVMe

Para entender o dano, precisamos dissecar o que acontece no silício. Os processadores operam em estados designados como "C".

C0: O processador está operando, executando instruções. A latência é zero.

C1/C1E (Halt): O clock do núcleo é interrompido. O despertar é rápido, mas não instantâneo.

C6 (Deep Power Down): O estado de coma. O núcleo tem sua voltagem reduzida a quase zero, o cache L1/L2 é limpo (flushed) para o L3 ou memória, e o estado arquitetural é salvo.

O problema reside na Latência de Saída (Exit Latency).

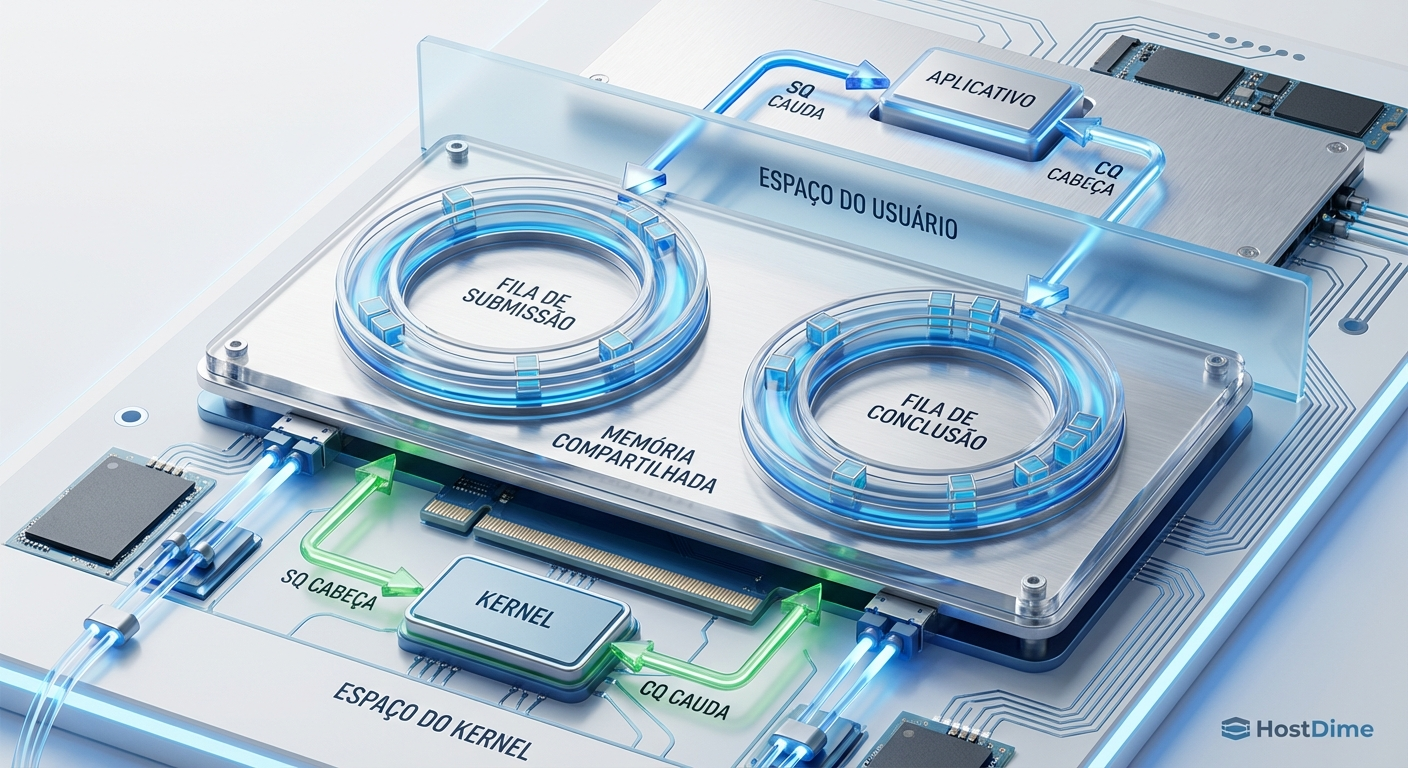

Quando um SSD NVMe completa uma operação de leitura, ele envia uma interrupção (MSI-X) para a CPU avisando: "Seus dados estão prontos". Se o núcleo responsável por tratar essa interrupção estiver em C6, ele precisa:

Restaurar a voltagem.

Religar o clock (PLL).

Restaurar o estado arquitetural.

Só então processar a interrupção e entregar os dados à aplicação.

Esse processo de "acordar" do C6 pode levar de 10 a 100 microssegundos, dependendo da arquitetura (Skylake, Cascade Lake, EPYC). Se o seu SSD NVMe lê em 80 microssegundos, e a CPU leva 40 microssegundos para acordar, você acabou de aumentar sua latência em 50% apenas por tentar economizar alguns watts.

⚠️ Perigo: Em cargas de trabalho mistas, onde o tráfego é "bursty" (rajadas), a CPU tenta correr para o C6 nos intervalos. O resultado é um gráfico de latência em "dentes de serra", onde cada nova requisição paga a penalidade máxima de despertar.

Tabela de impacto: Estados de energia vs. Latência de Storage

| Estado (C-State) | O que acontece no Hardware? | Latência de Saída (Estimada) | Impacto em NVMe |

|---|---|---|---|

| C0 | Execução plena. Clocks ativos. | 0 µs | Nenhum. Performance máxima. |

| C1 / C1E | Clock parado (Halt). Voltagem mantida. | ~1-2 µs | Insignificante para a maioria dos casos. |

| C3 | Sleep. Caches começam a ser desligados. | ~10-20 µs | Notável. Começa a afetar IOPS sensíveis. |

| C6 | Deep Sleep. Voltagem cortada. Cache flush. | ~40-100+ µs | Catastrófico. Dobra a latência de leitura. |

O erro comum de confiar no governor ondemand para bancos de dados

O sistema operacional tenta gerenciar isso através de "governors" de frequência e estados ociosos (cpuidle). O padrão em muitas distribuições Linux é o ondemand ou powersave (em processadores Intel modernos usando intel_pstate).

A lógica do ondemand é reativa: "Se eu vir carga, eu aumento a frequência e impeço o sono". O problema é a histerese. O governor precisa de amostras de tempo para decidir mudar de estado. Para um banco de dados como PostgreSQL ou MySQL rodando sobre NVMe, a transação muitas vezes já acabou antes que o governor perceba que deveria ter acordado a CPU.

Você está sempre um passo atrás da requisição. Em testes de caos, observamos que forçar o governor para performance ajuda, mas não resolve o problema dos C-states profundos, pois o governor de frequência (P-states) e o driver de ociosidade (C-states) operam de formas distintas, embora correlacionadas.

💡 Dica Pro: Não confunda P-states (frequência/clock) com C-states (ociosidade). Você pode ter uma CPU rodando a 4.0GHz (P0) que decide entrar em C6 no instante em que a fila de I/O esvazia por um microssegundo. Ambos precisam ser controlados.

A arquitetura de latência zero via kernel boot parameters

Se você quer resiliência e performance preditiva, precisa ser implacável. A única maneira de garantir que a latência de despertar não destrua seu SLA de storage é impedir que o processador entre em estados profundos.

Não basta alterar a BIOS. O Kernel Linux moderno muitas vezes ignora a BIOS se achar que sabe mais (e ele acha). A intervenção precisa ser feita no nível do bootloader (GRUB).

A abordagem mais eficaz para servidores de storage críticos é limitar o estado máximo de ociosidade ao C1. O estado C1 é um compromisso aceitável: ele para o clock (economizando algo), mas mantém a voltagem e os caches quentes, permitindo um despertar quase instantâneo.

A implementação técnica

Para sistemas Intel, o parâmetro mágico é intel_idle.max_cstate=1. Para uma abordagem mais genérica (ou AMD), processor.max_cstate=1.

Ao adicionar isso à linha GRUB_CMDLINE_LINUX_DEFAULT no /etc/default/grub e atualizar o bootloader, você está efetivamente dizendo ao kernel: "Nunca deixe este hardware dormir além de um cochilo leve".

O resultado visual nos gráficos de monitoramento é imediato. A linha de base de latência se torna uma reta plana. Os picos aleatórios de 2ms em leituras de disco desaparecem.

Figura: Antes e Depois: O impacto visual da restrição de C-states na estabilidade da latência de I/O em um workload de banco de dados.

Figura: Antes e Depois: O impacto visual da restrição de C-states na estabilidade da latência de I/O em um workload de banco de dados.

No entanto, prepare-se para o efeito colateral térmico. Seus servidores vão rodar mais quentes. O consumo de energia em "idle" vai subir drasticamente. Mas em infraestrutura crítica, energia é o preço que pagamos pela certeza.

Protocolo de emergência para diagnosticar stalls de interrupção

Como saber se você é uma vítima agora? Não adivinhe. Meça.

Ferramentas de observabilidade de alto nível (Datadog, Prometheus) muitas vezes mascaram esse problema porque fazem médias de 10 ou 60 segundos. O problema dos C-states acontece na escala de microssegundos.

Use o turbostat (parte do pacote linux-cpupower ou kernel-tools). Ele lê diretamente os registradores MSR da CPU.

Execute:

turbostat --interval 1

Observe as colunas C3, C6, C7. Se você vir porcentagens altas nessas colunas enquanto seu banco de dados está tentando processar transações, você encontrou seu gargalo. A coluna POLL ou C0 deve ser dominante em sistemas de baixa latência.

Outro indicador é o /proc/interrupts. Se você notar que as interrupções do NVMe estão sendo processadas por CPUs que passam muito tempo em C6, você tem um problema de afinidade ou de configuração de energia.

O teste de fogo

Para validar a hipótese, execute um teste de carga sintético com fio focado em latência (iodepth=1) e observe o 99.9th percentile.

Rode o teste com a configuração atual.

Aplique

cpupower idle-set -D 0(desabilita estados profundos temporariamente em runtime, se o driver permitir).Rode o teste novamente.

Se a latência de cauda cair pela metade, você acabou de provar que a "eficiência" estava matando sua performance.

O preço da certeza

A busca por "TI Verde" é nobre, mas em camadas de persistência de dados de alta performance, ela é antagônica à qualidade de serviço. O paradoxo é claro: para que o sistema seja rápido e responsivo (eficiente no tempo), ele precisa ser ineficiente na energia.

Não espere que os fabricantes resolvam isso para você. As datasheets de SSDs NVMe mostram números de laboratório obtidos em condições ideais, com C-states desabilitados, embora eles raramente mencionem isso nas letras miúdas.

Se o seu negócio depende da velocidade com que um bit sai do flash NAND e chega à memória RAM, desligue a economia de energia. Deixe o mundo arder um pouco mais quente para que seus dados fluam como água, e não como melado. A resiliência vem da eliminação de variáveis, e o tempo de despertar da CPU é uma variável que você não pode se dar ao luxo de manter.

Referências & Leitura Complementar

Intel 64 and IA-32 Architectures Software Developer Manuals - Volume 3B: System Programming Guide, Part 2 (Capítulo sobre Power and Thermal Management).

SNIA (Storage Networking Industry Association) - Performance Solid State Storage State of the Market.

Linux Kernel Documentation -

admin-guide/pm/cpuidle.rsteadmin-guide/kernel-parameters.txt.JEDEC - Padrões de interface para SSDs e gerenciamento de energia em dispositivos de armazenamento.

O que são C-states e por que afetam o storage?

C-states são modos de economia de energia onde a CPU desliga subsistemas internos (clocks, caches, voltagem). Sair de um estado profundo (como C6) para processar uma interrupção de I/O leva tempo (latência de despertar). Esse atraso, muitas vezes de dezenas de microssegundos, é adicionado a cada operação de leitura/escrita, atrasando significativamente a resposta de discos rápidos como NVMe.Devo desativar todos os C-states em servidores de banco de dados?

Geralmente, limitar ao estado C1 ou C1E é a melhor prática para latência ultrabaixa. O estado C1 acorda rápido o suficiente para não impactar o NVMe. Desativar tudo (forçar C0 constante via loop de polling) pode causar superaquecimento desnecessário sem ganho real sobre o C1, mas permitir C6 é fatal para a consistência do IOPS e latência de cauda.Como verifico se minha CPU está entrando em estados profundos?

No Linux, ferramentas como 'turbostat' (do pacote linux-cpupower) mostram em tempo real a residência em cada estado C. Alternativamente, a leitura direta de arquivos em '/sys/devices/system/cpu/cpu*/cpuidle' pode revelar estatísticas de uso e tempo gasto nas transições de cada estado.

Magnus Vance

Engenheiro do Caos

"Quebro sistemas propositalmente porque a falha é inevitável. Transformo desastres simulados em vacinas para sua infraestrutura. Se não sobrevive ao meu caos, não merece estar em produção."