Tempestades de slow drain em Fibre Channel: como o colapso de B2B credits derruba sua SAN

Entenda a mecânica do esgotamento de Buffer-to-Buffer credits em redes Fibre Channel e aprenda a isolar dispositivos slow drain antes que o head-of-line blocking paralise seu storage.

A latência é o predador invisível dos datacenters modernos. Você analisa os gráficos da sua controladora de storage all-flash e os tempos de resposta internos estão na casa dos microssegundos. No entanto, os administradores de virtualização reportam que as máquinas virtuais estão congelando, com picos de latência ultrapassando a marca de 500 milissegundos. O diagnóstico inicial quase sempre aponta para os discos, mas o verdadeiro culpado está escondido na malha óptica que conecta seus servidores aos arrays de armazenamento.

Quando uma rede Fibre Channel (FC) começa a apresentar engasgos inexplicáveis que afetam múltiplos hosts simultaneamente, você provavelmente está diante de uma tempestade de slow drain. Este fenômeno ocorre quando a arquitetura de entrega garantida do protocolo FC se volta contra a própria infraestrutura, criando um efeito cascata de congestionamento que pode derrubar clusters inteiros.

Resumo em 30 segundos

- Dispositivos lentos (slow drain) falham em devolver créditos de buffer a tempo, forçando os switches a reterem tráfego e esgotarem seus recursos.

- Esse esgotamento gera o head-of-line blocking, um congestionamento que se espalha pelos links entre switches (ISLs) e afeta servidores saudáveis.

- A mitigação exige ferramentas de telemetria nos ASICs dos switches para isolar portas problemáticas e forçar o descarte de frames expirados.

Latência fantasma e datastores desconectados na malha de storage

O sintoma mais clássico de um problema de slow drain é a instabilidade generalizada nos caminhos de armazenamento. Em ambientes VMware ESXi, isso se manifesta como eventos frequentes de All Paths Down (APD) ou Permanent Device Loss (PDL). O hypervisor tenta enviar comandos SCSI ou NVMe para o datastore, mas os pacotes simplesmente não retornam no tempo esperado.

A frustração da equipe de operações ocorre porque o problema parece intermitente e migratório. Um servidor físico que estava operando perfeitamente de repente perde acesso aos seus volumes lógicos (LUNs), apenas para se recuperar minutos depois. Essa latência fantasma não é gerada por discos sobrecarregados, mas sim por um gargalo de trânsito na camada de rede de armazenamento (SAN).

⚠️ Perigo: Reiniciar controladoras de storage ou trocar cabos aleatoriamente durante uma tempestade de slow drain pode agravar o problema, forçando renegociações de malha (fabric logins) que consomem ainda mais recursos dos switches já estressados.

A mecânica do head-of-line blocking e a inanição de primitivas R_RDY

Para entender o colapso, precisamos olhar para o controle de fluxo do Fibre Channel. Diferente do tráfego Ethernet tradicional que simplesmente descarta pacotes em caso de congestionamento, o FC é uma rede sem perdas (lossless). Ele utiliza um mecanismo chamado Buffer-to-Buffer (B2B) credits para garantir que um transmissor só envie dados se o receptor tiver espaço na memória para recebê-los.

Cada vez que um switch envia um frame para um Host Bus Adapter (HBA) no servidor, ele consome um crédito. Quando o HBA processa esse frame, ele envia um sinal de volta chamado Receiver Ready (R_RDY), que reabastece o saldo de créditos do switch. O problema começa quando um HBA defeituoso, um driver desatualizado ou um cabo óptico sujo faz com que o servidor demore para processar os dados e enviar o R_RDY.

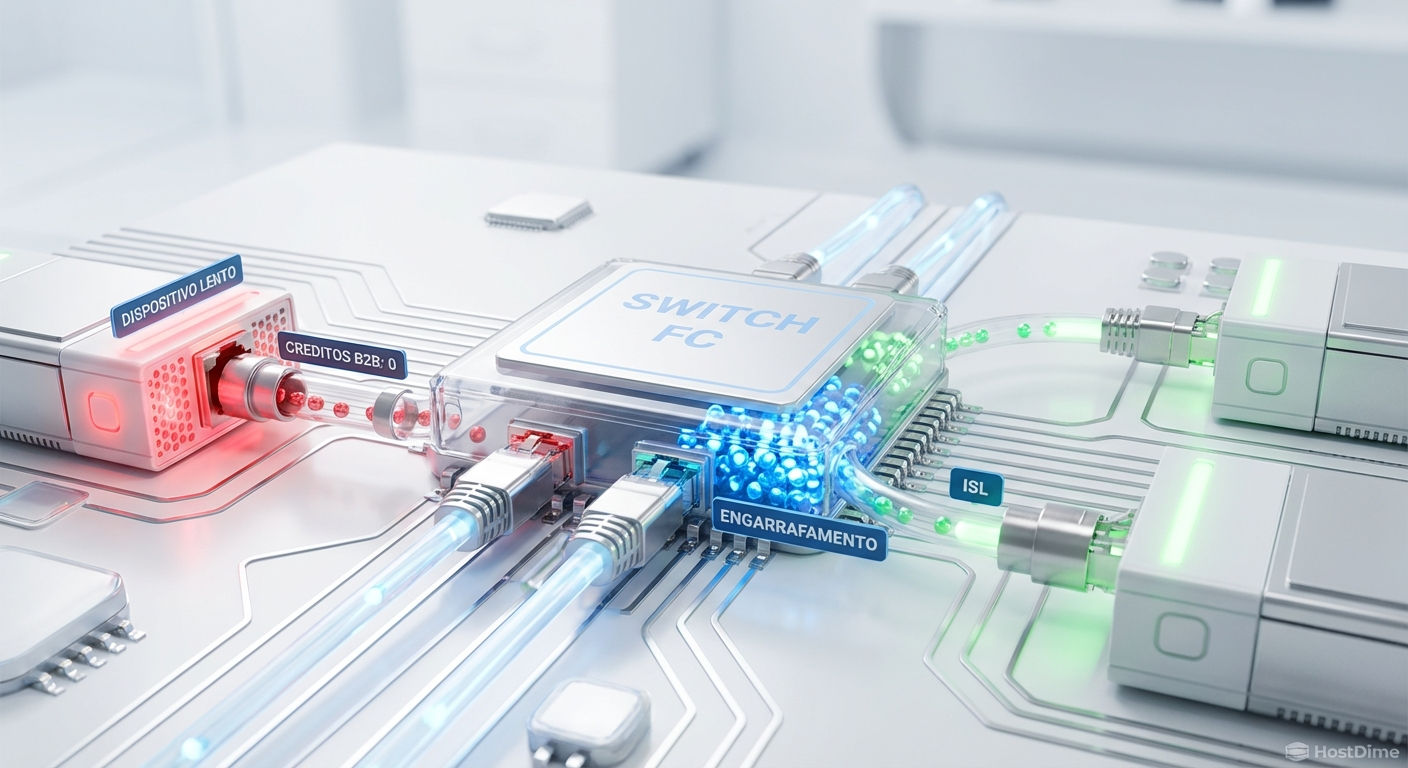

A porta do switch atinge o estado de "Tx Credit Zero". Como o FC proíbe o descarte imediato, o switch é obrigado a segurar os frames destinados àquele servidor lento em seus próprios buffers. Se esses frames precisarem atravessar um Inter-Switch Link (ISL) que conecta dois switches core, os buffers do ISL também ficarão cheios.

Figura: Representação visual do esgotamento de B2B credits causando Head-of-Line blocking em um link ISL compartilhado.

Figura: Representação visual do esgotamento de B2B credits causando Head-of-Line blocking em um link ISL compartilhado.

Neste momento, ocorre o head-of-line blocking. O tráfego destinado a servidores perfeitamente saudáveis, que compartilham o mesmo ISL, fica preso atrás do tráfego do servidor lento. Um único host problemático acaba sequestrando a performance de toda a SAN.

Por que adicionar mais links ISL ou aumentar o baud rate não resolve o gargalo

A reação instintiva de muitos arquitetos de infraestrutura ao ver links ISL saturados é adicionar mais cabos físicos (trunks) ou atualizar os transceivers de 16GFC para 32GFC ou 64GFC. No entanto, em cenários de slow drain, jogar mais largura de banda no problema é um desperdício de orçamento.

O gargalo não é a falta de velocidade no meio físico, mas sim a ausência de permissão lógica (créditos) para transmitir. Se você atualizar um link para 32GFC, o switch simplesmente esgotará seus B2B credits na metade do tempo ao tentar falar com o dispositivo lento, chegando ao estado de bloqueio ainda mais rápido.

| Característica | Aumento de Largura de Banda (Ex: 16G para 32G) | Otimização de B2B Credits e Buffers |

|---|---|---|

| Foco da Ação | Velocidade de transmissão física no cabo. | Gerenciamento lógico da memória do switch. |

| Efeito no Slow Drain | Piora o cenário, esgotando créditos mais rápido. | Isola o problema e libera o tráfego saudável. |

| Custo Financeiro | Alto (requer novos SFPs, cabos e licenças). | Baixo (configuração de software existente). |

| Resolução do HOL Blocking | Nenhuma. O congestionamento em cascata continua. | Alta. Quebra a cascata de retenção de frames. |

A solução real exige inteligência na borda da rede, forçando a malha a abandonar sua regra estrita de "zero perda de pacotes" quando a integridade do ecossistema como um todo está em risco.

Isolamento cirúrgico com políticas de monitoramento de portas e descarte de frames

Para salvar a SAN, os fabricantes de switches implementaram lógicas de proteção nos ASICs (Application-Specific Integrated Circuits). Ferramentas como o Brocade MAPS (Monitoring and Alerting Policy Suite) ou o Cisco Port Monitor são essenciais para detectar e neutralizar tempestades de slow drain antes que elas afetem o ambiente de produção.

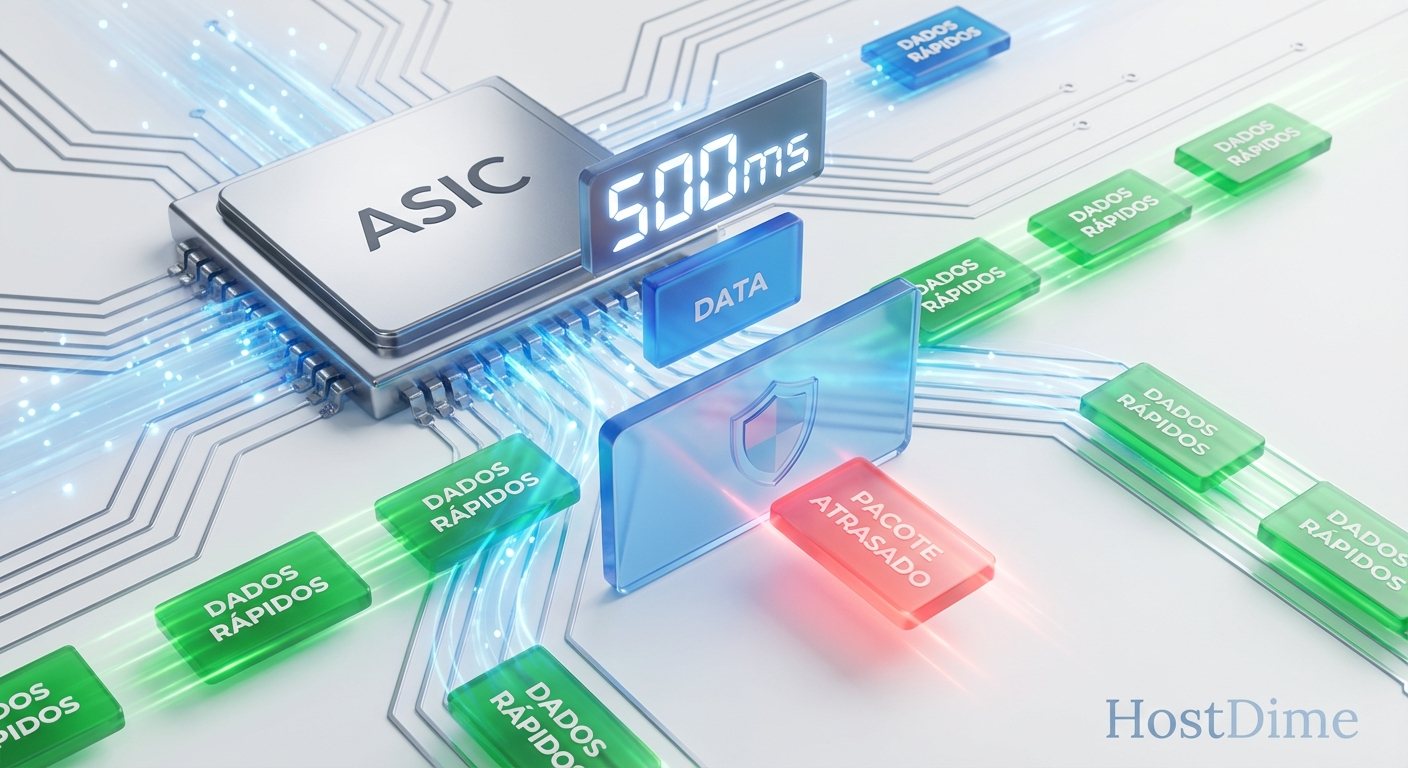

A principal linha de defesa é a configuração do Edge Hold Time. Trata-se de um temporizador rigoroso aplicado às portas de borda (F-Ports) conectadas aos servidores e storages. Se um frame ficar retido no buffer do switch por mais tempo que o limite configurado (geralmente entre 100 e 500 milissegundos) devido à falta de créditos, o switch descarta o frame proativamente.

Figura: ASIC de um switch Fibre Channel aplicando a política de Edge Hold Time e descartando frames expirados para proteger a malha.

Figura: ASIC de um switch Fibre Channel aplicando a política de Edge Hold Time e descartando frames expirados para proteger a malha.

Ao descartar o frame atrasado, o switch libera o buffer do ISL. O protocolo de rede falha intencionalmente, transferindo a responsabilidade de retransmissão para as camadas superiores, como o driver multipath do hypervisor ou o protocolo SCSI/NVMe. Isso sacrifica a performance do servidor problemático, mas salva o resto do datacenter.

💡 Dica Pro: Configure políticas de isolamento automático. Se uma porta registrar múltiplos descartes de frames ou passar muito tempo em "Tx Credit Zero", o switch pode rebaixar a prioridade dessa porta ou colocá-la em quarentena lógica, emitindo um alerta crítico para a equipe de storage.

Auditoria de telemetria no switch e estabilização das filas de multipath no hypervisor

Resolver o sintoma no switch é apenas metade do trabalho. O operador de storage precisa investigar a causa raiz no host. A telemetria da SAN frequentemente aponta para problemas na camada física (Camada 1). Conectores LC sujos, poeira nos transceivers SFP+ ou microcurvaturas nos cabos de fibra óptica causam atenuação do sinal de luz. Isso gera erros de CRC (Cyclic Redundancy Check). O HBA receptor gasta ciclos de CPU descartando frames corrompidos e pedindo retransmissões, o que atrasa o envio das primitivas R_RDY.

No nível lógico, o desalinhamento das filas de I/O (Queue Depth) é um ofensor comum. Se o hypervisor estiver configurado para enviar 256 comandos simultâneos por LUN, mas o HBA físico ou a porta da controladora de storage só suportar 64, os buffers transbordarão rapidamente.

Figura: Comparação entre um cabo óptico sujo gerando erros de CRC e uma conexão limpa garantindo o fluxo contínuo de dados.

Figura: Comparação entre um cabo óptico sujo gerando erros de CRC e uma conexão limpa garantindo o fluxo contínuo de dados.

É vital revisar as políticas de multipath (MPIO). Configurações agressivas de Round Robin, que alternam caminhos a cada 1 IOPS, são excelentes para balanceamento de carga em arrays all-flash modernos. Contudo, se um dos caminhos físicos estiver sofrendo de degradação óptica, o MPIO enviará tráfego para um buraco negro intermitente, desencadeando o slow drain. O ajuste fino dos drivers de HBA e a atualização de firmwares são passos inegociáveis para a estabilidade.

A urgência da resiliência em arquiteturas de ultra-baixa latência

A transição massiva dos datacenters para o protocolo NVMe-oF (NVMe over Fibre Channel) eleva a criticidade do gerenciamento de B2B credits a um novo patamar. O NVMe foi desenhado para paralelismo massivo, eliminando as travas do antigo protocolo SCSI. Isso significa que os servidores modernos podem inundar a malha SAN com milhões de IOPS em frações de segundo.

Neste cenário de altíssima velocidade, um dispositivo slow drain causará um estrago muito mais rápido e severo. A tolerância para latência na era do NVMe é medida em microssegundos. Portanto, a adoção de malhas de armazenamento autônomas, capazes de aplicar self-healing, isolar portas degradadas em tempo real e ajustar buffers dinamicamente, não é mais um luxo operacional. É um requisito fundamental para garantir a sobrevivência e a performance dos workloads de missão crítica.

Referências e leitura complementar

SNIA (Storage Networking Industry Association): Fibre Channel Framing and Signaling Interface (FC-FS-6) - Especificações técnicas sobre controle de fluxo e primitivas R_RDY.

Broadcom / Brocade: Fabric OS (FOS) MAPS Administrator Guide - Melhores práticas para configuração de Edge Hold Time e isolamento de portas.

Cisco Systems: MDS 9000 Series NX-OS SAN Design Guide - Arquitetura de mitigação de slow drain e gerenciamento de B2B credits em malhas complexas.

VMware by Broadcom: vSphere Storage Guide - Resolução de problemas de latência de armazenamento, APD e PDL relacionados à infraestrutura Fibre Channel.

O que é um dispositivo slow drain em uma rede SAN?

É um host (HBA) ou storage que aceita frames Fibre Channel de forma muito lenta, não devolvendo os B2B credits a tempo para o switch. Isso força o switch a reter tráfego em seus buffers, causando um congestionamento em cascata conhecido como head-of-line blocking, que acaba afetando outros dispositivos saudáveis que compartilham os mesmos links ISL.Como ferramentas como Brocade MAPS ou Cisco Device Manager mitigam o esgotamento de B2B credits?

Essas ferramentas monitoram ativamente os ASICs dos switches para medir o tempo exato que as portas passam no estado de 'zero credits' (Tx Credit Zero). Ao detectar que uma porta ultrapassou um limite crítico de retenção, o sistema pode alertar a engenharia ou aplicar ações automatizadas, como colocar a porta problemática em quarentena (F-Port isolation) ou forçar o descarte de frames atrasados, protegendo a integridade da malha.Problemas físicos, como cabos ópticos sujos, podem causar tempestades de slow drain?

Sim. A atenuação óptica causada por sujeira nos conectores LC ou microcurvaturas na fibra gera erros de CRC e perda de frames em trânsito. O dispositivo receptor gasta ciclos de processamento lidando com os erros e solicitando retransmissões, o que atrasa severamente a devolução das primitivas R_RDY (credits) para o switch, iniciando o efeito cascata de lentidão na SAN.

Alexandre Tavares

Operador de Storage em Rede (SAN/NAS)

"Respiro Fibre Channel e NVMe-oF. Meu foco é eliminar gargalos de I/O e otimizar rotas multipath para garantir que seus dados trafeguem com a menor latência possível."