Turbinando HDDs com ZFS Special VDEV: metadados em NVMe para latência zero

Aprenda a configurar o ZFS Special VDEV para segregar metadados em SSDs NVMe. Transforme seu pool de HDDs lentos em um storage híbrido de alta performance no home lab.

Sabe aquele barulho de "pipoca estourando" que vem do seu servidor quando você tenta listar uma pasta com milhares de fotos ou quando o Plex está escaneando a biblioteca? Aquele ruído mecânico das cabeças de leitura dos discos rígidos dançando freneticamente de um lado para o outro? Pois é, isso é o som da latência matando a performance do seu home lab.

Nós amamos discos rígidos (HDDs). Eles são baratos, confiáveis e oferecem densidade de armazenamento que o flash ainda não consegue bater no custo por terabyte. Mas vamos ser honestos: para operações aleatórias e metadados, eles são terríveis. É física pura. Mover um braço mecânico leva tempo.

Mas e se eu te dissesse que existe uma maneira de manter a capacidade massiva e barata dos seus HDDs, mas fazer a navegação de arquivos e a responsividade do sistema parecerem com um array 100% flash? Não é cache, não é L2ARC. Estamos falando do ZFS Special VDEV.

Resumo em 30 segundos

- O Problema: HDDs são ótimos para ler arquivos grandes sequenciais, mas péssimos para buscar onde esses arquivos estão (metadados), causando lentidão na navegação.

- A Solução: O ZFS Special VDEV permite isolar metadados (e arquivos pequenos) em SSDs/NVMes dedicados, enquanto os dados brutos ficam nos HDDs.

- O Risco: Diferente do cache (L2ARC), se o Special VDEV falhar sem redundância, você perde o pool inteiro. Espelhamento (Mirror) é obrigatório.

O gargalo mecânico: por que seus discos "engasgam"?

Para entender a mágica do Special VDEV, precisamos olhar para a anatomia de um disco rígido. Um HDD moderno de 7200 RPM consegue entregar algo em torno de 80 a 120 IOPS (operações de entrada/saída por segundo) em leitura aleatória. Isso é patético comparado a um SSD NVMe barato que entrega 300.000 IOPS.

O problema é que o sistema de arquivos ZFS é um sistema "Copy-on-Write" complexo. Para ler um arquivo, o sistema precisa ler os metadados (informações sobre o arquivo: permissões, localização dos blocos, data de criação). Esses metadados estão espalhados pelo disco.

Quando você digita ls -la em um diretório com 10.000 arquivos, o braço do HDD precisa buscar fisicamente a informação de cada um desses arquivos. É aqui que a latência dispara. O disco não está limitado pela taxa de transferência (MB/s), mas pela física do movimento mecânico (tempo de busca ou seek time).

Figura: Comparação visual: O caos mecânico da busca em HDDs versus o acesso direto e instantâneo da memória flash em NVMes.

Figura: Comparação visual: O caos mecânico da busca em HDDs versus o acesso direto e instantâneo da memória flash em NVMes.

É por isso que seu servidor de arquivos, mesmo com 100TB de espaço e conectado a uma rede 10GbE, às vezes parece lento apenas para abrir uma pasta. O gargalo não é a rede, nem a CPU: é a agulha no palheiro magnético.

O que é o Special VDEV (e por que não é L2ARC)?

Muitos entusiastas confundem o Special VDEV com o L2ARC (Level 2 Adaptive Replacement Cache). A diferença é brutal e crítica para a segurança dos seus dados.

L2ARC (Cache de Leitura): É uma cópia temporária dos dados mais acessados. Se o SSD do L2ARC pegar fogo, você não perde nada. O ZFS apenas volta a ler dos discos lentos.

Special VDEV (Armazenamento Dedicado): É parte integrante da estrutura do seu pool. Ele não armazena cópias; ele armazena os dados originais de Metadados, Tabelas de Deduplicação (DDT) e, opcionalmente, Blocos Pequenos.

Ao adicionar um Special VDEV, você diz ao ZFS: "Ei, grave todos os mapas, índices e estruturas de arquivos neste NVMe ultra-rápido, e deixe os HDDs apenas para armazenar os blocos pesados de dados (filmes, ISOs, backups)."

O resultado? As operações de busca tornam-se instantâneas. Aquele barulho de "pipoca" desaparece porque os HDDs só giram para ler ou gravar o arquivo em si, não para procurá-lo.

Dimensionando o Hardware: A Regra dos 0.3%

A pergunta de um milhão de dólares no Reddit e nos fóruns do ServeTheHome é sempre a mesma: "Qual tamanho de SSD eu preciso?"

A resposta depende do seu uso, mas existe uma regra de ouro baseada em estatísticas de servidores de arquivos gerais.

💡 Dica Pro: Para armazenamento de metadados puros, calcule 0.3% da capacidade total do seu pool.

Se você tem um pool de 100TB de HDDs:

100.000 GB * 0.003 = 300 GB

Um par de SSDs de 480GB ou 512GB seria mais que suficiente para segurar todos os metadados desse pool gigantesco.

A Necessidade Absoluta de Espelhamento (Mirror)

Aqui entra o aviso mais importante deste artigo. Você não pode brincar com a segurança do Special VDEV.

Como os metadados residem exclusivamente nesses SSDs, se você usar um único drive e ele falhar, você perde todo o seu pool ZFS. Todos os 100TB de dados nos HDDs tornam-se lixo digital inacessível, pois o mapa para ler esses dados desapareceu.

Portanto, a topologia mínima obrigatória para um Special VDEV é um Mirror (RAID-1) de dois dispositivos. Se possível, use SSDs de classe Enterprise (com proteção contra perda de energia - PLP), como os modelos Intel Optane (se tiver orçamento) ou séries Micron/Samsung de datacenter usados que encontramos no eBay ou AliExpress. Mas mesmo NVMes de consumo em espelho são infinitamente melhores que nada.

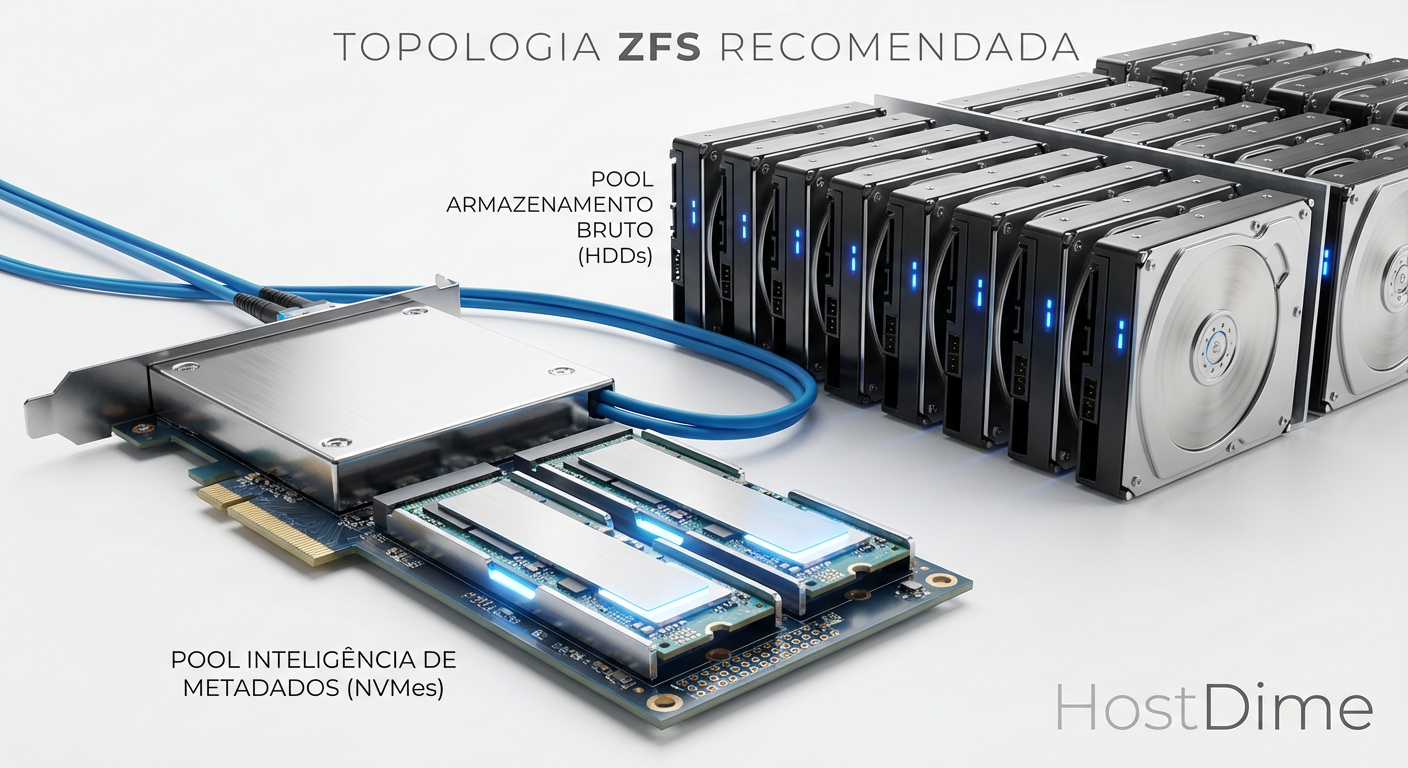

Figura: Topologia recomendada: O Pool ZFS dividido entre o armazenamento bruto (RAIDZ2 de HDDs) e a inteligência de metadados (Mirror de NVMes).

Figura: Topologia recomendada: O Pool ZFS dividido entre o armazenamento bruto (RAIDZ2 de HDDs) e a inteligência de metadados (Mirror de NVMes).

Mão na Massa: Implementando via CLI

Vamos para a parte divertida. Suponha que você já tenha um pool chamado tank rodando em seus HDDs e você acabou de instalar dois SSDs NVMe (/dev/nvme0n1 e /dev/nvme1n1) no seu servidor.

Passo 1: Identifique os IDs dos discos

Nunca use os nomes curtos (nvme0n1), pois eles podem mudar ao reiniciar. Use os IDs únicos.

ls -l /dev/disk/by-id/ | grep nvme

Vamos supor que encontramos:

nvme-Samsung_980_PRO_S5GX...nvme-Samsung_980_PRO_S5GY...

Passo 2: Adicionar o Special VDEV

O comando é simples, mas poderoso. Certifique-se de usar a palavra-chave mirror.

zpool add tank special mirror \

/dev/disk/by-id/nvme-Samsung_980_PRO_S5GX... \

/dev/disk/by-id/nvme-Samsung_980_PRO_S5GY...

Pronto. A partir deste exato momento, qualquer novo dado gravado terá seus metadados direcionados para o NVMe.

⚠️ Perigo: O comando acima é imediato. Se você esquecer a palavra

mirror, o ZFS pode adicionar os discos como stripe (RAID 0), dobrando seu risco de falha. Verifique três vezes antes de apertar Enter.

Passo 3: E os dados antigos?

O ZFS não move magicamente os metadados existentes dos HDDs para o SSD. O Special VDEV só afeta novas gravações. Para "migrar" os dados antigos, você precisa reescrevê-los. A maneira mais fácil é usar o zfs send | zfs recv para recriar datasets, ou, se tiver espaço, mover arquivos.

No entanto, apenas com o uso natural, os metadados vão migrando conforme arquivos são modificados ou criados.

Figura: O status do pool após a configuração: A confirmação visual de que seus metadados agora vivem em um espelho de alta velocidade.

Figura: O status do pool após a configuração: A confirmação visual de que seus metadados agora vivem em um espelho de alta velocidade.

O Pulo do Gato: special_small_blocks

Se você tem espaço sobrando nos seus NVMes (e se seguiu a regra dos 0.3%, provavelmente tem), você pode ativar um recurso matador: Small Blocks.

Isso instrui o ZFS a armazenar não apenas metadados, mas também arquivos inteiros que sejam menores que um certo tamanho, diretamente no SSD.

Pense no impacto disso:

Arquivos de texto, scripts, logs.

Thumbnails de imagens.

Arquivos de save de jogos.

Código fonte (milhares de arquivos

.c,.h,.pyminúsculos).

Ao tirar esses arquivos pequenos dos HDDs, você melhora drasticamente a eficiência do armazenamento rotacional (que odeia arquivos pequenos) e ganha performance de SSD para o que mais importa na usabilidade diária.

Para ativar isso em um dataset específico (por exemplo, onde você guarda suas fotos ou código):

zfs set special_small_blocks=32K tank/meus_arquivos

Neste exemplo, qualquer arquivo menor ou igual a 32KB será gravado inteiramente no NVMe. Você pode ajustar para 64K ou 128K, dependendo do espaço disponível no seu Special VDEV.

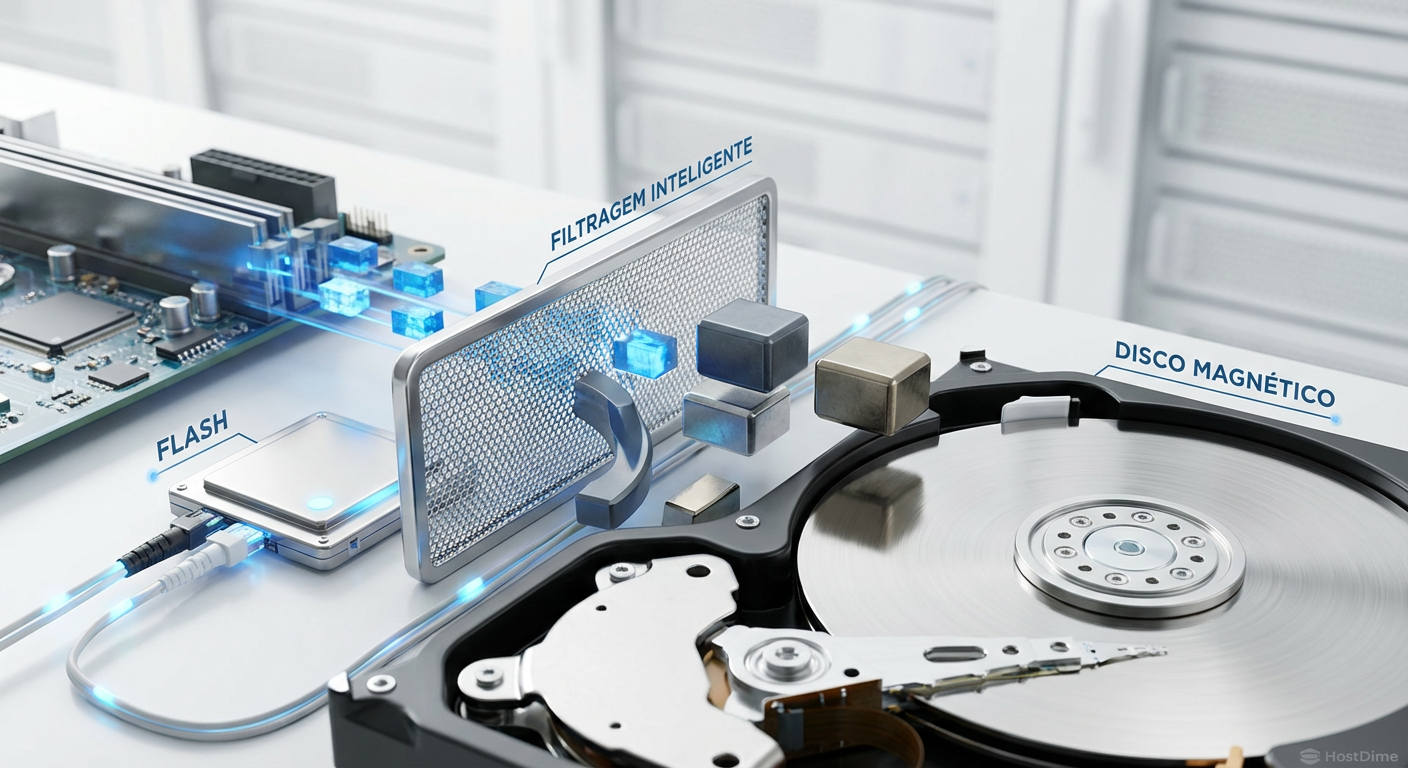

Figura: Filtragem inteligente: O parâmetro special_small_blocks agindo como uma peneira, enviando arquivos pequenos para o flash e deixando os pesados para o disco magnético.

Figura: Filtragem inteligente: O parâmetro special_small_blocks agindo como uma peneira, enviando arquivos pequenos para o flash e deixando os pesados para o disco magnético.

Validando a Performance

Não acredite apenas na minha palavra. Vamos ver os números. O comando zpool iostat é seu melhor amigo aqui.

Abra um terminal e rode:

zpool iostat -v 1

Agora, em outra janela, inicie uma operação pesada de metadados, como um find /mnt/tank -name "*.jpg".

Você verá algo lindo acontecer nas colunas de operação:

HDDs: Quase 0 IOPS de leitura. Silêncio total.

Special (NVMe): Milhares de IOPS de leitura.

O sistema está varrendo a árvore de diretórios na velocidade da luz, sem acordar os discos mecânicos. A latência percebida cai de segundos para milissegundos. É a diferença entre clicar numa pasta e esperar a ampulheta girar, versus clicar e o conteúdo explodir na tela instantaneamente.

Cenários de Falha e Transbordamento

"E se o meu SSD encher?"

Essa é a beleza da arquitetura do ZFS. Se o seu Special VDEV ficar 100% cheio, o sistema não trava. Ele simplesmente transborda (spills over) de volta para os HDDs.

Os novos metadados serão gravados nos discos lentos, como era antigamente. A performance cairá para esses novos dados, mas o sistema continua operando. Quando você liberar espaço ou substituir os SSDs por maiores (o recurso autoexpand é ótimo aqui), ele volta a usar o flash.

Tabela Comparativa: O Antes e o Depois

Para visualizar o impacto real no seu Home Lab, veja como o comportamento do storage muda:

| Característica | Apenas HDD (RAIDZ) | HDD + Special VDEV (NVMe) |

|---|---|---|

| Latência de Navegação | Alta (Barulho de busca) | Zero (Silencioso) |

| IOPS de Escrita (Pequena) | Baixo (~100-200 IOPS) | Alto (Limitado pelo NVMe) |

| Listagem de Diretórios | Lenta (Segundos) | Instantânea (Milissegundos) |

| Risco de Perda de Dados | Padrão (Falha de HDD) | Maior (Falha de NVMe derruba tudo) |

| Custo por TB | Baixo | Médio (Custo adicional dos SSDs) |

| Ruído Acústico | Alto (Seek constante) | Baixo (Apenas leitura sequencial) |

O Veredito

Adicionar um Special VDEV é, sem dúvida, o upgrade de maior impacto que você pode fazer em um servidor de arquivos ZFS existente, superando até mesmo a adição de mais RAM ou uma CPU mais nova. Ele resolve a fraqueza fundamental dos discos mecânicos sem forçar você a gastar uma fortuna em um array all-flash.

Se você tem slots M.2 ou PCIe sobrando no seu servidor e valoriza o silêncio e a responsividade, essa é a "gambiarra" técnica mais elegante que existe. Apenas lembre-se do mantra: Espelhe seus metadados ou prepare-se para chorar.

O que acontece se o SSD do Special VDEV falhar?

Se o Special VDEV falhar e não houver redundância (espelhamento), todo o pool ZFS é perdido, pois os metadados essenciais para localizar os arquivos estavam nele. Por isso, usar RAID-1 (Mirror) nos NVMes é obrigatório.Qual o tamanho ideal para o disco de metadados?

Uma regra prática comum é calcular 0.3% a 0.5% da capacidade total do pool para apenas metadados. Se você planeja usar a função de 'small blocks' para armazenar arquivos pequenos também, precisará de mais espaço.Posso remover um Special VDEV depois de adicionado?

Nas versões modernas do OpenZFS (2.0+), é possível remover um Special VDEV desde que haja espaço suficiente nos HDDs principais para realocar os dados, mas é um processo intensivo e arriscado. O ideal é planejar bem antes de implementar.

Ricardo Garcia

Especialista em Virtualização (VMware/KVM)

"Vivo na camada entre o hypervisor e o disco. Ajudo administradores a entenderem como a performance do storage define a estabilidade de datastores, snapshots e migrações críticas."