vDPA no KVM: Unindo a performance do SR-IOV com a flexibilidade do Virtio

Descubra como o vDPA resolve o dilema entre performance de hardware e mobilidade de VM. Uma análise técnica sobre offload de datapath, redução de CPU e suporte a Live Migration.

A busca pelo "santo graal" da virtualização de I/O sempre girou em torno de um dilema cruel: escolher entre o desempenho bruto do hardware ou a flexibilidade do software. Durante anos, arquitetos de infraestrutura tiveram que decidir se entregavam uma placa de rede virtual (vNIC) baseada em emulação de software para garantir recursos como o vMotion (Live Migration), ou se acoplavam a VM diretamente ao hardware via SR-IOV para obter baixa latência, sacrificando a mobilidade.

Com a chegada das interfaces de rede de 100Gbps, 200Gbps e o armazenamento NVMe over Fabrics (NVMe-oF), esse trade-off tornou-se insustentável. O processamento de pacotes por software no hypervisor (seja ESXi ou KVM) consome tantos ciclos de CPU que, ironicamente, a CPU se torna o gargalo do storage e da rede. É aqui que entra o vDPA (virtio Data Path Acceleration).

Esta tecnologia padronizada promete resolver a equação, permitindo que o datapath (o caminho dos dados) seja descarregado para o hardware, enquanto o control plane (o gerenciamento) permanece no software. Para quem gerencia datastores de alta performance e clusters densos, isso muda as regras do jogo.

Resumo em 30 segundos

- O Problema: Emular dispositivos de I/O via software (virtio tradicional) consome muita CPU do host (overhead), roubando performance das VMs em redes de alta velocidade.

- A Solução Antiga: O SR-IOV remove o overhead, mas prende a VM ao hardware físico, dificultando ou impedindo a migração ao vivo (Live Migration).

- A Revolução vDPA: O vDPA usa o driver padrão virtio no sistema convidado (Guest OS), mas processa os dados diretamente no hardware da NIC. Resultado: velocidade de hardware com capacidade de migração de software.

O custo oculto das interrupções na CPU

Quando falamos de storage moderno, especialmente arrays All-Flash ou NVMe, a latência é medida em microssegundos. No modelo tradicional de virtualização (como o virtio-net ou virtio-blk sem aceleração), cada operação de I/O gera uma interrupção que precisa ser tratada pelo hypervisor (no caso do KVM, pelo processo QEMU/vhost).

Em um cenário de 10Gbps, isso era gerenciável. Em 100Gbps, o número de pacotes por segundo (PPS) é tão alto que os núcleos da CPU do host ficam saturados apenas copiando memória e gerenciando anéis de descritores (virtqueues). Isso cria o que chamamos de "Noisy Neighbor" ao nível do kernel: o processamento de I/O de uma VM afeta a computação de outra.

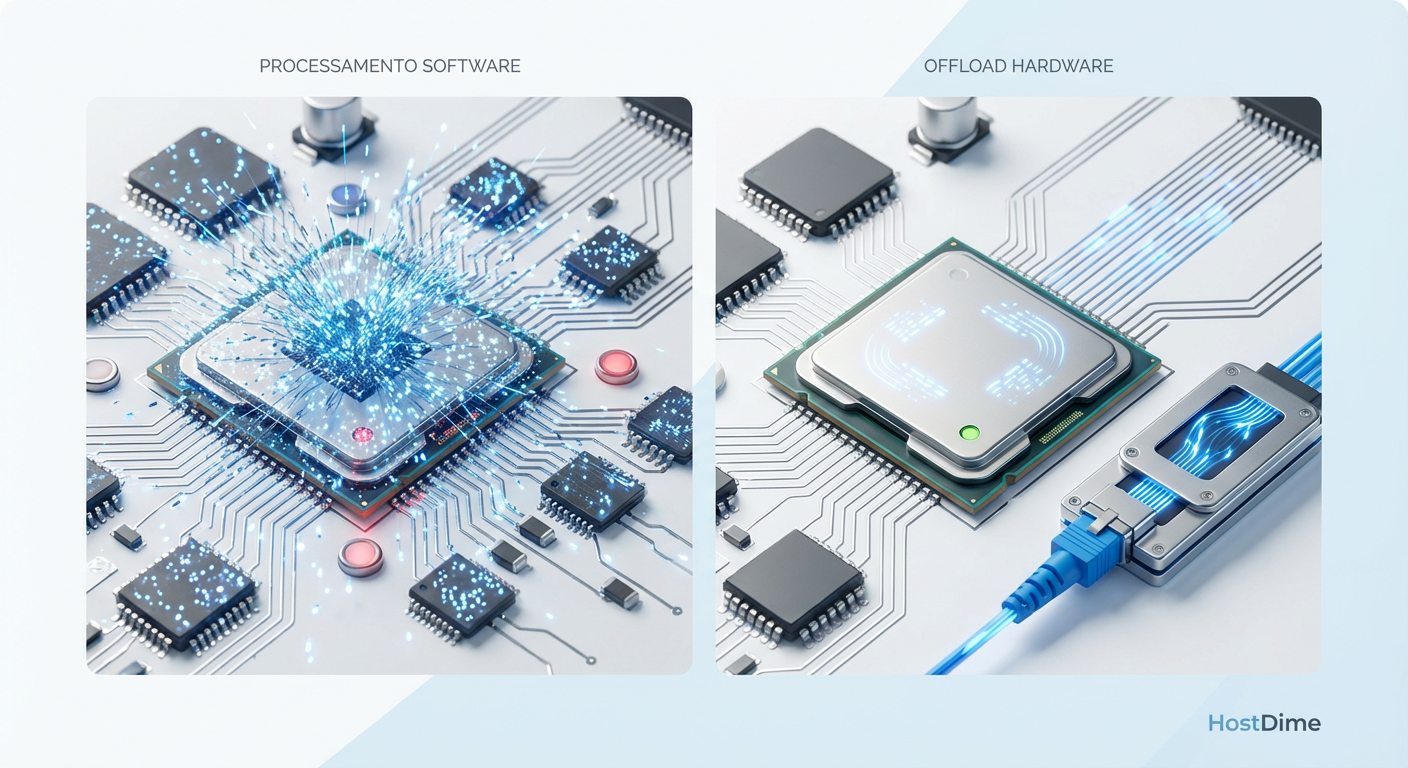

Figura: Comparação de impacto na CPU: O processamento por software satura os núcleos com interrupções, enquanto o offload de hardware libera a CPU para as aplicações.

Figura: Comparação de impacto na CPU: O processamento por software satura os núcleos com interrupções, enquanto o offload de hardware libera a CPU para as aplicações.

Para administradores de storage, isso é crítico. Se a CPU está ocupada processando pacotes de rede, ela demora mais para submeter filas de I/O para o disco. O resultado é um aumento na latência de cauda (tail latency), aquele pico de lentidão que mata a performance de bancos de dados transacionais.

A anatomia do overhead: Virtio vs. SR-IOV

Para entender onde o vDPA se encaixa, precisamos dissecar seus antecessores.

Virtio: O padrão de ouro da compatibilidade

O virtio é uma interface paravirtualizada padrão. O Guest OS "sabe" que está virtualizado e usa um driver genérico (virtio-net, virtio-scsi) para falar com o hypervisor.

Vantagem: Desacoplamento total do hardware. Você pode migrar uma VM de um servidor com placa Intel para um com placa Mellanox/NVIDIA sem mudar o driver na VM.

Desvantagem: O caminho de dados passa pelo software do host (vhost-net), exigindo cópias de memória e trocas de contexto.

SR-IOV: Velocidade pura, mas rígida

O Single Root I/O Virtualization (SR-IOV) permite que uma placa física (PF) crie múltiplas funções virtuais (VFs). A VM acessa essa VF diretamente via DMA (Direct Memory Access).

Vantagem: Zero cópia de software. Latência próxima ao bare-metal.

Desvantagem: A VM precisa de um driver específico do fabricante da placa. Além disso, o estado do dispositivo (registros, filas) reside no silício. Extrair esse estado para mover a VM para outro host é complexo e, muitas vezes, proprietário.

💡 Dica Pro: Em ambientes VMware, o SR-IOV muitas vezes desabilita o vMotion ou exige configurações de cluster idênticas e complexas. No KVM, o problema é similar: a "sujeira" na memória (dirty pages) gerada pelo DMA direto é difícil de rastrear pelo hypervisor durante a migração.

Tabela comparativa: O cenário atual

| Característica | Virtio (Software) | SR-IOV (Passthrough) | vDPA (Híbrido) |

|---|---|---|---|

| Performance | Média (Gargalo de CPU) | Alta (Line-rate) | Alta (Line-rate) |

| Uso de CPU do Host | Alto | Quase Zero | Baixo/Quase Zero |

| Driver no Guest | Padrão (virtio) | Proprietário do Vendor | Padrão (virtio) |

| Live Migration | Nativo e Simples | Complexo/Limitado | Suportado (Standard) |

| Dependência de HW | Nenhuma | Alta | Requer NIC vDPA |

Como o vDPA resolve o quebra-cabeça

O vDPA (virtio Data Path Acceleration) é uma especificação que padroniza como o hardware deve se comportar para "fingir" ser um dispositivo virtio.

A mágica acontece na separação dos planos:

Control Plane (Plano de Controle): O hypervisor (QEMU) configura o dispositivo. Ele negocia recursos, define tamanhos de fila e features. Isso é feito via software, mantendo a flexibilidade.

Data Plane (Plano de Dados): Uma vez configurado, o hypervisor sai do caminho. O driver virtio dentro da VM coloca os dados na memória, e a placa de rede (SmartNIC ou DPU) lê esses dados diretamente via DMA, seguindo o layout exato do anel virtio.

Não há tradução. A placa de rede entende nativamente o formato de dados do virtio.

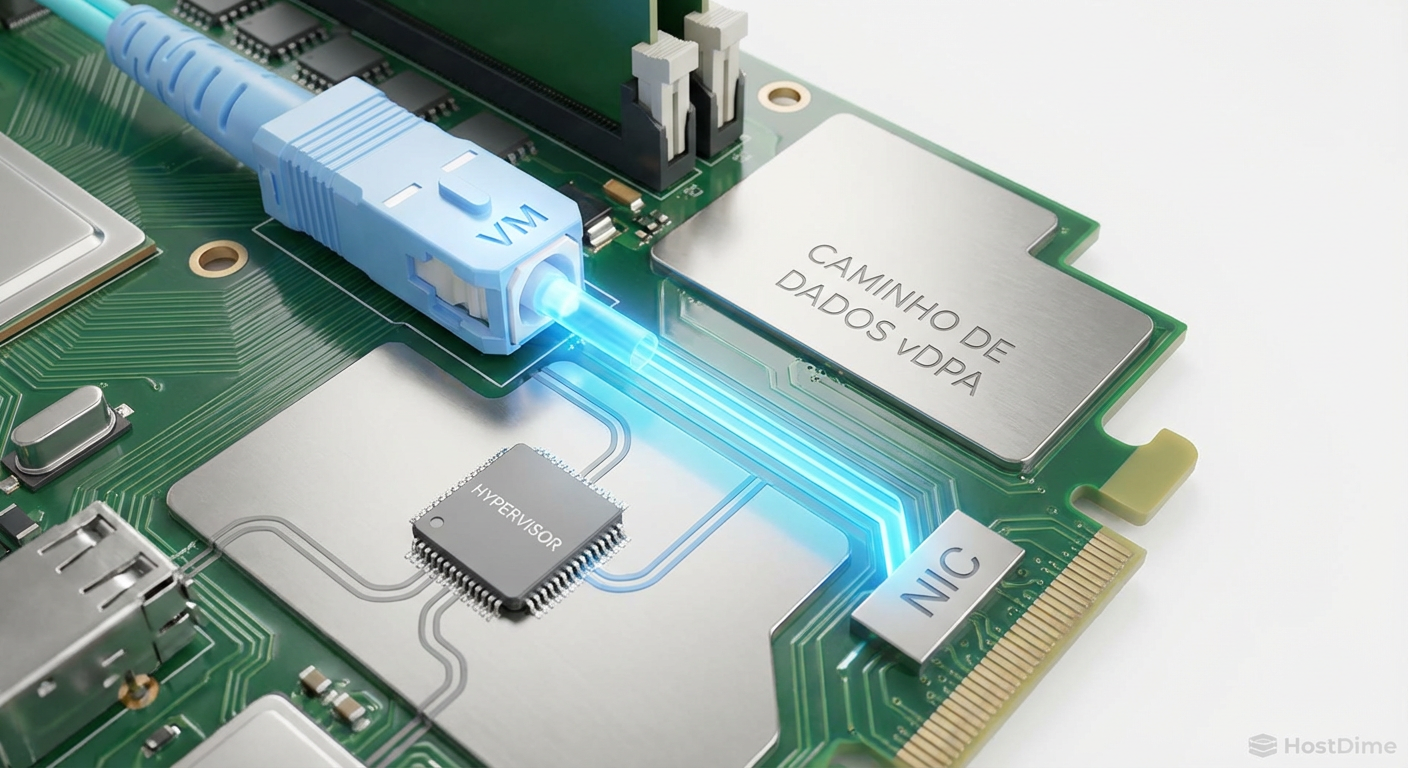

Figura: Arquitetura vDPA: O caminho de dados (Datapath) ignora o hypervisor conectando a VM diretamente à NIC, enquanto o controle permanece no software.

Figura: Arquitetura vDPA: O caminho de dados (Datapath) ignora o hypervisor conectando a VM diretamente à NIC, enquanto o controle permanece no software.

O impacto no Storage e NVMe

Embora falemos muito de rede (virtio-net), o vDPA é agnóstico ao tipo de dispositivo. Para storage, isso é revolucionário com o advento do virtio-blk vDPA.

Imagine uma VM que precisa acessar um volume em um Storage Array NVMe externo.

Com vDPA, a VM escreve no seu disco virtual (que o SO vê como um dispositivo de bloco virtio).

A SmartNIC lê esse bloco diretamente da memória da VM.

A SmartNIC encapsula isso em um pacote NVMe-over-TCP ou RoCE v2 e envia para o storage.

Tudo isso sem acordar a CPU do host.

Isso libera a CPU do servidor para rodar mais VMs ou para tarefas de computação pura, aumentando a densidade do cluster e reduzindo o TCO (Custo Total de Propriedade).

O desafio da migração ao vivo (Live Migration)

A principal razão pela qual o SR-IOV falhou em se tornar o padrão universal foi a dificuldade com o Live Migration. Para migrar uma VM ligada, precisamos saber quais páginas de memória mudaram (dirty page tracking) enquanto a cópia ocorre.

No virtio por software, o hypervisor vê todo o tráfego, então ele sabe o que mudou. No SR-IOV, o hardware escreve na memória pelas costas do hypervisor.

O vDPA resolve isso exigindo que o hardware suporte funcionalidades de rastreamento de páginas sujas. A SmartNIC reporta ao hypervisor quais endereços de memória foram modificados. Isso permite que o KVM/QEMU sincronize a memória com o host de destino, pause a VM, mova o estado interno da fila virtio (que agora é padronizado) e retome a VM no destino.

⚠️ Perigo: Nem todas as placas de rede que dizem suportar "offload" suportam vDPA completo com Live Migration. É crucial verificar a lista de compatibilidade de hardware (HCL) e se o firmware da placa suporta a exposição de dirty pages para o host.

Figura: O elo perdido do Live Migration: O hardware vDPA rastreia ativamente as páginas de memória modificadas e informa o hypervisor, permitindo a migração sem perda de dados.

Figura: O elo perdido do Live Migration: O hardware vDPA rastreia ativamente as páginas de memória modificadas e informa o hypervisor, permitindo a migração sem perda de dados.

O veredito para arquitetos de infraestrutura

O vDPA não é apenas uma melhoria incremental; é uma mudança arquitetural necessária para a era dos 100Gbps+ e do armazenamento desagregado. Ele permite que tratemos servidores x86 como plataformas de computação pura, delegando o trabalho pesado de I/O para DPUs (Data Processing Units) e SmartNICs, sem nos prendermos a drivers proprietários dentro das VMs.

Para quem desenha nuvens privadas baseadas em KVM (como OpenStack ou soluções hiperconvergentes modernas), o vDPA é o caminho para obter a performance de um appliance dedicado com a flexibilidade de uma nuvem definida por software.

Se você está planejando sua próxima atualização de hardware, placas com suporte a vDPA devem ser um requisito obrigatório, não opcional.

Referências & Leitura Complementar

OASIS Virtio Specification v1.1: Detalhes técnicos sobre o padrão de anéis virtio e mecanismos de driver.

Red Hat Developer Blog (2020-2023): Artigos técnicos sobre a implementação do vDPA no kernel Linux e QEMU (ex: "vDPA kernel framework").

NVIDIA/Mellanox ConnectX-6/7 Datasheets: Especificações de hardware que detalham o suporte a "Virtio Hardware Offload" e vDPA.

DPDK.org: Documentação sobre a integração de bibliotecas vDPA no userspace para aplicações de altíssima performance.

O vDPA exige hardware específico para funcionar?

Sim. A placa de rede (NIC) ou SmartNIC deve suportar especificamente a especificação vDPA para permitir que o datapath do virtio seja mapeado diretamente no hardware, mantendo a compatibilidade com o driver virtio padrão no sistema operacional convidado.Qual a principal vantagem do vDPA sobre o SR-IOV tradicional?

A principal vantagem é a manutenção da flexibilidade operacional. Enquanto o SR-IOV oferece performance nativa mas dificulta ou impede o Live Migration (vMotion no mundo VMware), o vDPA permite a migração ao vivo da VM, pois o control plane permanece gerenciável pelo hypervisor (QEMU/KVM).O vDPA beneficia apenas o tráfego de rede ou também storage?

Embora o caso de uso mais comum seja rede (virtio-net), o vDPA também se aplica a storage (virtio-blk/virtio-scsi). Isso permite que VMs acessem dispositivos de bloco NVMe remotos com latência próxima ao nativo, sem consumir ciclos excessivos de CPU do host para processamento de I/O.

Ricardo Garcia

Especialista em Virtualização (VMware/KVM)

"Vivo na camada entre o hypervisor e o disco. Ajudo administradores a entenderem como a performance do storage define a estabilidade de datastores, snapshots e migrações críticas."