ZFS Special VDEV: segregando metadados para salvar a performance de arrays QLC

Descubra como a Classe de Alocação Especial (Special VDEV) do OpenZFS resolve a latência de escrita aleatória em discos QLC ao segregar metadados em mídia rápida.

Você conhece a sensação. Você acabou de montar um array de armazenamento massivo com os novos SSDs QLC (Quad-Level Cell) de alta densidade. O custo por terabyte ficou incrível. A taxa de transferência sequencial é respeitável. Mas então, você digita um simples ls -la em um diretório com meio milhão de arquivos, ou inicia uma compilação de código, e o sistema engasga. O cursor pisca, zombando da sua infraestrutura "moderna".

O culpado não é a largura de banda; é a latência de metadados.

No universo do ZFS, onde a integridade é rei e tudo é uma árvore de Merkle, a manipulação de metadados é intensa. Quando combinamos essa característica arquitetural com a física dos SSDs QLC — que sacrificam a performance de escrita aleatória e a latência em prol da densidade — temos um conflito de interesses. É aqui que entra o Special VDEV, uma das funcionalidades mais elegantes e subutilizadas do OpenZFS moderno.

Resumo em 30 segundos

- O Gargalo: SSDs QLC e HDDs mecânicos sofrem terrivelmente com operações de I/O aleatórias e pequenas, típicas de metadados (atime, ctime, ponteiros de bloco).

- A Solução: O Special VDEV permite isolar fisicamente esses metadados em dispositivos de ultra-baixa latência (NVMe/Optane), deixando o armazenamento principal apenas para dados brutos sequenciais.

- O Ganho: Aceleração massiva em listagem de arquivos, scrubs (verificação de integridade) e exclusão de dados, transformando a "sensação" de uso do pool.

A Física do Conflito: Blocos de 4K vs. Páginas NAND

Para entender por que precisamos segregar metadados, precisamos olhar para o microscópio. O ZFS é um sistema de arquivos Copy-on-Write (CoW). Isso significa que ele nunca sobrescreve dados no local; ele sempre escreve em um novo bloco e atualiza os ponteiros.

Metadados são, por natureza, pequenos e fragmentados. Estamos falando de blocos de 4KB, 8KB ou 16KB espalhados pelo disco.

SSDs QLC, por outro lado, operam com páginas e blocos de apagamento (erase blocks) muito maiores para manter a densidade. Quando você força um drive QLC a lidar com milhares de pequenas escritas de metadados, você dispara um fenômeno brutal de Write Amplification (Amplificação de Escrita). O controlador do SSD precisa ler blocos gigantes, modificar uma pequena parte e reescrever tudo. Isso satura o buffer DRAM do SSD e a latência dispara de microssegundos para milissegundos — uma eternidade em tempo de CPU.

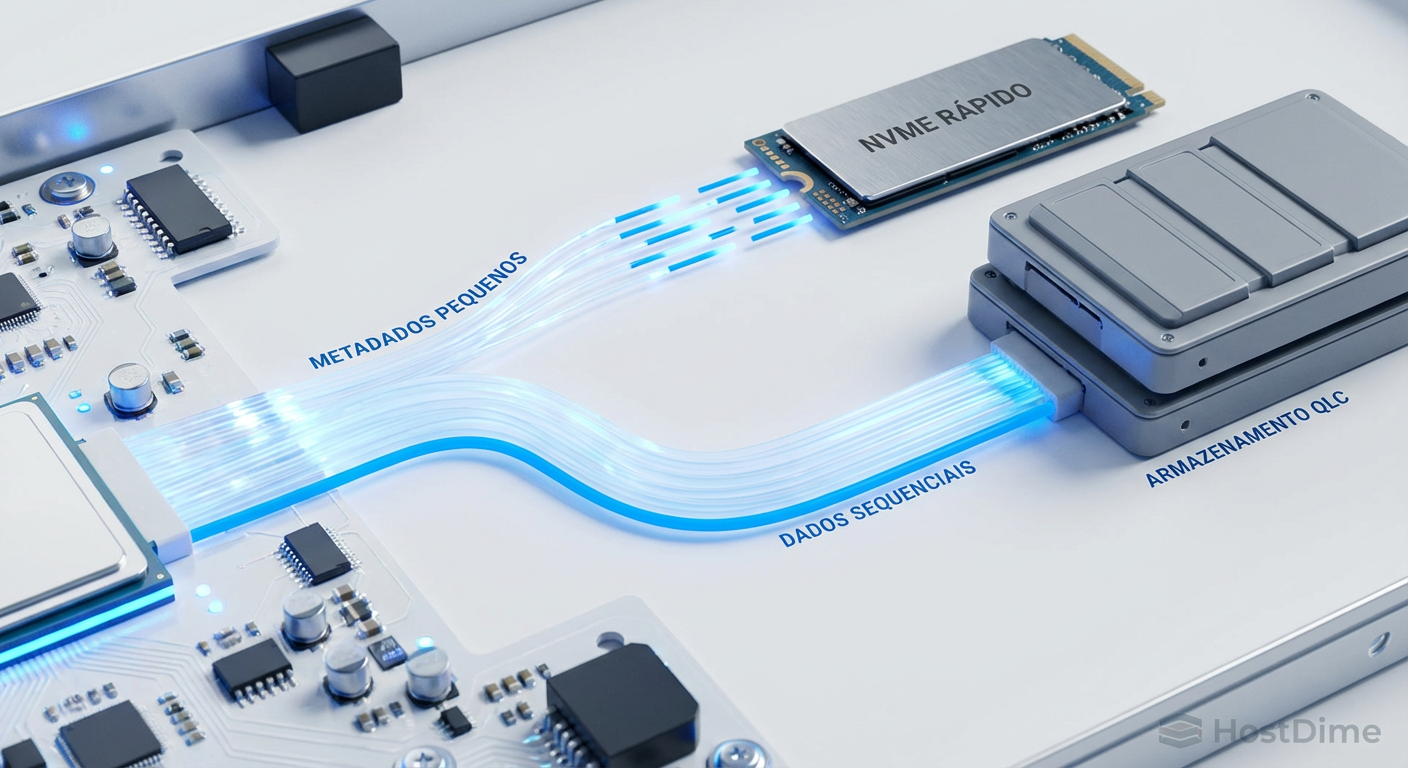

Figura: O fluxo de dados segregado: metadados pequenos e aleatórios fluem para o NVMe rápido, enquanto grandes blocos de dados sequenciais vão para o armazenamento de capacidade QLC.

Figura: O fluxo de dados segregado: metadados pequenos e aleatórios fluem para o NVMe rápido, enquanto grandes blocos de dados sequenciais vão para o armazenamento de capacidade QLC.

Por que L2ARC e SLOG não resolvem este problema

É comum confundir o Special VDEV com mecanismos de cache já existentes no ZFS. Vamos dissipar essa névoa agora.

SLOG (Separate ZFS Intent Log): O SLOG serve apenas para acelerar escritas síncronas (como NFS ou bancos de dados). Ele não armazena dados permanentemente e não ajuda em nada na leitura de metadados ou na listagem de diretórios.

L2ARC (Level 2 Adaptive Replacement Cache): Este é um cache de leitura. Embora possa armazenar metadados, ele é volátil e baseado em "despejo" (eviction). Se os metadados esfriarem, eles somem do L2ARC. Além disso, o L2ARC consome RAM para indexar a si mesmo, o que pode ser contraproducente em sistemas com memória limitada.

O Special VDEV é diferente. Ele não é um cache. Ele é o local de armazenamento primário e definitivo para os tipos de dados que você selecionar. Se você diz ao ZFS para colocar metadados no Special VDEV, eles viverão lá permanentemente.

Tabela Comparativa: Onde colocar seu NVMe?

| Recurso | Função Primária | Persistência | Impacto em Metadados | Risco de Perda do Pool |

|---|---|---|---|---|

| SLOG | Acelerar Writes Síncronos | Temporária (apenas ZIL) | Nulo (para leituras) | Nenhum (perde apenas dados em voo) |

| L2ARC | Estender Cache de Leitura | Volátil (Cache) | Médio (se estiver "quente") | Nenhum |

| Special VDEV | Armazenamento Estrutural | Permanente | Alto (Leitura e Escrita) | Crítico (Pool falha se VDEV falhar) |

A Arquitetura da Classe de Alocação Especial

Introduzido no OpenZFS 0.8, o recurso de Allocation Classes permite criar VDEVs dedicados a tipos específicos de blocos. Ao adicionar um VDEV special ao seu pool, o ZFS altera seu algoritmo de alocação de blocos (o SPA - Storage Pool Allocator).

Antes de escrever qualquer dado, o ZFS verifica:

Este bloco é um metadado (DDT, mapas de espaço, nós de diretório)?

Este bloco é um dado de usuário pequeno (menor que o limite definido)?

Se a resposta for sim, o bloco é desviado para o dispositivo rápido. O resultado é que os discos rotacionais (HDDs) ou SSDs QLC ficam livres para fazer o que fazem de melhor: ler e escrever grandes sequências contínuas de dados.

💡 Dica Pro: O Special VDEV também armazena a Tabela de Deduplicação (DDT). Se você for corajoso o suficiente para usar deduplicação no ZFS (geralmente não recomendado sem muita RAM), um Special VDEV é obrigatório para evitar que a performance caia para zero.

Figura: A árvore de Merkle do ZFS dividida fisicamente: a estrutura vital (metadados) reside em mídia rápida, enquanto as folhas da árvore (dados) residem em mídia de capacidade.

Figura: A árvore de Merkle do ZFS dividida fisicamente: a estrutura vital (metadados) reside em mídia rápida, enquanto as folhas da árvore (dados) residem em mídia de capacidade.

Dimensionamento e Configuração: A Regra dos 0,3%

Uma das perguntas mais frequentes é: "Qual o tamanho que meu Special VDEV precisa ter?".

Para apenas metadados, a regra empírica da comunidade OpenZFS é de 0,3% a 0,5% da capacidade total do pool. Ou seja, para um pool de 100TB, você precisaria de apenas 300GB a 500GB de armazenamento especial. Isso é incrivelmente eficiente.

No entanto, a mágica real acontece quando usamos o parâmetro special_small_blocks.

Otimização Fina com special_small_blocks

Você pode instruir o ZFS a armazenar não apenas metadados, mas também arquivos inteiros pequenos no Special VDEV. Pense em arquivos de log, thumbnails, códigos-fonte ou documentos de texto.

# Exemplo de configuração em um dataset

zfs set special_small_blocks=32K tank/vm-storage

Neste exemplo, qualquer arquivo (ou bloco de registro) igual ou menor que 32KB será gravado inteiramente no NVMe. Isso remove o I/O "sujo" e aleatório dos discos principais.

Se você ativar essa funcionalidade, o dimensionamento do Special VDEV deve aumentar. Recomendo planejar entre 1% a 3% da capacidade total do pool, dependendo da natureza dos seus dados.

⚠️ Perigo: Nunca defina

special_small_blockspara um valor maior que orecordsizedo seu dataset, ou você encherá seu NVMe com dados que deveriam estar nos discos de capacidade.

Riscos de Redundância: O Calcanhar de Aquiles

Aqui é onde muitos administradores falham. Como o Special VDEV contém os metadados que mapeiam onde todos os seus dados estão, se você perder o Special VDEV, você perde todo o pool. Não há recuperação. É catastrófico.

Portanto, a regra de ouro é: A redundância do Special VDEV deve igualar ou exceder a redundância do pool de dados.

Se o seu pool é um RAIDZ2 (tolera falha de 2 discos), seu Special VDEV deve ser, no mínimo, um espelho triplo (3-way Mirror).

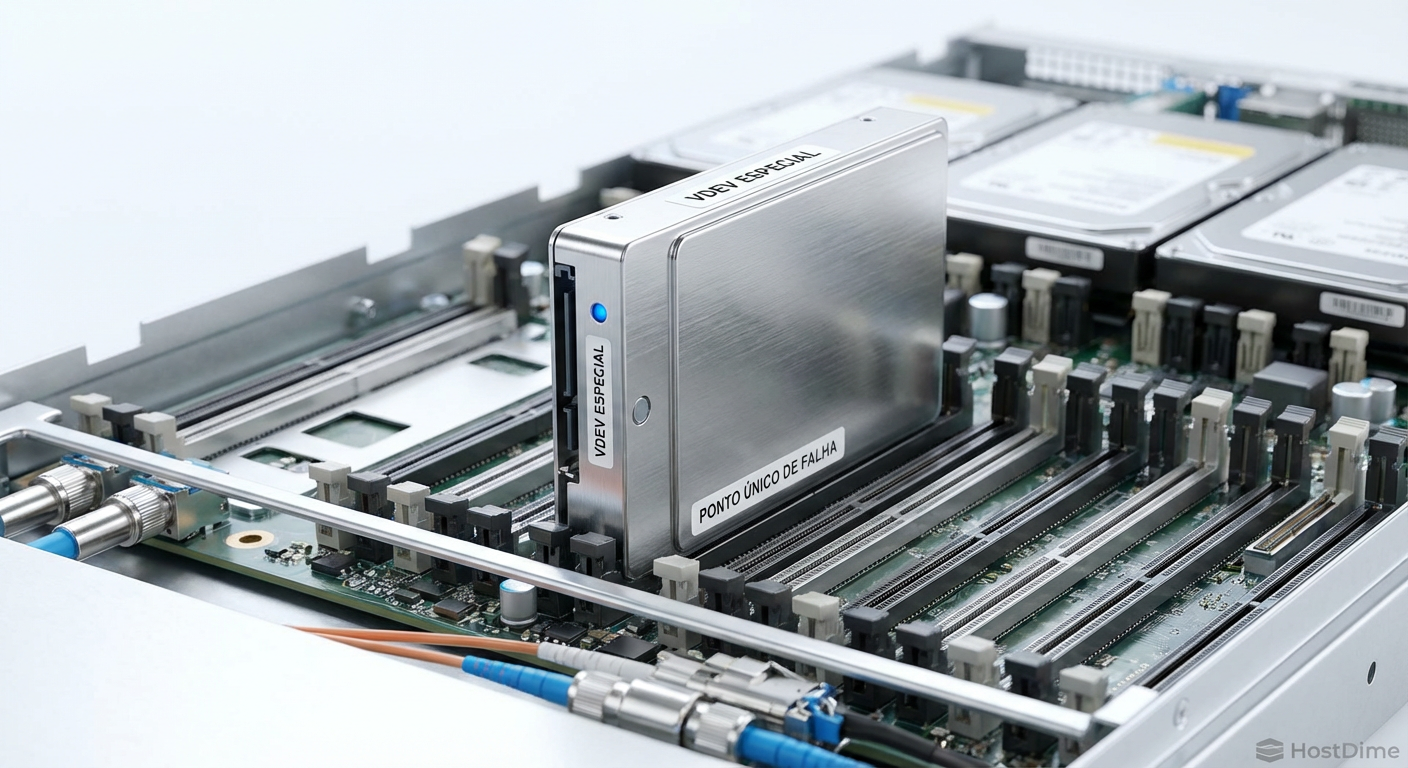

Nunca, jamais, adicione um único SSD como Special VDEV em um pool de produção. Isso cria um ponto único de falha (SPOF) imediato.

Figura: O risco crítico: um Special VDEV sem redundância é um ponto único de falha que pode derrubar todo o array de armazenamento.

Figura: O risco crítico: um Special VDEV sem redundância é um ponto único de falha que pode derrubar todo o array de armazenamento.

Interpretando a Telemetria

Após implementar a segregação, você não precisa "achar" que está funcionando. O ZFS lhe diz. O comando zpool iostat -v é seu melhor amigo aqui.

Observe a saída (simplificada) abaixo:

capacity operations bandwidth

pool alloc free read write read write

---------- ----- ----- ----- ----- ----- -----

tank 40.5T 60.0T 450 120 500M 100M

raidz2 40.2T 59.8T 50 80 495M 95M

special 300G 700G 400 40 5M 5M

mirror 300G 700G 400 40 5M 5M

Note a disparidade nas operações (IOPS). O VDEV special está lidando com 400 leituras por segundo, enquanto o raidz2 (seus discos lentos) lida com apenas 50. No entanto, a largura de banda (bandwidth) está concentrada no RAIDZ2.

Isso é o nirvana do armazenamento: os discos rápidos fazem o trabalho pesado de busca e localização, e os discos lentos apenas entregam o fluxo de dados.

O Veredito

A era dos arrays puramente mecânicos ou puramente QLC sem assistência acabou para cargas de trabalho sérias. O custo dos SSDs NVMe de classe empresarial (como a série Optane ou drives NVMe de alta resistência) caiu o suficiente para tornar o Special VDEV não apenas viável, mas economicamente inteligente.

Ao gastar uma fração do orçamento em 1% de armazenamento flash de alta qualidade, você "salva" a performance dos outros 99% de armazenamento barato. Se você gerencia servidores de arquivos, alvos de backup ou virtualização sobre ZFS, ignorar o Special VDEV é deixar performance na mesa.

Planeje sua redundância, calcule seus 0,3% e pare de esperar pelo ls -la.

Referências & Leitura Complementar

OpenZFS Documentation - Allocation Classes / Special VDEVs. Disponível no repositório oficial do OpenZFS no GitHub.

Jude, J. & Lucas, M. W. (2020). FreeBSD Mastery: Advanced ZFS. Tilted Windmill Press. (A bíblia moderna para administradores ZFS).

Ars Technica (2020). ZFS 0.8’s special allocation class: What is it and why should you care? Artigo técnico detalhando benchmarks de metadados.

Perguntas Frequentes (FAQ)

Qual o tamanho ideal para um Special VDEV?

Uma regra prática conservadora é calcular 0,3% da capacidade total do pool para metadados puros. Se você planeja usar a função 'small blocks' para armazenar arquivos pequenos inteiros no dispositivo rápido, esse cálculo deve subir para 1% a 3%, dependendo do perfil dos dados (quantidade de arquivos pequenos vs. grandes).Posso remover um dispositivo Special VDEV de um pool existente?

Geralmente não. Diferente de um L2ARC ou SLOG, o Special VDEV contém dados estruturais vitais e permanentes do sistema de arquivos. A perda desse VDEV significa a perda de todo o pool. Embora versões mais recentes do OpenZFS permitam a evacuação de VDEVs de topo em certas condições (se houver espaço nos outros VDEVs), é uma operação arriscada e nem sempre suportada em todas as topologias (especialmente RAIDZ). Assuma que é permanente.O Special VDEV melhora a velocidade de scrub?

Sim, drasticamente. O processo de *scrub* (varredura de integridade) exige percorrer toda a árvore de metadados para verificar os checksums dos blocos. Ter essa estrutura em um NVMe de baixa latência, em vez de HDDs ou SSDs QLC lentos, acelera significativamente o processo de varredura e resilvering (reconstrução), reduzindo a janela de vulnerabilidade do array.

Roberto Holanda

Guru de Sistemas de Arquivos (ZFS/Btrfs)

"Dedico minha carreira à integridade dos dados. Para mim, o bit rot é o inimigo e o Copy-on-Write é a salvação. Exploro a fundo ZFS, Btrfs e a beleza dos checksums."