ZFS Special VDEVs: Acelerando storage híbrido com offload de metadados

Descubra como os Special VDEVs do ZFS eliminam o gargalo de IOPS em discos rotacionais, segregando metadados e pequenos blocos em flash para performance extrema.

Se você administra pools ZFS compostos por discos mecânicos (HDDs), já sentiu a dor. O throughput sequencial é excelente — afinal, a densidade de área dos pratos magnéticos modernos é uma maravilha da engenharia. Mas existe um assassino silencioso de performance que nenhum número de RPMs consegue resolver: a latência de busca (seek latency) ao caminhar pela árvore de metadados.

O ZFS não é apenas um sistema de arquivos; é um grafo de objetos transacional. Cada leitura de dados requer a travessia de uma estrutura de ponteiros (árvore de Merkle). Quando essa estrutura reside em discos que precisam mover fisicamente um braço mecânico para encontrar um bloco de 4KB, a performance de IOPS (Input/Output Operations Per Second) despenca para níveis glaciais.

É aqui que entram os Special VDEVs (Allocation Classes). Introduzidos no OpenZFS 0.8, eles permitem que você diga ao sistema de arquivos: "Coloque os dados pesados nos discos baratos, mas mantenha o mapa do tesouro no flash ultrarrápido".

Resumo em 30 segundos

- O Problema: Em pools de HDD, a leitura de metadados (ponteiros, atributos) exige movimentos mecânicos lentos, matando a performance de IOPS randômicos.

- A Solução: Special VDEVs são dispositivos dedicados (SSDs/NVMe) onde o ZFS armazena fisicamente todos os metadados e, opcionalmente, blocos de dados pequenos.

- O Risco: Diferente do cache (L2ARC), o Special VDEV contém dados primários. Se ele falhar sem redundância, você perde o pool inteiro.

A física cruel dos cabeçotes mecânicos

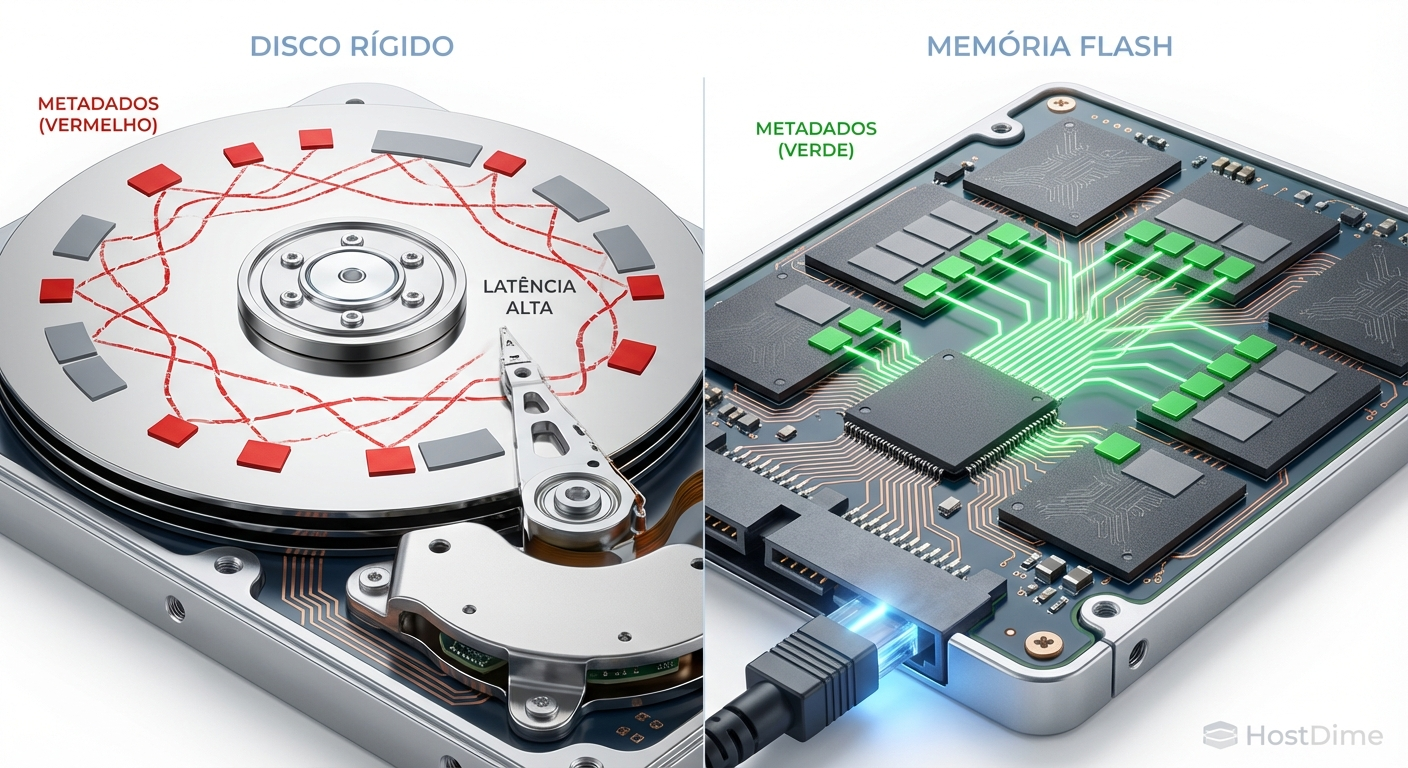

Para entender por que precisamos de VDEVs especiais, precisamos dissecar a anatomia de uma leitura no ZFS. O ZFS garante a integridade através de uma árvore de Merkle. O bloco de dados que você quer ler é apontado por um bloco indireto, que é apontado por outro bloco indireto, até chegar ao uberblock.

Em um cenário de "cold storage" ou acesso aleatório, cada um desses saltos na árvore pode exigir um seek físico no disco. Um HDD moderno de 7200 RPM consegue entregar, com sorte, 120 a 150 IOPS. Se você precisa de 3 operações de metadados para ler 1 arquivo, sua performance efetiva é dividida por três.

Figura: A tirania da física: A fragmentação de metadados em discos rotativos cria um gargalo mecânico insuperável, enquanto o flash oferece acesso quase instantâneo à estrutura da árvore.

Figura: A tirania da física: A fragmentação de metadados em discos rotativos cria um gargalo mecânico insuperável, enquanto o flash oferece acesso quase instantâneo à estrutura da árvore.

Quando você tem milhões de arquivos, operações simples como um zfs scrub, find ou ls -R tornam-se torturantes. O disco passa mais tempo movendo o cabeçote do que lendo dados.

A ilusão do cache: Por que o L2ARC não resolve?

Muitos administradores tentam resolver isso adicionando um L2ARC (Level 2 Adaptive Replacement Cache) em um SSD. Embora ajude, o L2ARC tem limitações fundamentais:

É volátil e precisa de "aquecimento": Ao reiniciar o servidor, o cache esvazia (a menos que use a flag

l2arc_rebuild_enabled, que ainda assim leva tempo para repopular e indexar).Consome RAM: Para indexar o que está no L2ARC, o ZFS gasta memória RAM preciosa na ARC principal. Um L2ARC muito grande pode, ironicamente, reduzir a performance ao canibalizar a RAM disponível para metadados quentes.

É probabilístico: O dado só vai para o cache depois de ser lido ou escrito frequentemente. O Special VDEV é determinístico.

Com um Special VDEV, os metadados vivem no SSD. Não é uma cópia; é o endereço residencial deles. A latência de acesso aos metadados torna-se consistentemente a latência do flash (microssegundos), não a do disco (milissegundos).

Implementando a Classe de Alocação Especial

A magia acontece quando adicionamos um vdev do tipo special ao pool. A partir desse momento, o ZFS redireciona automaticamente todas as alocações de metadados (nível 0 e indiretos), tabelas de deduplicação (DDT) e, se configurado, pequenos blocos de dados para esses dispositivos.

A anatomia do comando

# Exemplo de criação de um pool híbrido com proteção

zpool create tank \

raidz2 /dev/sda /dev/sdb /dev/sdc /dev/sdd /dev/sde /dev/sdf \

special mirror /dev/nvme0n1 /dev/nvme1n1

Se o pool já existe, a adição é similar a adicionar um log ou cache, mas com implicações de permanência muito maiores:

zpool add tank special mirror /dev/nvme0n1 /dev/nvme1n1

⚠️ Perigo Crítico: Nunca adicione um Special VDEV como um dispositivo único (stripe) em um pool de produção. Se o dispositivo

specialfalhar, todo o pool é perdido. Os metadados são a estrutura que mantém seus dados coesos. Sempre use espelhamento (Mirror) de 2 ou 3 vias para essa classe.

Tabela Comparativa: Onde seus dados vivem

Para situar a tecnologia no ecossistema ZFS, veja como ela se compara aos outros aceleradores:

| Característica | SLOG (ZIL) | L2ARC (Cache) | Special VDEV |

|---|---|---|---|

| Função Primária | Buffer de escritas síncronas (segurança) | Cache de leitura estendido | Armazenamento primário de metadados/dados pequenos |

| Persistência | Temporária (até o flush para o disco) | Cópia descartável | Permanente e Vital |

| Impacto na Falha | Perda de dados em voo (se crashar) | Nenhum (perda de performance apenas) | Perda total do Pool |

| Tipo de Mídia Ideal | Optane / NVMe de altíssima durabilidade (DWPD) | SSD SATA/NVMe de leitura intensiva | NVMe/SSD com boa redundância |

| Benefício Principal | Latência de escrita síncrona (NFS/iSCSI) | Taxa de acerto de leitura em working sets grandes | Aceleração geral de IOPS, Scrub e Listagem |

O segredo dos "Small Blocks"

Aqui reside o verdadeiro poder para cargas de trabalho como servidores de e-mail, bancos de dados, compilação de código ou diretórios com milhões de imagens pequenas.

Discos mecânicos odeiam arquivos pequenos. O tempo para posicionar a cabeça e ler 4KB é quase o mesmo para ler 1MB. O desperdício de tempo em IOPS é colossal.

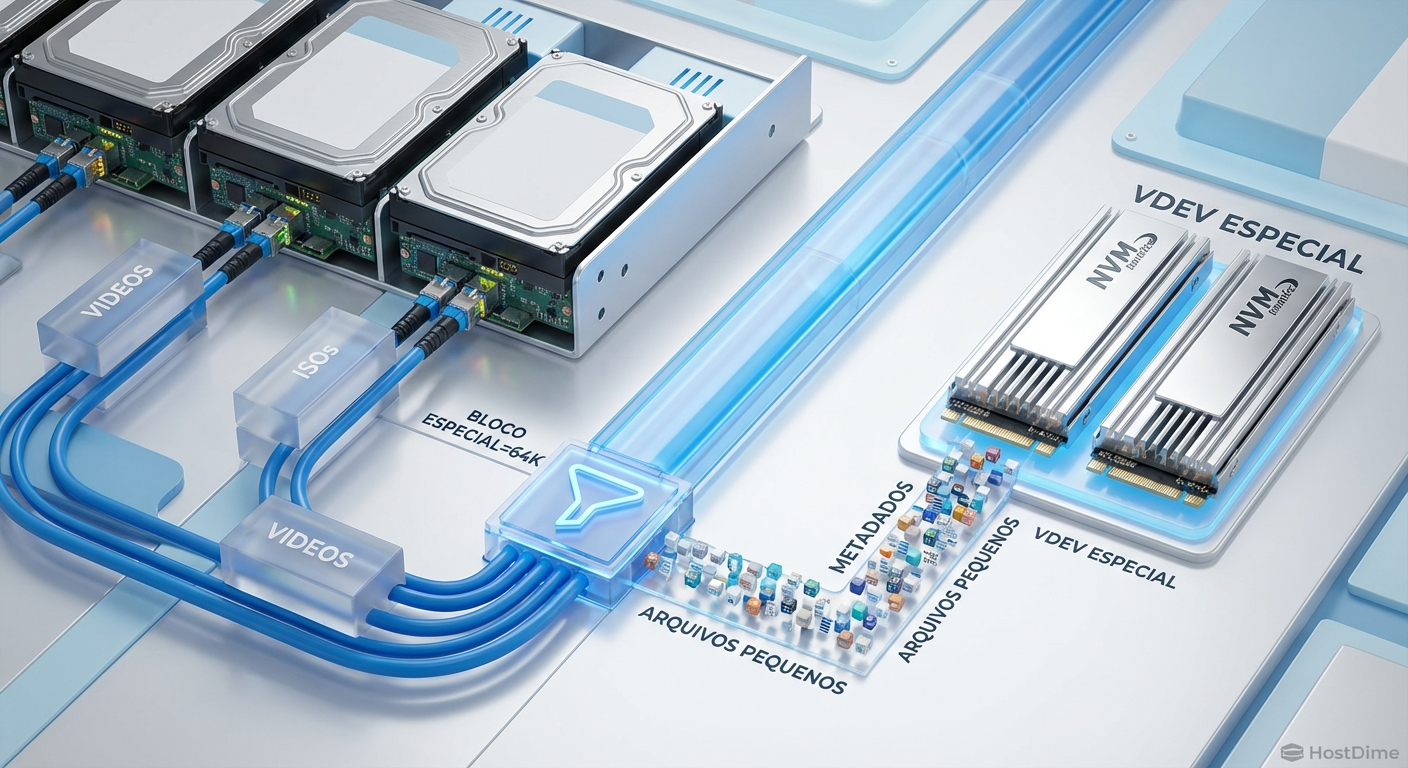

O ZFS permite configurar a propriedade special_small_blocks. Isso instrui o alocador a desviar qualquer arquivo igual ou menor que o tamanho especificado para o SSD do Special VDEV.

# Enviar qualquer arquivo de 64K ou menor para o SSD

zfs set special_small_blocks=64K tank/dataset_imagens

Isso cria um sistema de armazenamento híbrido verdadeiro. Seus arquivos de vídeo de 10GB vão para os HDDs baratos (onde o streaming é eficiente). Seus arquivos .conf, logs pequenos e thumbnails vão para o NVMe.

Figura: Segregação inteligente: O parâmetro special_small_blocks atua como uma peneira, garantindo que o IO randômico pesado de arquivos pequenos nunca toque nos discos mecânicos lentos.

Figura: Segregação inteligente: O parâmetro special_small_blocks atua como uma peneira, garantindo que o IO randômico pesado de arquivos pequenos nunca toque nos discos mecânicos lentos.

💡 Dica Pro: O tamanho do

recordsizedo seu dataset influencia essa decisão. Se o seurecordsizeé 128K (padrão) e você definespecial_small_blocks=128K, você está efetivamente movendo todos os metadados e todos os registros de dados normais para o SSD, transformando seus HDDs em meros repositórios de arquivos grandes sequenciais. Use com sabedoria para não lotar o SSD.

Dimensionamento e Planejamento de Capacidade

A pergunta de um milhão de dólares é: "Qual o tamanho do SSD que eu preciso?"

Se você usar o Special VDEV apenas para metadados, a regra empírica da indústria é de 0,3% a 0,5% da capacidade total do pool.

- Exemplo: Para um pool de 100TB, você precisaria de ~300GB a 500GB de espelhamento para metadados.

Se você ativar o offload de pequenos blocos, o cálculo muda drasticamente e depende do perfil dos seus dados (histograma de tamanho de arquivos).

- Ferramenta útil: Use

zdb -Lbbbs poolnamepara analisar a distribuição de blocos atuais e estimar quanto espaço blocos menores que X ocupam.

O que acontece se o Special VDEV encher?

O ZFS é inteligente. Se a classe especial ficar cheia, as novas alocações de metadados ou pequenos blocos "transbordam" (spill over) de volta para os discos normais (HDDs). O sistema não para, mas a performance desses novos dados cairá para a velocidade dos discos rotativos.

Evidências de Performance: Onde a diferença brilha

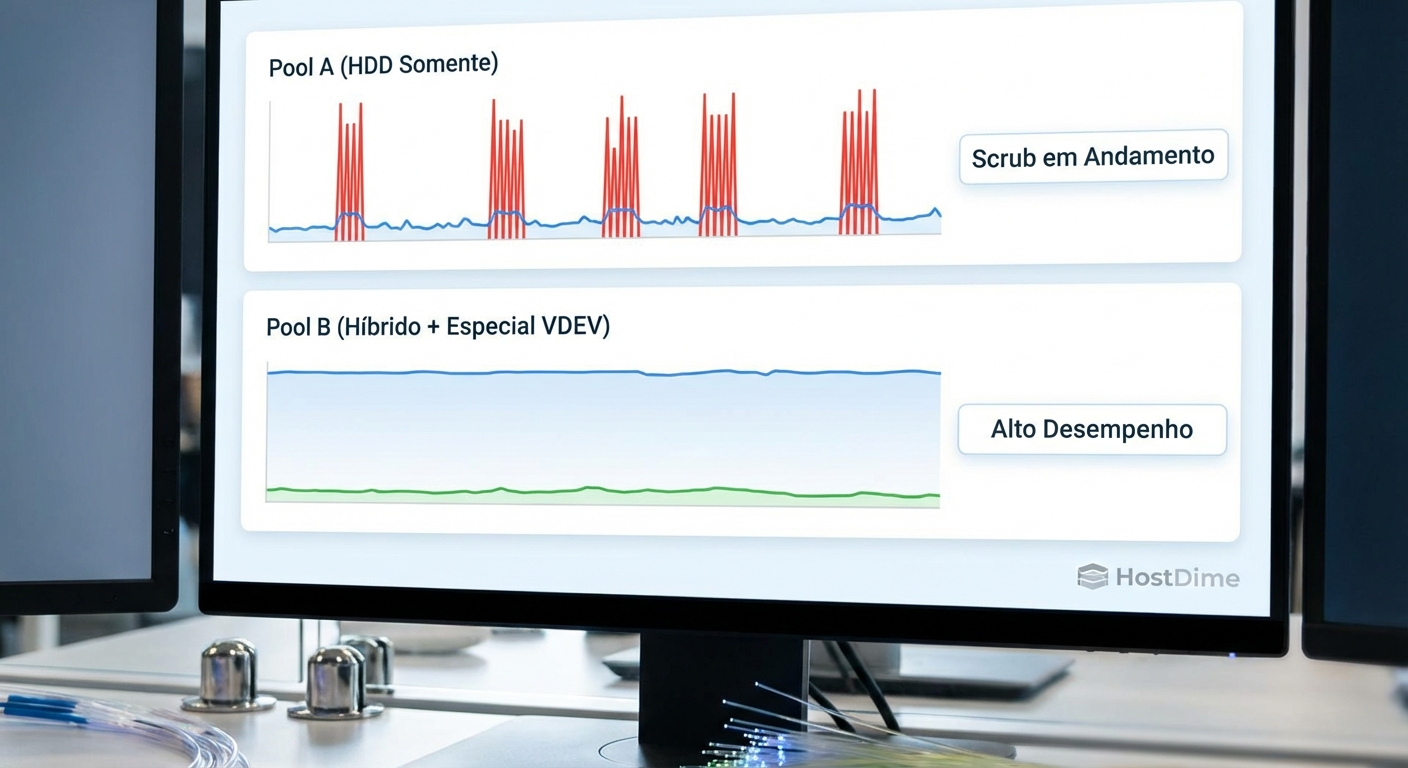

A melhoria não é sutil; é transformadora.

Scrubs e Resilvering: Como o ZFS precisa percorrer a árvore de metadados para verificar checksums, ter essa árvore em flash acelera o processo de scrub massivamente. Relatos de scrubs que levavam 48 horas caindo para 4 horas são comuns.

Listagem de Diretórios: Um

ls -laem um diretório com 100.000 arquivos em HDDs pode levar minutos. Com metadados em NVMe, é quase instantâneo.Exclusão em Massa: Apagar milhões de arquivos é uma operação intensiva de metadados. O Special VDEV digere isso sem suar.

Figura: O impacto visual da latência: A diferença brutal no tempo de resposta e vazão de operações de manutenção quando os metadados são desacoplados da mídia rotativa.

Figura: O impacto visual da latência: A diferença brutal no tempo de resposta e vazão de operações de manutenção quando os metadados são desacoplados da mídia rotativa.

Riscos de Redundância e a Regra de Ouro

Repetirei porque é vital: O Special VDEV é um ponto único de falha para o pool se não for redundante.

Diferente de um cache L2ARC, que se o SSD morrer o ZFS apenas ignora e lê do disco, o Special VDEV contém a única cópia dos ponteiros que dizem onde seus dados estão. Perdeu o ponteiro, perdeu o dado.

Recomendações de Hardware:

Endurance (DWPD): Metadados sofrem muitas escritas pequenas. Use SSDs de classe Enterprise (Mixed Use ou Write Intensive). Evite QLCs de consumo a todo custo.

Power Loss Protection (PLP): Essencial. Se o SSD mentir que gravou um metadado e houver queda de energia, você pode corromper o pool de forma irrecuperável.

Interface: NVMe é preferível a SATA/SAS devido à latência menor e filas de comando mais profundas, essenciais para o paralelismo do ZFS.

O Veredito do Engenheiro

A introdução dos Special VDEVs foi o maior salto de performance para o ZFS na última década. Ela permite construir storages economicamente viáveis (usando HDDs baratos para volume) com características de performance que rivalizam com arrays All-Flash para o usuário final, desde que o working set de metadados caiba no flash.

Não é uma tecnologia para ser ativada cegamente. Exige planejamento de capacidade e respeito rigoroso à redundância. Mas, uma vez implementada corretamente, a sensação de "lentidão" típica de pools grandes de discos mecânicos desaparece, revelando a verdadeira eficiência da arquitetura do ZFS.

Referências & Leitura Complementar

OpenZFS Documentation: Allocation Classes / Special VDEVs Feature Description.

Jude, J. & Lucas, M. W. (2020). FreeBSD Mastery: ZFS. Tilted Windmill Press. (Capítulo sobre Allocation Classes).

Arpaci-Dusseau, R. & Arpaci-Dusseau, A. Operating Systems: Three Easy Pieces (Capítulo sobre Log-Structured File Systems e Metadata).

Klara Systems Technical Blog: ZFS Allocation Classes: Past, Present, and Future.

Perguntas Frequentes (FAQ)

Qual a diferença entre SLOG (ZIL) e Special VDEV?

O SLOG é um buffer temporário de escrita apenas para garantir a integridade de escritas síncronas antes de irem para o disco lento. O Special VDEV é um armazenamento permanente onde residem os metadados (e opcionalmente dados pequenos), acelerando tanto a leitura quanto a escrita de operações randômicas.Posso remover um Special VDEV de um pool existente?

Geralmente não. Diferente de um L2ARC ou SLOG, o Special VDEV contém dados primários vitais. Se ele falhar sem redundância, você perde todo o pool. A remoção só é possível em cenários muito específicos de evacuação de vdev (zpool remove), mas isso depende da topologia e versão do ZFS. O planejamento de capacidade é crítico.Quanto espaço devo alocar para a classe especial?

Uma regra prática comum é calcular 0,3% da capacidade total do pool apenas para metadados. Se você planeja usar a função 'small blocks' para armazenar arquivos pequenos inteiros no flash, esse cálculo deve subir drasticamente baseando-se no perfil dos seus dados (ex: 3% a 5% ou mais).

Roberto Holanda

Guru de Sistemas de Arquivos (ZFS/Btrfs)

"Dedico minha carreira à integridade dos dados. Para mim, o bit rot é o inimigo e o Copy-on-Write é a salvação. Exploro a fundo ZFS, Btrfs e a beleza dos checksums."