NVMe FDP: o fim da latência de cauda em bancos de dados de alta concorrência

Entenda como o Flexible Data Placement (FDP) do NVMe isola workloads no nível do NAND, reduz o WAF e estabiliza o QoS sem a complexidade do ZNS.

Você já passou por isso. Seu array all-flash NVMe Gen4 ou Gen5 entrega milhões de IOPS no papel. O throughput é insano. Mas, inexplicavelmente, a cada 15 ou 20 minutos, sua aplicação crítica sofre um "engasgo". Uma query que deveria levar 200 microssegundos leva 50 milissegundos. O SLA de latência p99 (ou p9999) vai para o espaço, e o telefone toca.

Não é culpa do banco de dados. Não é culpa da rede. O problema está na física do silício e na "faxina" interna que seu SSD decide fazer no pior momento possível.

Vamos falar sobre como o NVMe Flexible Data Placement (FDP), ratificado na especificação TP4146, resolve o problema fundamental da amplificação de escrita e da latência de cauda sem a complexidade insana do ZNS (Zoned Namespaces). Se você gerencia workloads de alta concorrência, como RocksDB, MySQL ou bancos NoSQL pesados, precisa entender isso agora.

Resumo em 30 segundos

- O Problema: SSDs misturam dados de vida curta (logs) e longa (tabelas) nos mesmos blocos físicos, forçando o Garbage Collection a mover dados válidos inutilmente, gerando picos de latência.

- A Solução FDP: Permite que o host (banco de dados) marque os dados com "Placement IDs", orientando o SSD a gravar tipos de dados diferentes em superblocos físicos separados.

- O Resultado: O WAF (Write Amplification Factor) cai para próximo de 1, a vida útil do disco aumenta e, crucialmente, a latência de cauda se estabiliza.

O mistério dos picos de latência em arrays all-flash

Para entender o FDP, precisamos revisitar a mentira que o SSD conta para o Sistema Operacional. O SO acha que está escrevendo em um endereço lógico (LBA) específico e que esse dado fica lá. Na realidade, o controlador do SSD espalha esses dados por diversos chips NAND para garantir paralelismo e velocidade.

O problema surge quando misturamos padrões de acesso. Em um banco de dados típico, temos:

WAL (Write Ahead Log): Escrita sequencial, vida curtíssima (sobrescrito ou deletado rapidamente).

Data Files/SSTables: Escrita aleatória ou sequencial, vida longa (leitura frequente, atualização esporádica).

TempDB: Vida efêmera.

Em um SSD convencional, esses dados acabam fisicamente vizinhos no mesmo bloco de apagamento (erase block). Quando o WAL é deletado, ele deixa "buracos" de espaço inválido no bloco. Mas o bloco também contém pedaços de uma tabela importante que não foi deletada.

Para recuperar esse espaço livre, o SSD precisa executar o Garbage Collection (GC): ele lê os dados válidos (a tabela), copia para um novo bloco e apaga o bloco antigo.

⚠️ Perigo: Esse processo de "copiar para escrever" é a Amplificação de Escrita (WAF). Se o seu WAF é 3, para cada 1GB que seu banco grava, o SSD gasta 3GB de vida útil da NAND e, pior, consome largura de banda interna, bloqueando I/O novo e causando o pico de latência.

Figura: Comparação visual: A fragmentação caótica do SSD Padrão vs. o isolamento limpo do FDP.

Figura: Comparação visual: A fragmentação caótica do SSD Padrão vs. o isolamento limpo do FDP.

A falha das soluções anteriores: Over-provisioning e ZNS

Durante anos, tentamos resolver isso com força bruta.

Over-provisioning (OP): Deixamos 20% ou 30% do disco vazio para facilitar a vida do GC. Funciona? Sim, mas é caro. Você está pagando por Terabytes de Flash NVMe que não pode usar.

ZNS (Zoned Namespaces): A indústria criou o ZNS para eliminar o GC. O host escreve sequencialmente em zonas. É tecnicamente perfeito, mas operacionalmente um pesadelo. Exige que o sistema de arquivos e o banco de dados sejam reescritos para gerenciar a geometria do disco. A barreira de entrada é altíssima.

O mercado precisava de um meio-termo: a inteligência de segregação do ZNS com a facilidade de uso do bloco convencional. Nasceu o FDP.

Implementando o isolamento lógico com NVMe FDP

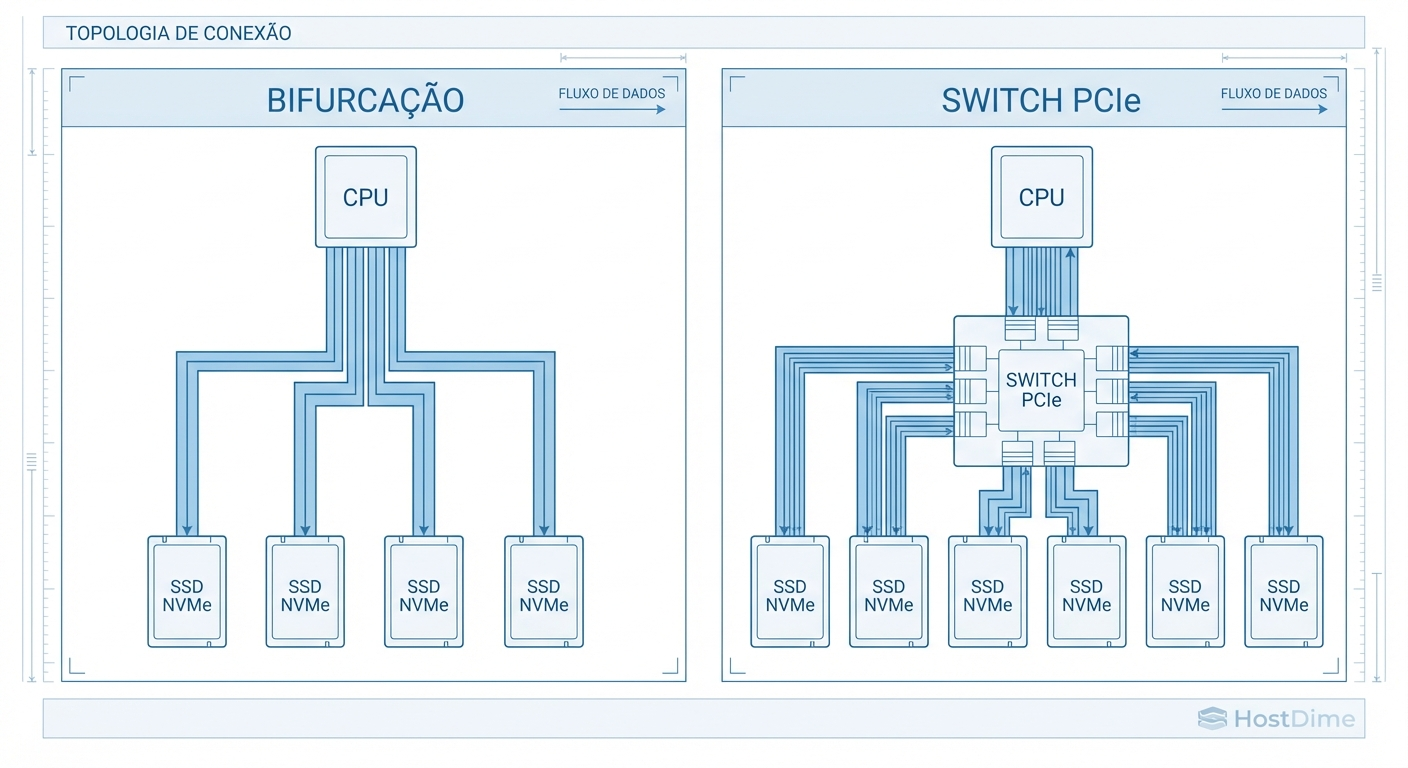

O Flexible Data Placement (FDP), introduzido na especificação técnica TP4146 da NVM Express, muda o jogo ao permitir que o host envie uma "dica" junto com o comando de escrita. Essa dica é o Placement ID.

Diferente do ZNS, o FDP não obriga você a gerenciar a escrita sequencial. Você pode continuar fazendo escritas aleatórias. O contrato é simples: o host diz "estes dados pertencem ao Grupo A" e o SSD garante que eles serão gravados em um Reclaim Group (um conjunto de blocos físicos) isolado dos dados do "Grupo B".

Como funciona na prática do Banco de Dados

Imagine um servidor rodando RocksDB (backend de muitos bancos modernos). Com suporte a FDP, o banco pode configurar:

Placement ID 0: Arquivos de Log (WAL).

Placement ID 1: Nível L0 da LSM-Tree (dados muito quentes).

Placement ID 2: Níveis L1-L6 (dados mornos/frios).

Quando o RocksDB decide apagar um arquivo de WAL antigo, ele invalida todos os dados associados ao Placement ID 0 naquele intervalo. Como o SSD agrupou fisicamente esses dados em blocos exclusivos para o ID 0, o bloco inteiro se torna inválido instantaneamente.

O Garbage Collection não precisa copiar nada. Ele apenas apaga o bloco. WAF próximo de 1.0.

Figura: O fluxo de dados com Placement IDs: O banco de dados orienta o destino físico da gravação.

Figura: O fluxo de dados com Placement IDs: O banco de dados orienta o destino físico da gravação.

Métricas de validação: O fim da "Cauda Longa"

Para um Arquiteto de Workloads, a métrica de sucesso do FDP não é apenas o aumento da vida útil do SSD (embora seu CFO vá gostar disso). A métrica real é a Qualidade de Serviço (QoS).

Em testes com FDP habilitado em kernels Linux recentes (6.2+ com suporte a io_uring passthrough para NVMe), observamos o seguinte comportamento em cargas de escrita mista:

Estabilização do Throughput: O SSD não entra em estados de "estrangulamento" para realizar limpezas de emergência.

Latência p9999 Linear: Aquele pico de 50ms que ocorria a cada 15 minutos desaparece. A latência máxima fica muito próxima da latência média.

💡 Dica Pro: Para validar se o FDP está funcionando no seu ambiente Linux, utilize o

nvme-cliatualizado. O comandonvme fdp status /dev/nvme0n1deve retornar a configuração dos Reclaim Groups e o uso atual dos Placement IDs. Se o seu driver NVMe não passar as diretivas, o SSD fará fallback para o modo convencional (sem erro, mas sem benefício).

Tabela Comparativa: O Cenário Atual de Storage

| Característica | NVMe Convencional | ZNS (Zoned Namespaces) | NVMe FDP (Flexible Data Placement) |

|---|---|---|---|

| Mecanismo de Escrita | Caixa Preta (O SSD decide) | Sequencial Obrigatória (Append-only) | Aleatória ou Sequencial (Com Dicas) |

| Complexidade de Host | Nula (Plug & Play) | Altíssima (Requer FS/DB customizado) | Baixa/Média (Requer driver/DB ciente) |

| WAF Típico (Carga Mista) | 3.0 - 4.0+ | ~1.0 | ~1.0 - 1.2 |

| Controle de Latência | Imprevisível (Depende do GC) | Determinístico | Altamente Previsível |

| Adoção Atual | Padrão de Mercado | Nicho Hyperscale | Tendência Enterprise Emergente |

O impacto no TCO e Sustentabilidade

Não podemos ignorar o fator custo. Ao reduzir o WAF, você efetivamente aumenta a capacidade utilizável e a durabilidade do drive.

Se um SSD Enterprise é classificado para 1 DWPD (Drive Write Per Day) com um WAF médio de 3, ao reduzir esse WAF para 1 com FDP, você triplica a quantidade real de dados de usuário que pode gravar antes de esgotar a garantia ou a célula de memória. Isso permite, em muitos casos, comprar SSDs de menor resistência (e menor custo) para a mesma carga de trabalho, ou estender o ciclo de refresh de hardware de 3 para 5 anos.

Figura: Estabilidade de Latência: A diferença brutal na consistência de performance com FDP.

Figura: Estabilidade de Latência: A diferença brutal na consistência de performance com FDP.

O Veredito: Prepare sua infraestrutura

O NVMe FDP não é uma tecnologia futurista distante; é uma realidade presente nas especificações OCP (Open Compute Project) Datacenter NVMe SSD 2.0. Os principais fabricantes (Samsung, SK Hynix, Western Digital) já possuem firmwares e controladores compatíveis.

Para DBAs e Arquitetos, a recomendação é clara: comece a exigir suporte a FDP nas suas próximas RFPs (Request for Proposals) de armazenamento. A era de aceitar latência de cauda como "comportamento normal" do flash acabou. Um banco de dados não é um arquivo de vídeo; ele exige precisão cirúrgica no armazenamento, e o FDP é o bisturi que faltava.

Referências & Leitura Complementar

NVM Express Technical Proposal 4146 (TP4146): Flexible Data Placement.

OCP Datacenter NVMe® SSD Specification 2.0: Requisitos de suporte a FDP para hardware de datacenter.

Linux Kernel Archives: Documentação do subsistema NVMe (v6.2+) sobre suporte a io_uring command passthrough e FDP.

Perguntas Frequentes (FAQ)

Qual a diferença fundamental entre NVMe FDP e ZNS (Zoned Namespaces)?

A principal diferença é a complexidade de implementação. O ZNS obriga o host a escrever sequencialmente, o que exige reescrever a camada de armazenamento do banco de dados ou usar sistemas de arquivos muito específicos. O FDP permite que o host continue fazendo escritas aleatórias, apenas sugerindo (via Placement IDs) onde os dados devem ficar, simplificando drasticamente a integração enquanto mantém os benefícios de isolamento.O FDP requer drivers específicos ou mudanças no Sistema Operacional?

Sim. O suporte ao FDP (baseado na TP4146) foi introduzido nativamente em kernels Linux mais recentes (geralmente a partir do 6.2). Além do Kernel, a aplicação (banco de dados) ou o driver NVMe precisa ser capaz de enviar as diretivas de posicionamento (Placement IDs) junto aos comandos de I/O. Sem isso, o SSD funciona como um disco NVMe padrão.Como exatamente o FDP reduz o Write Amplification Factor (WAF)?

O WAF alto ocorre quando o Garbage Collection precisa mover dados válidos de um bloco para outro para liberar espaço. O FDP agrupa dados com expectativa de vida semelhante (ex: logs que são deletados rápido vs. tabelas estáticas) no mesmo superbloco físico. Quando os dados de vida curta expiram, o bloco inteiro fica vazio e pode ser reutilizado sem a necessidade de copiar dados vizinhos, eliminando escritas internas desnecessárias.

Roberto Lemos

Arquiteto de Workloads

"Projeto infraestrutura onde o perfil de I/O dita as regras. Sei que a latência do acesso aleatório de um banco difere da vazão sequencial de vídeos. Mapeio o hardware exato para cada aplicação."